A vizuális promptok apró részletei (szín, méret, tömörítés) felboríthatják a VLM ranglistákat. Mutatom, mit jelent ez egészségügyben és logisztikában.

A vizuális promptok csalókák: így dőlhetnek be a VLM-ek

A ranglisták szeretnek magabiztosnak látszani. Egy szám, egy helyezés, egy „jobb, mint a többi” üzenet — és már indul is a beszerzés, a pilot, a vezetői prezentáció. Csakhogy a 2025.12.19-én benyújtott friss kutatás szerint a vizuálisan promptolt benchmarkok (ahol a kérdés egy képen jelölt pontra/területre hivatkozik) meglepően könnyen „megbillenhetnek”. Olyannyira, hogy egy piros jelölő kékre cserélése vagy a jelölő méretének kicsi módosítása akár teljesen átrendezheti a modellek sorrendjét.

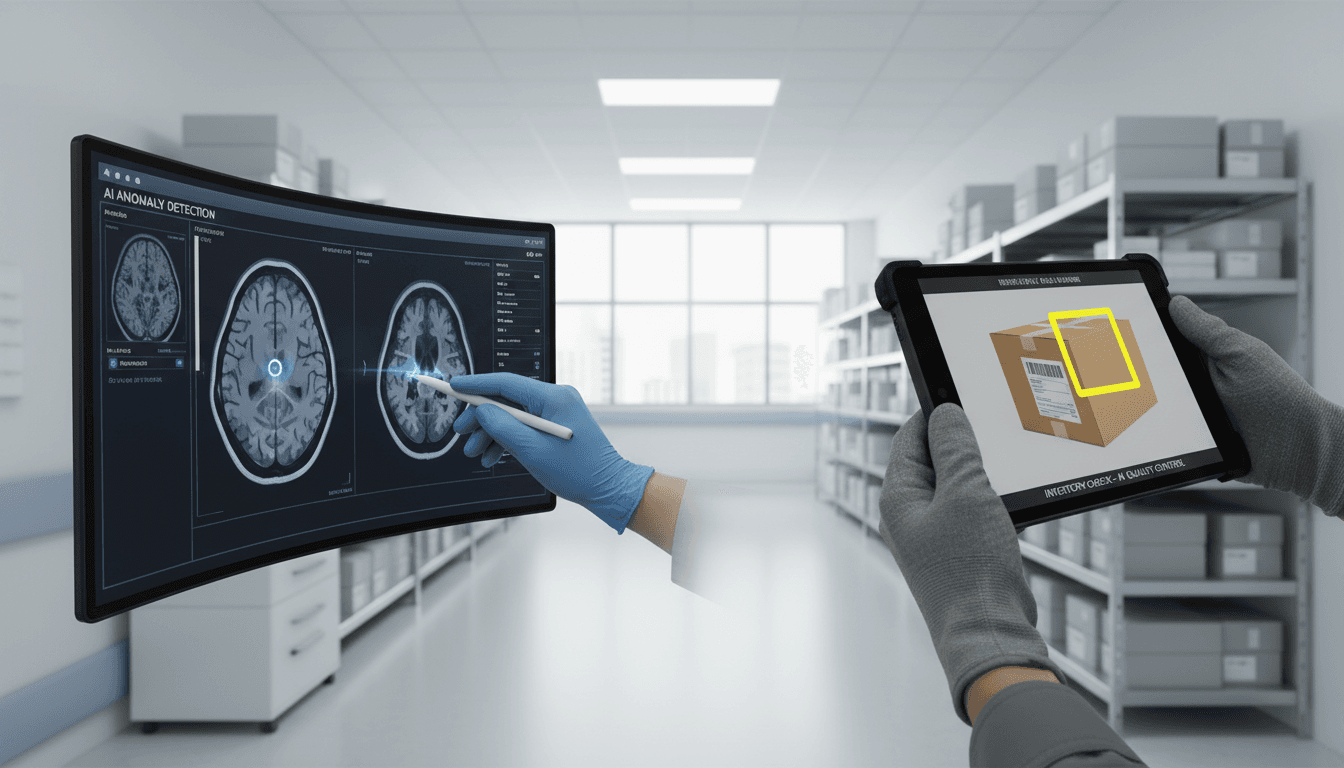

Ez a téma elsőre távolinak tűnhet a „Mesterséges intelligencia a logisztikában és ellátási láncban” sorozatban. Pedig nagyon is ide tartozik: ha egy VLM (vision-language model) ennyire érzékeny a jelölés apró részleteire, akkor ugyanaz a törékenység előjöhet raktári vizuális ellenőrzésnél, csomagolási hibák felismerésénél, vagy akár árubeérkezés fotóalapú dokumentálásánál. És a kampányunk fókuszában lévő egészségügyben ez még keményebb: ott a „csak egy jelölő” jellegű eltérések diagnosztikai kockázattá válnak.

Egymondatos lényeg: ha a VLM-et vizuális jelölőkkel teszteljük, a benchmark „körítése” (szín, méret, tömörítés, mintaszám) néha jobban befolyásolja az eredményt, mint maga a vizuális megértés.

Miért törékenyek a vizuálisan promptolt benchmarkok?

A vizuális promptolás célja tiszta: azt szeretnénk mérni, hogy a modell tényleg a képet elemzi-e, és nem csak a szöveges mintákból „okoskodik”. A BLINK-hez hasonló feladatokban ezért a kérdés tipikusan így működik: „Mi látható ennél a pontnál?” — és a pontot a képen vizuális marker jelöli.

A kutatás viszont azt találta, hogy a marker maga (színe, formája, mérete) nem semleges. Sok modellnél a marker nem csak „mutató”, hanem zavaró vizuális objektum is lehet, ami:

- eltakar részleteket (okklúzió)

- megváltoztatja a kontrasztot és a figyelmet (saliency)

- eltolja a belső figyelmi térképeket (attention)

- visszahat a képleírási mintákra (pl. „piros pötty”, „jelölő”, „célpont”)

A reality check: a VLM-ek nagy része nem „szem”, hanem statisztikai gépezet. Ha a tréningadatokban egy bizonyos jelölőtípus gyakran együtt jár bizonyos válaszformákkal, akkor a modell — különösen határesetekben — ráülhet erre a mintára.

A ranglista miért tud felborulni egy színcserétől?

A paper egyik legkellemetlenebb üzenete: a leaderboardok nem csak zajosak, hanem manipulálhatók is. Ha egy marker kicsit nagyobb lesz, vagy más színű, akkor:

- egy modell jobban „tolerálja” a takarást,

- egy másik modell túlzottan a markerre fókuszál,

- egy harmadik modellnél a pre-process pipeline másképp kezeli a színeket/tömörítést.

Ennek eredménye az, hogy ugyanaz a feladat más beállítással más nyertest hoz.

Mit mutat a friss kutatás (és miért fontos ez a gyakorlatban)?

A tanulmány kilenc nyílt és zárt forrású VLM-et vizsgál két vizuálisan promptolt feladaton, és azt demonstrálja, hogy a következő „apró” döntések nagyot ütnek:

- marker színe (példa: piros ↔ kék)

- marker mérete (kicsit nagyobb jelölő = más rangsor)

- adathalmaz mérete (kisebb mintán instabilabb a sorrend)

- alacsony szintű inferencia beállítások, például JPEG tömörítés API-hívásokban

A legérdekesebb állításuk az, hogy ezek a hatások jóval nagyobbak, mint a hagyományos, „szemantikus” VLM értékeléseknél (pl. képleírás, VQA általános kérdések).

A kellemetlen következmény: „gyengébb” modell előzhet „erősebbet”

A kutatók konkrét példát is adnak: a marker méretének kis növelése olyan helyzetet teremthet, ahol egy nyílt forrású modell (példaként említik az InternVL3-8B-t) összemérhető helyre kerül vagy akár jobbnak látszik, mint egy nagy, zárt modell (példaként szerepel a Gemini 2.5 Pro).

Nem az a tanulság, hogy „a kisebb modell jobb”. Hanem az, hogy a mérőrendszer érzékenysége miatt a ranglista könnyen félrevezető.

Egészségügyi tanulság: a robust AI nem PR, hanem betegbiztonság

Az egészségügyben a vizuális modellek tipikus terepe:

- radiológia (CT, MR, röntgen)

- patológia (WSI: digitális metszetek)

- bőrgyógyászati képek

- endoszkópia, ultrahang

Itt a vizuális promptolás analógiája nagyon is valós: orvosok és asszisztensek gyakran dolgoznak jelölésekkel (ROI, körberajzolás, nyilak, mérővonalak). A mindennapi rendszerekben pedig megjelenik:

- különböző PACS megjelenítő stílus,

- eltérő export beállítások,

- képernyőfotók tömörítéssel,

- annotációk színe/mérete intézményenként.

Ha a modell teljesítménye ennyire függ a „körítéstől”, akkor a kockázat kézzelfogható:

- hamis negatív: a marker eltakar egy finom elváltozást

- hamis pozitív: a marker vizuális mintája „elindít” egy rossz asszociációt

- intézményenként eltérő teljesítmény: más export és tömörítés → más eredmény

Én ebben nem vagyok kompromisszumkész: egészségügyi AI-t nem szabad úgy bevezetni, hogy a validáció csak egyetlen „szép” benchmark-setupon futott.

Logisztikai párhuzam: ugyanaz a törékenység a raktárban is előjön

A sorozatunk logisztikai fókuszában a VLM-ek egyre gyakrabban kerülnek elő olyan feladatokra, mint:

- beérkező áru fotóalapú ellenőrzése (sérülés, hiány, csomagolási anomália)

- raklapok és címkék vizuális azonosítása

- komissiózás támogatása ("ezt a polcot nézd")

- minőségellenőrzés gyártásközi pontokon

A vizuális prompt itt lehet:

- képernyőn megjelenő célkereszt/marker,

- AR-szemüveg kiemelése,

- operátori rajzolt jelölés,

- automatikus bounding box.

A tanulság: ha a rendszer teljesítménye függ a marker árnyalatától vagy a képek tömörítésétől, akkor egy látszólag ártatlan változás — új kamera, más mobilapp, új export beállítás — megdöntheti a stabilitást. A supply chain-ben ez selejtet, reklamációt, SLA-csúszást jelent. Az egészségügyben ennél is többet.

Hogyan mérjünk és vezessünk be vizuális AI-t stabilan? (Gyakorlati ellenőrzőlista)

A válasz nem az, hogy „benchmarkot kidobni”. A válasz az, hogy robosztusságra tervezünk — már a mérésnél.

1) Variánsokkal tesztelj, ne egyetlen setuppal

Ha vizuális promptot használsz (pont, nyíl, doboz, highlight), akkor a validációban legyen:

- legalább 8–16 marker variáns (szín, forma, vastagság, méret)

- több kontrasztos háttérhelyzet (világos/sötét régiók)

- enyhe eltolások (marker 2–5 pixelrel arrébb)

A paper pont ebbe az irányba lép a VPBench-csel: több variáns, nagyobb adathalmaz, többféle marker.

2) Rögzítsd az inferencia pipeline-t (és auditáld)

A JPEG tömörítés említése azért ijesztő, mert hétköznapi: sok API és kliens automatikusan tömörít. A stabil bevezetéshez rögzítsd és dokumentáld:

- bemeneti felbontás és átméretezés

- tömörítés típusa és minősége

- színterek kezelése (sRGB, gamma)

- pre-process lépések (crop, pad)

Snippet-kompatibilis állítás: „A VLM teljesítményét nem csak a modell, hanem a teljes képfeldolgozási lánc határozza meg.”

3) Ne csak átlagpontszámot nézz: nézd a szórást is

A robust AI egyik gyors lakmusztesztje: mennyit ingadozik a modell teljesítménye variánsok között. A riportban legyen:

- átlag

- medián

- szórás / interkvartilis tartomány

- legrosszabb 5% (worst-case)

Egészségügyben és kritikus logisztikában a worst-case sokszor fontosabb, mint a csúcs.

4) Validáció „valós” adaton: intézményenként / telephelyenként

Ha több telephely, több kamera, több szoftver, több annotációs stílus létezik, akkor a helyes gyakorlat:

- telephelyenként külön validáció,

- domain shift tesztek (új eszköz, új tömörítés, más fényviszony),

- drift monitoring bevezetés után.

5) Ember a hurokban, de okosan

Az „ember a hurokban” nem dísz. Legyen világos:

- mikor ad a rendszer javaslatot (assist),

- mikor ad riasztást (alert),

- mikor blokkol (hard stop),

- és hol kötelező a felülvizsgálat.

Különösen egészségügyben: a rendszernek nem csak pontossága kell, hanem megmagyarázható hibamódjai is.

Gyakori kérdések, amiket érdemes feltenni beszerzés vagy pilot előtt

„Ha a modell jó a leaderboardon, az elég?”

Nem. A leaderboard egy pillanatkép egy adott beállítással. A kérdés az, hogy a te környezetedben (kamerák, export, jelölések) mennyire stabil.

„Mitől lesz egy benchmark félrevezető?”

Attól, hogy a mérés közben a rendszer olyan részletekre tanul rá (marker, tömörítés, pre-process), amelyek nem a feladat lényegét mérik, mégis meghatározzák a pontszámot.

„Mit kérjek a szállítótól?”

Minimumot:

- robosztussági tesztjelentés marker- és tömörítés-variánsokra

- pipeline specifikáció (input szabvány)

- telephely-specifikus újratesztelési terv

- monitoring és visszamérés (drift)

Merre tovább: megbízhatóság mint versenyelőny (ellátási láncban és egészségügyben)

A vizuálisan promptolt benchmarkok törékenysége jókor jön, még ha kényelmetlen is. 2025 végén a legtöbb szervezet már nem azon vitatkozik, hogy „kell-e AI”, hanem azon, hogy melyik AI-t lehet biztonságosan üzemeltetni.

A logisztikában ez működési stabilitás és költségkontroll. Az egészségügyben bizalom és betegbiztonság. Ugyanaz a tanulság mindkét helyen: ne egyetlen beállításra optimalizáljunk, hanem variációkra és worst-case helyzetekre.

Ha most tervezel vizuális AI pilotot (raktári ellenőrzés, minőségbiztosítás, vagy akár orvosi képalkotás támogatása), én a következő lépéssel kezdeném: állíts össze egy rövid „robosztussági tesztcsomagot” marker- és tömörítés-variánsokkal, és nézd meg, hol reped meg a modell.

A kérdés nem az, hogy a VLM tud-e „szép válaszokat” adni. Hanem az, hogy ugyanazt a jó választ adja-e akkor is, amikor a valóság kicsit rondább, zajosabb, tömörítettebb — és tele van jelölésekkel.