Dobot ATOM 量产交付把具身智能推向真实应用。本文拆解其工程化方法,并对智能汽车软件与座舱体验落地给出可执行清单。

具身智能机器人量产落地:汽车软件与座舱体验能学什么

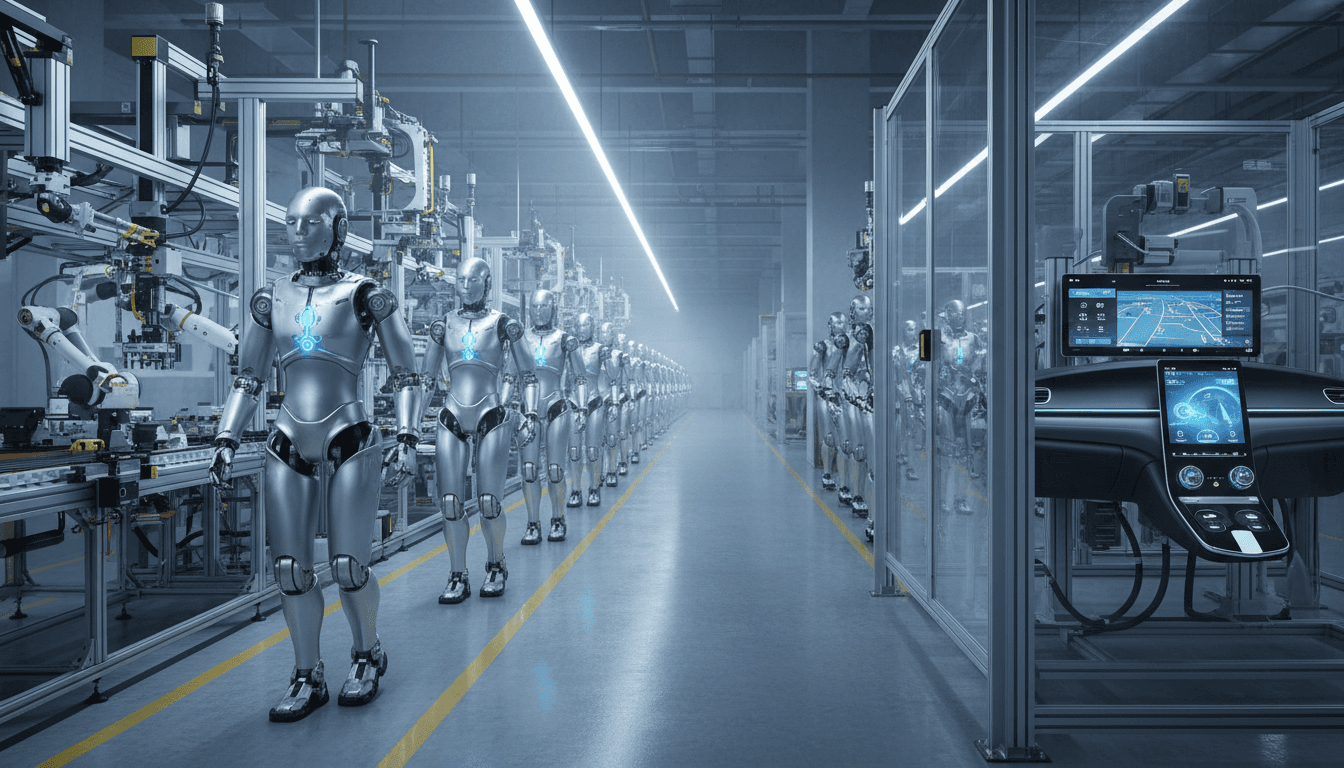

2026-02-04,越疆(Dobot)宣布其第三批全尺寸工业人形机器人 ATOM 进入计划中的规模化交付阶段。更“刺激”的不是机器人能跳舞、能走路,而是它们开始以“批量、可复用、可验收”的方式进入真实工厂与商业场景。

我一直觉得,AI 产业真正的分水岭从来不是“说得像不像人”,而是“能不能把活干完、把事故压下去、把节拍跑起来”。这条逻辑同样适用于智能汽车:消费者不会为一个会聊天但经常误触的座舱买单,车企也不会为一个难以维护、难以迭代的算法体系长期背负成本。

这篇文章把 ATOM 的量产与交付当作一个“现实样本”,放进《人工智能在制造业与智能工厂》系列的叙事里:当 AI 从实验室走向规模化部署时,制造业的人形机器人和汽车的软件体验,其实在用同一套方法论做工程化落地。

量产不是“多造几台”,而是 AI 工程成熟度的考试

量产交付之所以重要,是因为它迫使技术团队面对三个最现实的问题:供应链一致性、质量控制闭环、以及可复制的交付流程。能做出 Demo 并不稀奇,能持续交付“同样好用”的一批产品才是门槛。

Dobot 披露的信息里有几个关键点值得抓出来看:

- ATOM 高约 165cm,属于全尺寸工业人形机器人;

- 交付现场视频展示了同步行走、动态平衡、装配等任务;

- 生产过程强调端到端标准化与多层质量检验:来料检测、装配过程监控、整机性能测试;

- 关键指标(如动态平衡、运动精度)采用统一且严格的标准,保证批次一致性。

答案先给出:量产能力=技术成熟度+系统工程能力+组织流程能力。

这对汽车行业的启发非常直接:

- 车端 AI(语音、导航、驾驶辅助)不是“装上去就行”,而是要在不同车型、不同传感器、不同供应商 ECU/域控上保持一致体验;

- OTA 不是“能推送”,而是要有灰度策略、回滚机制、日志与诊断闭环;

- 体验不是“功能清单”,而是可度量、可验收、可持续迭代的工程体系。

如果把“交付一批人形机器人”类比成“交付一款车的座舱与软件”,两边都在做同一件事:把不确定性关进流程里。

从“能走能跳”到“能干活”:场景驱动才是具身智能的价值锚点

人形机器人会站起、会跳舞,很容易出圈,但真正决定商业价值的是任务完成率与稳定性。Dobot 提到其路径区别于很多“研究室出身”的竞争者:它自称是“从制造现场长出来”的具身智能企业,强调三类优势:

- 工业级可靠性与量产能力(能持续交付);

- 深度场景理解(强调任务完成);

- 作为“具身智能超级工厂”的一部分,与轮式、多足机器人在统一智能中枢下协同。

答案先给出:场景驱动的 AI,评价指标必须从“炫技”切到“交付”。

落到指标上,制造业更关心这些:

- 节拍:单工位平均完成时间、波动范围

- 良率:任务成功率、误差分布

- 稳定性:MTBF(平均无故障时间)、异常恢复时间

- 安全:碰撞/误动作风险、人员隔离与合规

同样,汽车座舱与用户体验也该更“工地化”一点:

- 语音成功率不要只看识别率,还要看意图完成率(从唤醒到执行完成)

- 导航不要只看路径规划,还要看纠错与重规划体验(绕路、封路、信号差)

- 大模型上车不要只看“能聊”,还要看误触发、幻觉成本、以及可解释的安全边界

一句话:能把任务链跑通,比能说漂亮话重要得多。

VLA(视觉-语言-动作)对汽车的启示:把“理解”与“执行”绑在一起

ATOM 的智能核心之一是 Dobot 自研的 DOBOT-VLA(Vision-Language-Action) 模型:把视觉感知、自然语言理解、动作生成打通,能把抽象指令拆成结构化任务链,并输出连续、可泛化的运动轨迹;同时结合强化学习与真实场景数据对齐,让机器人能随环境变化做调整。

答案先给出:VLA 的关键不在模型名字,而在“闭环”——看见、听懂、做出来、再修正。

汽车端可以借鉴的“闭环”思路包括:

1)座舱的多模态交互:从“对话”升级为“任务编排”

很多车机语音还停留在“问一句答一句”。更合理的是把语音当作任务入口,把中控屏/仪表/HUD 当作状态反馈,把车辆能力当作可编排的动作集合。

- 例:用户说“我有点冷”,系统不只调温度,还应结合座椅加热、风向、能耗策略给出可确认的方案。

- 例:用户说“带孩子去看电影”,系统应自动串起路线、停车场、到达时间、儿童锁/后排提醒等动作链。

2)驾驶辅助的人机协同:从“功能开关”升级为“意图与边界管理”

具身智能强调在动态环境中持续纠错。驾驶辅助同理:

- 关键不是“能不能开”,而是什么时候接管、如何接管、接管后怎么解释。

- 把“动作输出”与“状态可视化”做好,能显著降低用户不信任与误用风险。

3)车端 AI 的工程现实:数据对齐与可运营

机器人靠真实场景数据对齐,汽车也必须建立“数据—模型—发布—回收”的运营闭环:

- 车端日志与隐私合规采集(最小化、可匿名化)

- 关键场景的离线评测集与在线指标

- 分车型、分地区的灰度策略

没有可运营能力,大模型上车会变成一次性“发布会工程”。

“从生产到交付到应用”的闭环:智能工厂与智能汽车在同一条路上

Dobot 强调自己完成了从生产、交付到真实应用的闭环,并提出“具身智能超级工厂”的协同概念。放到《人工智能在制造业与智能工厂》系列里,这其实对应智能工厂的三件事:

- 标准化:工艺、测试、校准、验收标准统一

- 可观测:过程监控、性能指标、异常追踪

- 可调度:跨设备、跨形态机器人统一编排

答案先给出:真正的智能化不是多买设备,而是把“调度与验收”数字化。

汽车行业也在走类似路径:

- 车端:中央计算、域控整合、软件平台化

- 工厂端:数字孪生、预测性维护、视觉质检、柔性产线

- 用户端:从“卖车”到“运营车队/用户生命周期体验”

当车企把软件当作产品核心时,会发现自己越来越像一家“规模化交付的软件公司”;当机器人公司走向量产交付时,也越来越像一家“强系统工程的软件公司”。两者在中间相遇。

汽车团队可直接套用的 5 条落地清单(把 AI 做成可交付产品)

如果你在做智能座舱、车端大模型、或软件平台,我建议用更硬的方式推进落地。下面这 5 条,是我看到机器人量产逻辑后最想推荐给汽车团队的。

-

先定义“任务完成率”,再谈交互惊艳感

- 语音:意图完成率、平均完成时长、二次确认比例

- 导航:重规划成功率、到达时间误差

-

把异常当主流程设计

- 断网、定位漂移、噪声环境、用户口音、误唤醒

- 设计“可恢复”的交互:撤销、回滚、一步到位的纠错入口

-

建立统一的验收标准与回归测试

- 像工厂测试动态平衡那样,为关键体验设立硬指标

- 每次 OTA 必须回归:高频场景、事故场景、长尾场景

-

用“编排层”解耦模型与业务

- 大模型负责理解与生成,但执行要走可控的动作编排(workflow)

- 把安全边界、权限、车辆状态检查写进编排层

-

运营闭环要从第一天就开始

- 指标看板、用户反馈入口、灰度策略、数据合规

- 没有闭环,AI 体验只会越来越“玄学”。

一句好用的判断标准:如果你的 AI 不能被测试工程师稳定复现问题,就还没到可交付阶段。

2026 的窗口期:具身智能加速,汽车体验竞争会更“工程化”

文章提到,中国“十五五”规划已将具身智能列为未来产业方向之一。政策与产业共振通常会带来两件事:人才与资本更集中、供应链与标准更快成熟。对制造业来说,这是人形机器人从试点走向规模应用的窗口;对汽车行业来说,则是“AI 上车”从功能堆叠走向体验分层的窗口。

我更看重的变化是:**AI 的竞争会越来越像系统工程比赛。**谁的指标体系更清晰、交付链路更可靠、异常处理更扎实,谁就能更快把成本打下来,把体验做稳。

下一步你可以做一件很具体的事:选一个最影响口碑的高频场景(例如“上车后 30 秒内的导航+媒体+空调联动”),把它当作一条工业产线来优化:定义指标、建立回归、上线灰度、监控闭环。做完这一条,你会明显感觉团队的“AI 讨论”更落地。

当 ATOM 这样的具身智能开始批量进厂,智能汽车也会被迫回答同一个问题:我们交付给用户的,到底是会说话的系统,还是能把事办成的产品?