上海AI实验室开源万亿参数科学大模型Intern-S1-Pro,MoE推理仅激活约220亿参数。本文拆解其对汽车软件与智能座舱Agent、研发仿真与售后闭环的落地启示。

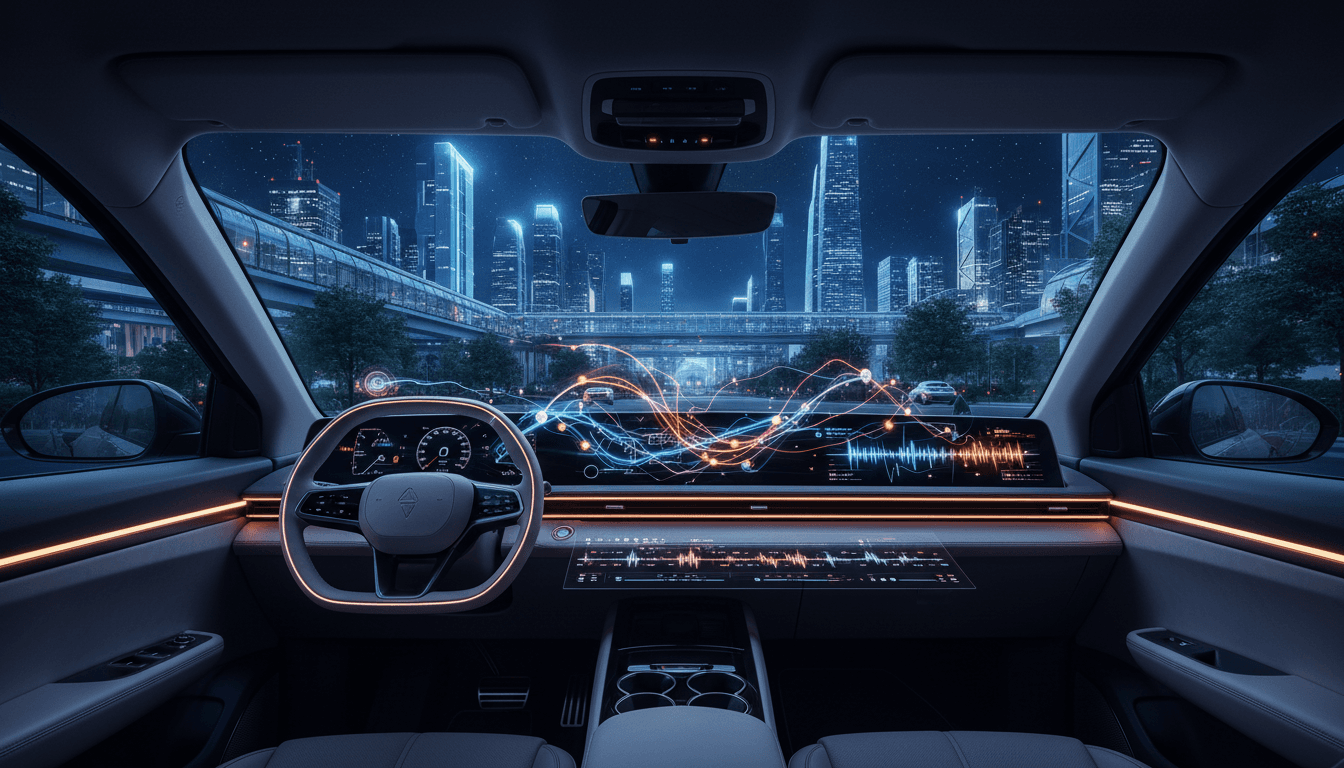

万亿参数开源科学大模型启示:汽车软件与座舱体验怎么用AI做深

2026-02-05,上海人工智能实验室宣布开源Intern-S1-Pro:一个面向科研的万亿参数多模态基础模型。更关键的细节在于:它采用MoE(Mixture-of-Experts,混合专家)架构,总参数量1万亿,但每次推理只激活约220亿参数(8个专家)。这不是“堆参数”的炫技,而是一种更贴近工程现实的路线:在算力与成本可控的前提下,把复杂推理、工具调用和多模态理解做得更强。

很多人看到“科学大模型”会下意识觉得离汽车太远。我反而认为,这类模型对**汽车软件与用户体验(UX)**的意义更直接——它把“能在实验室跑通的能力”进一步推向“能在真实世界系统化落地的能力”。尤其对中国汽车品牌和供应链来说,开源意味着:你不必从零开始训练一个巨无霸,也能在合规与成本边界内,把智能座舱、车载助手、研发仿真和售后服务做出差异化。

这篇文章属于「人工智能在科研与创新平台」系列,我们从Intern-S1-Pro的技术点出发,拆解它对汽车行业的三层价值:工程架构启示、座舱体验升级路径、以及研发与数据闭环的落地方法。

Intern-S1-Pro到底新在哪:不是“更大”,是“更会用算力”

最值得汽车行业抄作业的点只有一个:把“推理时的真实成本”降下来,同时把“复杂任务能力”抬上去。

Intern-S1-Pro基于SAGE“通用-专用融合”架构,并使用MoE:训练时可以把知识与能力分到不同“专家”里;推理时通过路由机制只调用少数专家,从而把延迟与成本压到可用区间。对车端场景来说,这一点非常现实:你不可能在车机上长时间占用高功耗算力,更不可能把所有问题都丢到云端。

MoE对车载AI的直观意义:把“全能助手”拆成“专业团队”

传统单体大模型像“一个人什么都做”,效果可能不错,但资源消耗大、响应慢。MoE更像“一个调度员+多个专家”:

- 导航与出行专家:处理POI、路线偏好、时间窗约束

- 车控专家:理解车辆状态、权限、安全策略

- 语音多轮专家:处理上下文、指代、省略

- 维修与知识库专家:处理故障描述、维修工单、备件信息

你不一定要在车上部署“万亿参数”,但你可以借鉴它的组织方式:用更小的激活计算,获得更强的任务能力。这也解释了为什么很多车载助手“会聊天但不办事”——缺的不是语料,而是“任务级路由+工具链+权限边界”的系统设计。

多模态与时间编码:对车辆“连续信号世界”的适配更强

报道提到模型引入Fourier位置编码与重新设计的时间编码器,用来统一从微观到宏观的信号理解。把这句话翻译成汽车语言就是:车辆数据不是一张张静态图片,而是连续的时序信号——车速、转向角、IMU、雷达点云片段、舱内语音、空调温度曲线……

如果一个基础模型更擅长处理“跨尺度信号”,它对以下方向更友好:

- 座舱多模态交互:语音+屏幕+手势+环境状态的联合理解

- 驾驶舒适性与能耗优化:从长短期时序中学习用户习惯与路况模式

- 预测性维护:从细微振动/电流波动中提前识别异常趋势

从科研到汽车:万亿参数开源模型带来的三类落地机会

结论先说:Intern-S1-Pro这类开源科学大模型的价值,不在于“直接上车”,而在于它能成为汽车企业构建AI能力栈的加速器——尤其是当你要同时覆盖座舱体验、工程研发、售后服务三条线时。

1)智能座舱:从“语音助手”升级为“任务代理(Agent)”

现在用户对车机的容忍度越来越低:响应慢、听不懂、做不到,就会被贴上“鸡肋智能”的标签。真正的体验差距来自“能否完成任务闭环”。

把车载AI做成Agent,至少要具备四件事:

- 意图理解:不止识别“打开空调”,还要理解“我有点闷”这种隐式需求

- 工具调用:调用导航、车控、日程、音乐、充电、客服等API

- 权限与安全:高速场景限制复杂交互;涉及支付/隐私需二次确认

- 多轮纠错:在噪声、口音、打断的条件下仍能把任务完成

Intern-S1-Pro被描述为“在真实科研的Agent流程中位居开源前列”,这个信号对车企很明确:下一代座舱竞争,不是拼UI皮肤,是拼Agent工作流与工程稳定性。

一句话概括:座舱体验的上限,由“模型能说什么”转向“系统能做成什么”。

2)汽车软件研发:把“科研级推理”变成“工程级提效”

在「人工智能在科研与创新平台」的语境里,AI的价值常常体现在:更快的实验、更少的试错、更稳定的结论。汽车研发同样如此,只是对象从“药物/材料”换成“软件/系统/整车”。

可落地的方向包括:

- 需求到代码的链路:把产品需求、法规条文、接口文档对齐成可追踪工单

- 自动化测试与缺陷定位:根据日志与复现步骤生成可执行测试用例

- 仿真与参数搜索:在多目标约束下搜索能耗/舒适/性能的Pareto最优解

- 模型与标定知识管理:把分散在邮件、IM、Wiki里的经验变成可检索的“研发知识库+推理引擎”

这里开源的意义很实际:你可以在内网把模型作为“研发助手底座”,接入代码仓、CI/CD、缺陷库与仿真平台,避免敏感数据外流。

3)售后与服务:让“懂车”成为可规模化的能力

很多车企的服务体验断层来自两点:一线人员流动大、知识更新慢;而用户描述故障往往非常口语化。多模态大模型在这里的用武之地是:把“模糊描述”映射到“标准化诊断路径”。

典型闭环是:

- 用户说“刹车有点软”→ 追问工况(雨天/低温/长下坡)

- 联合车辆DTC/传感器数据→ 给出优先排查项

- 自动生成服务工单→ 备件预估与工时建议

如果模型具备更强的数学推理与复杂任务规划能力,售后场景就不止是“问答机器人”,而是能真正降低返厂次数与误判率的“服务代理”。

汽车企业怎么用“开源+大模型”做出可控的系统?一套四步法

结论很直白:别急着追模型尺寸,先把数据边界、工具链、评测体系建好。 我见过太多项目卡在“演示能跑、上车就崩”,根因不是模型不够大,而是工程要素没齐。

第一步:拆场景,把体验指标写成“可量化的任务”

把“更智能”翻译成指标,例如:

- 语音车控:首轮完成率 ≥ 85%,平均响应 < 1.2s

- 导航规划:多约束路线(避拥堵+低电量+儿童医院优先)成功率 ≥ 80%

- 多轮对话:3轮内闭环率 ≥ 75%,中断恢复成功率 ≥ 70%

指标越具体,越能指导后续的路由、缓存、工具调用与降级策略。

第二步:用MoE思路做“能力分层”,别把所有请求都走同一条链路

车端建议采用“三层推理”策略:

- 本地轻量模型:常用车控、离线命令、低延迟需求

- 边缘/云中模型:复杂规划、长文本、多工具协同

- 规则与安全网:高风险动作必须走确定性策略(例如关停辅助驾驶相关功能)

MoE的启示是:把请求“分流”,系统就会稳。

第三步:把工具调用当产品核心,而不是“模型外挂”

座舱Agent真正的壁垒是工具链:

- API规范(参数、错误码、幂等)

- 上下文管理(车辆状态、用户偏好、地理位置)

- 权限体系(驾驶中限制、账号级权限、家人共享)

- 观测与回放(每次调用为什么成功/失败)

没有这套东西,模型再强也只是“能聊”。

第四步:建立评测与回归:把“体验”变成持续迭代的工程学

建议同时做三类评测集:

- 功能集:车控、导航、媒体、充电等高频任务

- 安全集:误触发、越权、诱导指令、隐私泄露

- 鲁棒集:噪声口音、打断、方言、弱网、低配硬件

每次OTA前做自动化回归,否则体验会“改一点坏三处”。

这次开源对中国汽车软件意味着什么?我更看重两点

第一,开源正在把先进能力变成“可复用的工业积木”。对中国汽车产业链来说,供应商、主机厂、生态伙伴可以围绕同一类底座协作:你做工具、我做评测、他做车端部署优化。研发速度会明显拉开差距。

第二,“自主技术栈”的叙事在工程上更具体了。报道强调从架构到国产算力基础设施的验证。对汽车这种强合规、强供应链的行业,技术栈可控往往意味着:交付节奏更稳、成本更可预期、数据安全更可解释。

接下来一年我最期待的,不是某个更大的参数数字,而是更多“科研能力”被翻译成“汽车可用能力”:更低延迟的多模态交互、更可靠的任务代理、更严格的安全边界。

如果你正在规划智能座舱或汽车软件AI能力建设,可以先做一个小而硬的试点:选一个高频任务(例如“冬季通勤一键场景”),按本文四步法把闭环打通。真正的领先,往往就是从一个能稳定跑三个月的闭环开始。

你更想先把AI用在座舱体验、研发提效,还是售后服务?这个选择,会直接决定你该先搭哪套数据与工具链。