Fake Content erzeugt Fake Data. So schützt KI im E-Commerce vor Manipulation, Betrug und verzerrten Forecasts – mit konkreten Schritten für den Start.

Fake-Videos, echte Schäden: KI-Strategien für Handel

Ein Video wird zwölf Millionen Mal angeklickt, behauptet einen Staatsstreich – und bleibt online, obwohl ein Präsident persönlich interveniert. Genau das ist diese Woche passiert: Emmanuel Macron rügte Facebook öffentlich, weil ein Fake-Video über einen angeblichen Staatsstreich in Frankreich nicht entfernt wurde. Die Begründung der Plattform: kein Verstoß gegen die Nutzungsbedingungen.

Für Politik ist das brisant. Für Einzelhandel und E-Commerce ist es ein Warnsignal. Denn wer glaubt, Desinformation betreffe nur News-Feeds, unterschätzt die Realität: Fake Content erzeugt Fake Signale – und diese Signale fließen in Markenwahrnehmung, Nachfrage, Kampagnen-Performance und sogar in Forecasts ein. KI kann helfen, diese Signale zu erkennen. Aber nur, wenn Unternehmen Verantwortung, Prozesse und Messgrößen mitdenken.

Was der Macron-Fall über Vertrauen auf Plattformen zeigt

Kernaussage: Wenn selbst hochrangige Akteure Falschinformationen nicht schnell stoppen können, müssen Unternehmen davon ausgehen, dass problematische Inhalte immer wieder durchrutschen.

Der Macron-Vorwurf ist vor allem ein Lehrstück über zwei Dinge:

- Skaleneffekte: Ein einzelnes Video erreicht in kürzester Zeit Millionen. Im Handel gilt das genauso – nur heißen die Inhalte dann „Produktreview“, „Unboxing“, „TikTok-Hack“ oder „Boykottaufruf“.

- Regelwerke vs. Realität: Plattformen moderieren entlang von Policies, nicht entlang der Frage „Was richtet Schaden an?“. Für Marken bedeutet das: Warten auf Plattformen ist keine Strategie.

Was passiert, wenn man sich trotzdem darauf verlässt? Dann steuert man sein Business mit verzerrten Daten: Social Listening, Sentiment, Kampagnen-Attribution, „Trending Products“ – alles kann von koordinierten Fakes beeinflusst werden.

Der blinde Fleck im E-Commerce: Fake ist nicht nur „Fake News“

Falschinformationen im Handel sind oft subtiler als ein Staatsstreich-Video:

- Fake Reviews (gekauft, bot-generiert oder koordiniert)

- Manipulierte Produktbilder/Videos (z. B. übertriebene „Vorher-Nachher“-Effekte)

- Astroturfing (scheinbar organische Begeisterung, tatsächlich Kampagne)

- Retourenbetrug & Friendly Fraud (als „Kundenverhalten“ getarnt)

- Klickbetrug in Performance-Kanälen

Die Konsequenz ist immer ähnlich: Vertrauen sinkt, Kosten steigen, Entscheidungen werden schlechter.

Fake Content wird zu Fake Data – und das kostet Umsatz

Kernaussage: Schlechte Informationen wirken im Handel wie ein Fehler im Warenbestand: erst klein, dann teuer.

Im Q4-Geschäft und rund um den Jahreswechsel (wir sind Mitte/Ende Dezember) sitzen viele Teams gerade an:

- Budget-Planung fürs neue Jahr

- Abverkaufssteuerung nach Feiertagen

- Forecasting für Winter-Sale und Frühjahrsware

Wenn in dieser Phase Daten verzerrt sind, multipliziert sich der Schaden. Ein paar typische Kettenreaktionen:

1) Verzerrte Nachfrageprognosen

Wenn Social Buzz durch Fakes oder koordinierte Kampagnen künstlich hochgeht, landet das im Forecast. Ergebnis:

- zu hohe Bestellungen (Kapitalbindung, Abschriften)

- falsche Replenishment-Logik

- Überlastung von Fulfillment und Customer Service

2) Fehlsteuerung im Marketing

Bots klicken Anzeigen, „Engagement“ steigt, Attribution sieht gut aus – und trotzdem fehlen echte Käufe.

Typischer Effekt:

- CPM/CPC stabil, aber Conversion Rate sinkt

- ROAS wird unzuverlässig

- man optimiert auf das falsche Signal

3) Erosion von Markenvertrauen

Ein virales Fake-Video oder eine Review-Manipulation muss nicht beweisen, dass etwas wahr ist. Es muss nur Zweifel säen.

„Vertrauen entsteht langsam, aber es kippt schnell – besonders, wenn Inhalte wie Beweise wirken.“

Gerade im E-Commerce, wo Kund:innen Produkte nicht anfassen können, sind Reviews, Bilder und Videos ein Teil der „Ware“.

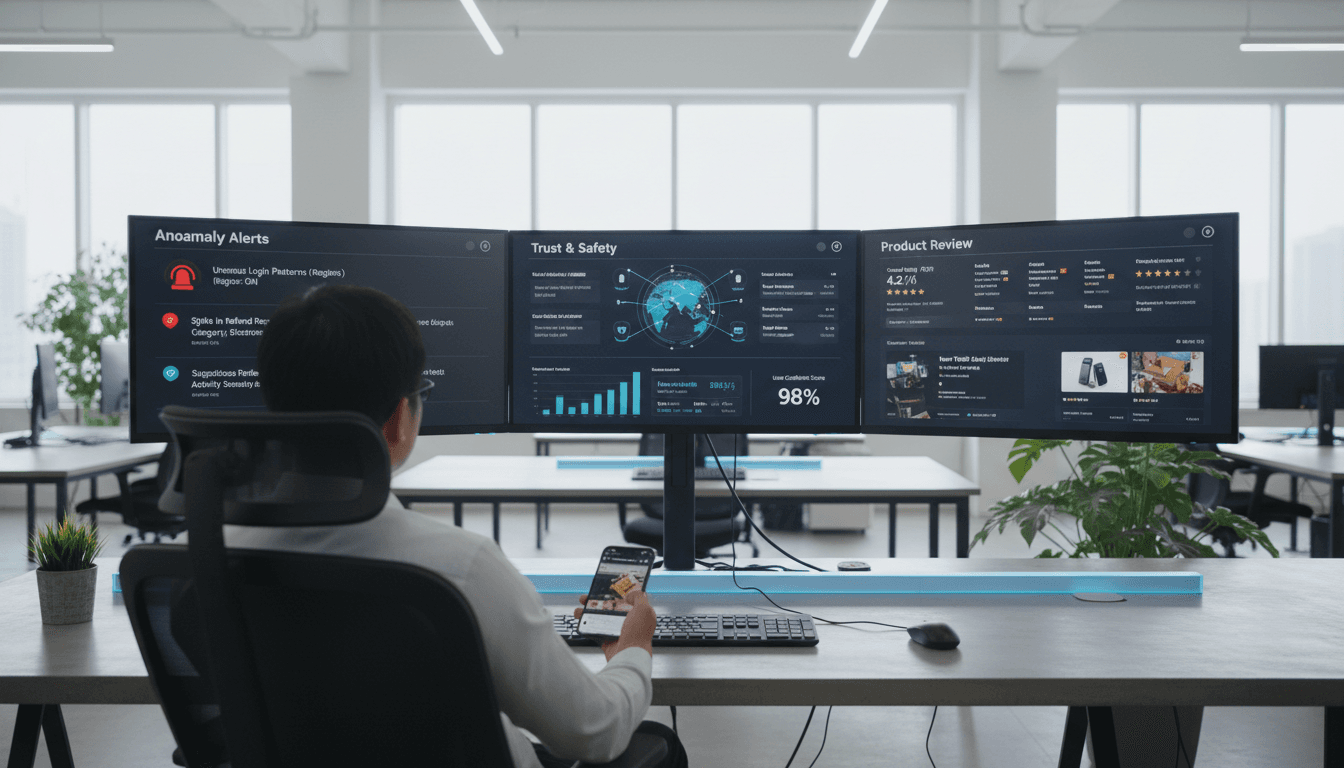

Wie KI Fake Content und manipulierendes Verhalten erkennt

Kernaussage: KI ist am stärksten, wenn sie Inhaltssignale + Verhaltenssignale + Kontextdaten kombiniert.

Viele Unternehmen starten bei „Fake Detection“ zu eindimensional – nur Textanalyse oder nur Bildprüfung. In der Praxis braucht es ein mehrschichtiges System.

KI-Ansatz 1: Review- und UGC-Erkennung (Text + Muster)

Für Fake Reviews erkennen haben sich drei Signalgruppen bewährt:

- Linguistische Merkmale: ungewöhnliche Wiederholungen, generische Formulierungen, unnatürliche Superlative, identische Satzmuster

- Metadaten: Account-Alter, Kaufhistorie, Zeitabstände, Cluster von Bewertungen

- Netzwerkmuster: mehrere Accounts bewerten dieselben Produkte in kurzer Zeit, ähnliche Geräte/Standorte

Praktisch heißt das: Ein Modell markiert nicht „wahr/falsch“, sondern gibt einen Risikowert. Diese Scores können dann in Moderation, Ranking und Trust-Labels einfließen.

KI-Ansatz 2: Bild- und Video-Forensik im Commerce-Kontext

Das Macron-Beispiel zeigt, wie glaubwürdig Bewegtbild wirkt. Für Händler relevant:

- manipulative Produktvideos (z. B. „Test“ mit versteckten Tricks)

- AI-generierte Testimonials

- neu zusammengeschnittene Clips mit falschem Kontext

Hier helfen u. a.:

- Erkennung von synthetischen Artefakten (Inkonsistenzen in Licht, Kanten, Frame-Übergängen)

- Fingerprinting (Wiedererkennen bekannter Clips in neuen Uploads)

- Kontext-Checks (passt der Clip zum Produkt, zum Zeitpunkt, zur Beschreibung?)

Wichtig: Ziel ist nicht perfekte Deepfake-Entlarvung. Ziel ist Risikoreduktion bei hoher Skalierung.

KI-Ansatz 3: Bot- und Fraud-Erkennung im Funnel

Nicht jeder Fake ist Content – oft ist es Verhalten:

- Klickbetrug

- Fake Accounts, die Warenkörbe füllen

- koordiniertes „Out of Stock“-Monitoring durch Reseller

- Retourenbetrug-Muster

Hier ist KI besonders wirksam, weil man Ereignisse in Echtzeit bewerten kann:

- Session- und Device-Signale (Sprünge, Timing, wiederholte Pfade)

- Anomalien in Conversion-Flows

- Muster über Bestellungen, Retouren, Zahlungsarten

Ein gutes System blockt nicht pauschal, sondern nutzt Stufen: Re-Auth, Captcha, manuelle Prüfung, Limitierungen.

Verantwortung und Prozesse: Ohne Governance wird KI zur Alibi-Lösung

Kernaussage: KI hilft nur, wenn klar ist, wer bei welchem Risiko wie entscheidet.

Der Streit „Plattform entfernt nicht“ erinnert an ein Muster, das ich im Handel oft sehe: Teams erwarten von Tools Entscheidungen, die eigentlich Policy-Entscheidungen sind.

Ein praktikables Governance-Modell (4 Ebenen)

- Policy: Was gilt bei uns als unzulässig? (Fake Reviews, irreführende Videos, koordinierte Manipulation)

- Detection: Welche KI-Signale nutzen wir? Welche Schwellenwerte?

- Response: Was passiert bei 60/80/95 Punkten Risiko? (Label, Downranking, Sperre, Review)

- Audit: Wie messen wir False Positives/Negatives und verbessern monatlich?

So entsteht ein System, das skaliert – und das Customer Experience nicht kaputtmacht.

Messgrößen, die wirklich zählen

Wenn Sie KI im E-Commerce einsetzen, messen Sie nicht nur „Anzahl entfernte Inhalte“. Besser:

- Trust KPIs: Anteil verifizierter Bewertungen, Beschwerdequote, Rückfragen im Support

- Commerce KPIs: Conversion Rate nach Einführung, Retourenquote, Fraud Rate

- Model KPIs: Precision/Recall, Bearbeitungszeit, Einspruchsquote

Das Ziel ist ein messbarer Effekt auf Umsatz und Kosten, nicht ein „sauberer Feed“.

Praxisbeispiel: So könnte ein Händler in 30 Tagen starten

Kernaussage: Der schnellste Einstieg ist ein Pilot auf einem klaren Pain Point – meist Reviews oder Fraud.

Ein realistischer 30-Tage-Plan für einen mittelgroßen Onlinehändler:

-

Woche 1 – Risiko definieren

- Top-20 Produkte nach Umsatz identifizieren

- Top-3 Manipulationsrisiken wählen (z. B. Fake Reviews, Klickbetrug, Retourenbetrug)

-

Woche 2 – Daten & Baseline

- Review-Daten, Order-Daten, Retouren, Traffic-Logs konsolidieren

- Baseline-KPIs festhalten (Conversion, Retourenquote, Support-Tickets)

-

Woche 3 – KI-Scoring einführen

- Risikoscore pro Review/Session/Order

- Schwellenwerte festlegen (z. B. 80+ = manuelle Prüfung)

-

Woche 4 – Response testen

- Downranking verdächtiger Reviews statt sofort löschen

- Zusätzliche Verifikation bei verdächtigen Orders

- Monitoring: Auswirkungen auf Conversion und Support

Nach 30 Tagen haben Sie keine perfekte Wahrheit. Aber Sie haben ein funktionierendes Frühwarnsystem.

Fazit: Wer Vertrauen verkauft, muss Signale schützen

Der Macron-Fall zeigt, wie schwer es ist, Falschinformation auf großen Plattformen schnell einzufangen. Im Handel gilt dasselbe Prinzip – nur heißen die Risiken „Fake Reviews“, „manipulierte UGC-Videos“, „Bot-Traffic“ oder „Fraud“.

In unserer Serie „KI im Einzelhandel und E-Commerce“ ist das ein zentraler Punkt: KI hilft nicht nur bei Personalisierung und Nachfrageprognosen. Sie ist auch ein Werkzeug, um Datenqualität und Vertrauen zu sichern – und damit die Grundlage für jede saubere Optimierung.

Wenn Sie 2026 mit besseren Margen, weniger Betrug und stabileren Forecasts starten wollen, würde ich bei einem Thema beginnen: Fake erkennen, bevor daraus falsche Entscheidungen werden. Welche Signale in Ihrem Shop wirken heute „zu gut, um wahr zu sein“?