Sigurna veštačka inteligencija u industriji Srbije: šta nas slučaj Grok uči o AI rizicima, kontroli i usklađenosti u B2B okruženju.

Sigurna AI u industriji Srbije: lekcija iz Groka

Broj 1 problem sa veštačkom inteligencijom u praksi nije „da li radi“, nego da li radi bezbedno, predvidivo i u skladu sa pravilima. Vest da je analiza organizacije Common Sense Media ocenila xAI-jev chatbot Grok kao posebno rizičan za maloletnike (uz slabe mehanizme provere uzrasta i generisanje seksualnog, nasilnog i neprikladnog sadržaja) zvuči kao tema za roditelje i društvene mreže.

Ali ako ste u proizvodnji, logistici, energetici ili bilo kojoj B2B industriji u Srbiji, ovo je i te kako vaš teren. Jer isti obrazac — proizvod pušten u rad pre nego što su zaštitne ograde dovoljno jake — u industriji ne završava samo lošim PR-om. Završava prekidom isporuka, ugovornih penala, povlačenjem partnera iz EU i skupim incidentima.

Ovaj tekst je deo serijala „Kako veštačka inteligencija transformiše proizvodnju i industriju u Srbiji“ i koristi slučaj Groka kao praktičan podsetnik: AI bez upravljanja rizikom je kratkoročno brža, a dugoročno skuplja strategija.

Šta nam slučaj Grok zapravo govori o rizicima AI

Direktna poruka: ako AI sistem nema dobru kontrolu ulaza (ko koristi) i izlaza (šta generiše), koristiće se pogrešno — namerno ili slučajno.

Prema navodima iz izveštaja, Grok pokazuje:

- slabu identifikaciju korisnika mlađih od 18 godina,

- neefikasan „Kids Mode“,

- sklonost ka generisanju seksualnog i nasilnog sadržaja,

- čak i „opasne savete“ (droge, nasilje, izolacija od odraslih).

U industriji, analogija je jasna:

- „dete koje laže uzrast“ je ekvivalent neautorizovanog korisnika (dobavljač, praktikant, eksterni serviser) koji dobije pristup podacima ili funkcijama koje ne sme.

- „neprikladan sadržaj“ je ekvivalent neprihvatljivom izlazu modela: pogrešna instrukcija za mašinu, lažna preporuka za nabavku, halucinirani zaključak u QA izveštaju, ili automatski generisan e-mail kupcu koji kompromituje reputaciju.

AI rizik u B2B svetu najčešće nije spektakularan. On je tih, ponovljiv i skup.

Zašto je ovo posebno važno za proizvodne firme u Srbiji

Najvažniji razlog: srpska industrija se sve više oslanja na EU lance snabdevanja, a EU očekuje dokazivu kontrolu rizika, bezbednosti i usklađenosti.

U praksi, kupci i partneri sve češće traže:

- tragove o tome kako upravljate podacima (ko ima pristup, gde se čuva, koliko dugo),

- procedure za incident response,

- dokaze o kontroli kvaliteta (uključujući digitalne alate),

- procenu rizika dobavljača (vendor risk).

Ako u takav ekosistem ubacite AI alat „na brzinu“ — recimo generativnu AI za tehničku dokumentaciju, asistenta za planiranje proizvodnje ili model za vizuelnu kontrolu kvaliteta — postajete odgovorni za njegov učinak kao da je to deo vašeg procesa.

Reputacija se u industriji meri poverenjem, ne hype-om

U B2C svetu kompanija ponekad „preživi“ skandal i nastavi dalje. U B2B industriji, naročito u automobilskoj, mašinskoj, prehrambenoj i farmaceutskoj grani, posledice su direktne:

- stopiranje audita,

- zatezanje uslova ugovora,

- gubitak statusa preferiranog dobavljača,

- jače kontrole i dodatni troškovi usklađivanja.

Najčešće greške kada firme uvode AI (i kako da ih izbegnete)

Odgovor odmah: većina promašaja dolazi iz pretpostavke da je AI „još jedan softver“. Nije. AI je sistem koji pravi odluke ili predloge, a to menja odgovornost.

1) „Stavili smo to iza naloga/pretplate, to je dovoljno“

U članku se pominje kritika da ograničavanje funkcije iza paywall-a nije isto što i uklanjanje rizika. U industriji je isto: kontrola pristupa je samo jedan sloj.

Šta dodatno treba:

- stroge uloge i dozvole (RBAC) po funkciji, ne po timu,

- segmentacija podataka (npr. odvojeni prostori za R&D, kvalitet i komercijalu),

- logovanje i revizija: ko je pitao AI, šta je AI odgovorio, šta je primenjeno.

2) „Model je pametan, neće pogrešiti“

Generativni modeli haluciniraju — to nije bug koji ćete „patchovati“ jednom.

Ako AI piše izveštaje o škartu ili predlaže korekcije procesa, postavite pravilo:

- AI daje predlog, čovek odobrava (human-in-the-loop) za sve što utiče na bezbednost, kvalitet ili ugovorne obaveze.

3) „Nemamo vremena za testiranje“

Common Sense Media je testirao Grok tokom više meseci. U industriji, testiranje ne mora da traje mesecima, ali mora da bude sistematično.

Minimalni paket pre produkcije:

- testovi na „zabranjene izlaze“ (opasne instrukcije, curenje poverljivih podataka, diskriminatorni output),

- testovi na granične slučajeve (loš input, nekompletni podaci, kontradiktorni zahtevi),

- testovi na stabilnost: isti upit u različito vreme.

4) „AI je u IT-u, proizvodnja ne mora da zna detalje“

To je recept za incident. AI koji menja plan proizvodnje, predikciju zastoja ili kontrolu kvaliteta je operativna tehnologija po posledicama, čak i ako tehnički živi u cloud-u.

Praksa koja radi:

- zajednički ownership: IT + proizvodnja + kvalitet,

- jasna RACI matrica (ko odobrava, ko sprovodi, ko odgovara),

- kratke, operativne obuke (30–60 minuta) za ljude na liniji.

„Sigurna AI“ u industriji: šta to znači u praksi

Definicija za B2B: Sigurna AI je AI koja ima kontrolisane ulaze, ograničene izlaze, dokazivu usklađenost i mehanizam za zaustavljanje kada greši.

Evo kontrolne liste koja u realnim projektima najviše vredi.

Kontrole podataka (data governance)

- klasifikujte podatke: javno / interno / poverljivo / poslovna tajna

- zabranite slanje poverljivih podataka u javne chatbotove

- koristite privatne instance ili on-prem rešenja gde je potrebno

- definišite retention (koliko dugo se čuvaju promptovi i logovi)

Kontrole modela (model governance)

- dokumentujte: koji model, koja verzija, za koju svrhu

- postavite „guardrails“: tematska ograničenja, filteri, blok liste

- uvedite red-teaming: namerno traženje načina da sistem pogreši

- planirajte rollback: kako se vraćate na prethodnu verziju

Kontrole procesa (operational controls)

- human-in-the-loop za kritične odluke

- dvostruka verifikacija za promene u parametrima procesa

- monitoring KPI: stopa grešaka, stopa odbijenih predloga, incidenti

Ako ne možete da objasnite kako AI dolazi do preporuke, bar morate da dokažete da je preporuka bezbedna.

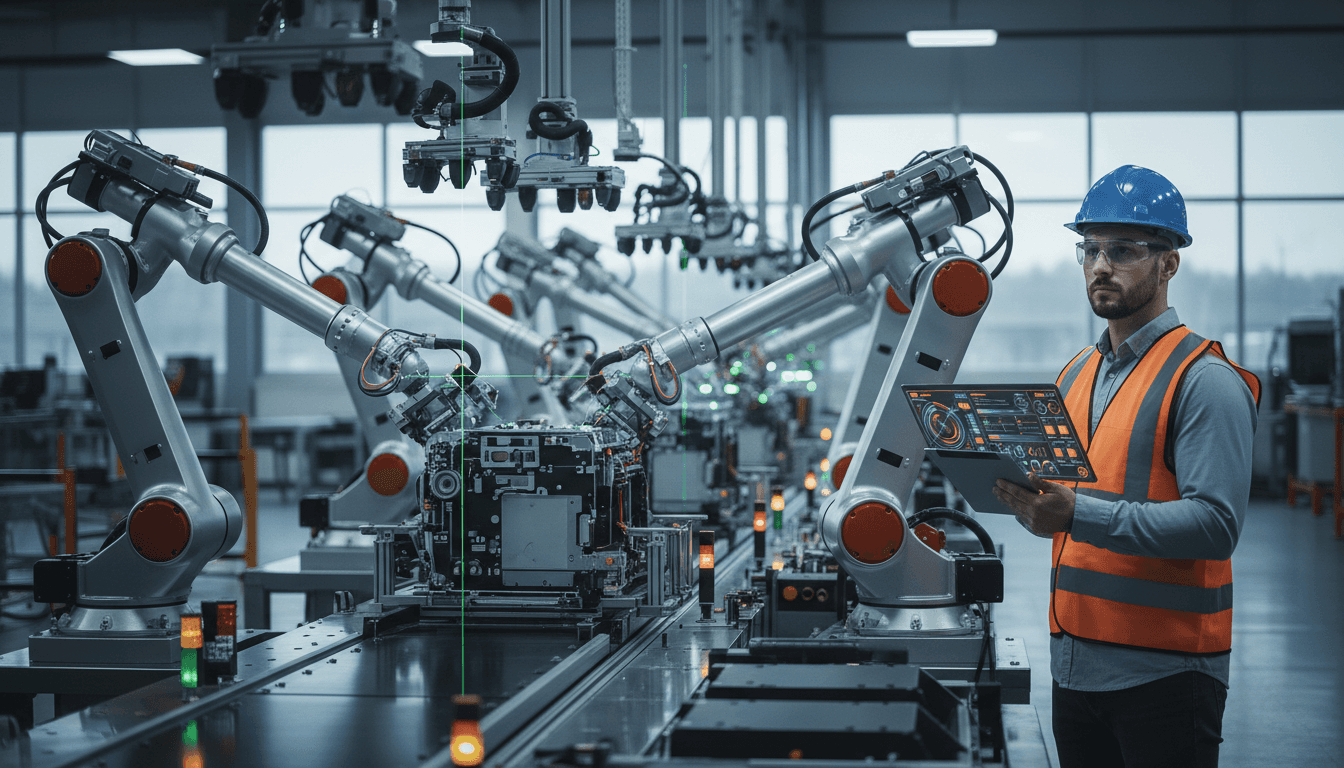

Gde AI donosi najveću vrednost u proizvodnji — bez preuzimanja nepotrebnog rizika

Odgovor odmah: počnite tamo gde je problem merljiv, a posledice greške ograničene.

Tri „sigurna“ startna slučaja upotrebe u Srbiji (posebno za SMB i mid-market proizvođače):

-

Prediktivno održavanje (predictive maintenance)

- koristite istorijske podatke senzora i zastoja

- cilj: smanjenje neplaniranog zastoja i bolji plan servisa

- kontrola: AI predlaže, planer potvrđuje

-

Vizuelna kontrola kvaliteta (computer vision)

- detekcija grešaka na proizvodu, pakovanju, etiketama

- cilj: manje škarta i reklamacija

- kontrola: uzorci, pragovi pouzdanosti, ručna provera sumnjivih slučajeva

-

Automatizacija izveštavanja i dokumentacije (generativna AI uz RAG)

- izrada nacrta SOP/QA izveštaja iz internih dokumenata

- cilj: brže administrativne aktivnosti

- kontrola: rad isključivo nad internom bazom znanja, obavezna ljudska revizija

Ovo su projekti koji grade kulturu i disciplinu, pre nego što pređete na zahtevnije: optimizaciju planiranja, dinamičko raspoređivanje resursa ili autonomno upravljanje parametrima procesa.

Brza Q&A: pitanja koja najčešće čujem od direktora i menadžera

Da li treba da zabranimo AI u firmi?

Ne. Treba da zabranite nekontrolisanu upotrebu. Razlika je ogromna.

Kako da budemo „EU-ready“ sa AI projektima?

Uvedite standardne artefakte: procena rizika, evidencija podataka, logovi, procedure za incident, i ugovorne klauzule sa dobavljačima AI rešenja.

Šta je minimalni prvi korak već ove nedelje?

Napravite 60-minutni interni sastanak i donesite 3 odluke:

- koje podatke AI nikad ne sme da vidi,

- ko odobrava AI alate,

- koji je prvi pilot sa jasnim KPI.

Sledeći potez za industriju u Srbiji: brzina uz disciplinu

Slučaj Grok je neprijatna, ali korisna lekcija: ako sigurnost nije deo dizajna, postaće deo skandala. U industriji, skandal se često zove drugačije — reklamacija, audit finding, incident, penali — ali mehanizam je isti.

Ako želite da veštačka inteligencija stvarno transformiše proizvodnju u Srbiji (kako i obećava ovaj serijal), put nije u tome da budemo najbrži u usvajanju svakog novog alata. Put je da budemo najpouzdaniji u njegovoj upotrebi.

Šta biste radije čuli od EU partnera u 2026: „Brzi ste“ ili „Možemo da vam verujemo“?