Az ellenőrizhető, auditálható AI-ügynökök nélkül nincs biztonságos autonómia az egészségügyben. Nézd meg, mit ad a Verifiability-First megközelítés.

Ellenőrizhető AI-ügynökök: bizalom a diagnosztikában

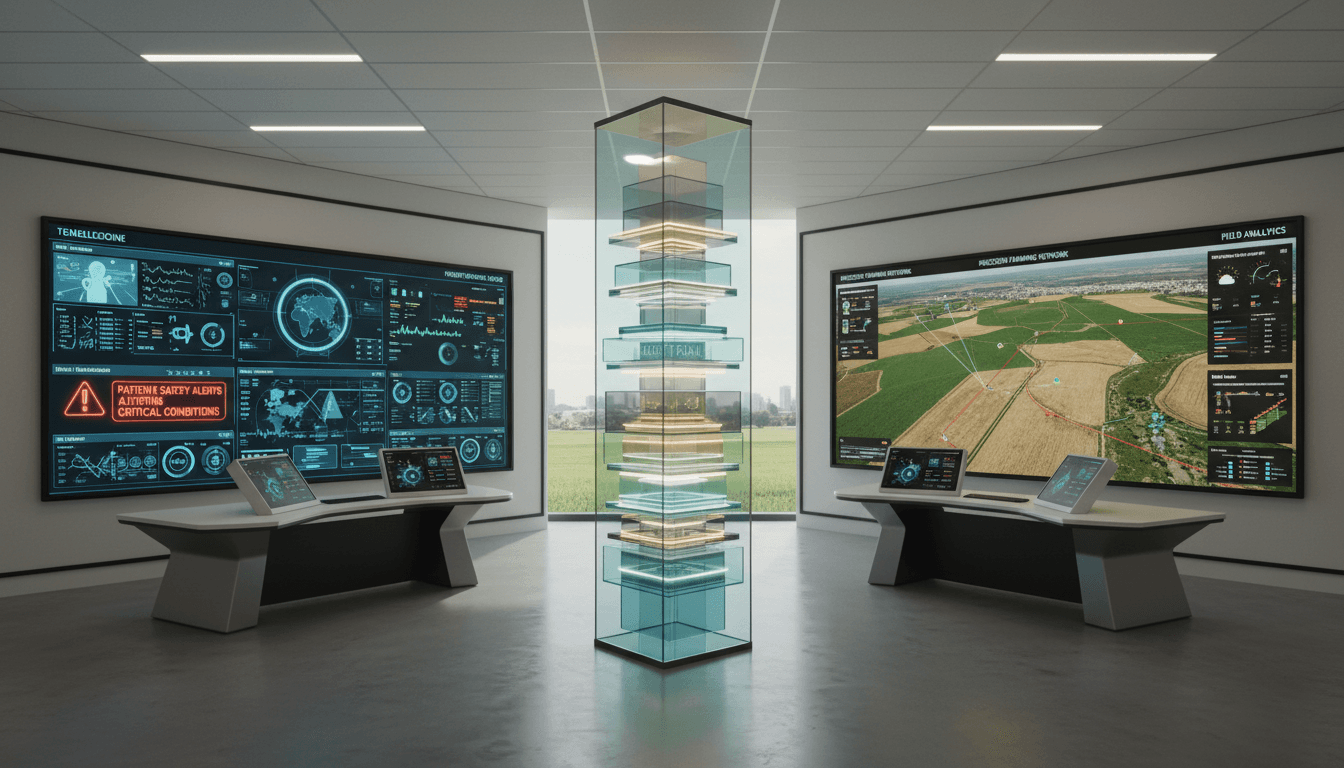

2025 végén egyre több szervezet nem „chatbotot” vezet be, hanem autonóm AI-ügynököt: olyat, ami eszközöket használ, adatokat kér le, javaslatokat ad, sőt bizonyos folyamatokat el is indít. Az egészségügyben ez csábító (gyorsabb triázs, okosabb telemedicina, kevesebb admin), de van egy kellemetlen mellékhatás: ha nem tudjuk bizonyítani, mit tett az ügynök és miért, akkor valójában nem kontrolláljuk.

A most megjelent kutatás (Verifiability-First Agents) szerint az értékelés fókuszát el kell tolni: nem elég azt mérni, hogy mennyire valószínű a félrecsúszás (misalignment), hanem azt kell mérni, hogy milyen gyorsan és megbízhatóan észlelhető és javítható, ha az ügynök eltér a szándékolt működéstől. Nekem ez különösen ismerős a kritikus rendszerek világából: nem attól lesz biztonságos egy rendszer, hogy „reméljük, nem hibázik”, hanem attól, hogy hibázás esetén nyomot hagy, megállítható és visszafejthető.

És igen: miközben ez a cikk a többügynökös LLM-rendszerekről szól, a tanulság meglepően jól illik a precíziós mezőgazdaság világához is. A gazdaságban ugyanúgy megjelennek az autonóm döntési láncok (permetezés időzítése, öntözés, hozam-előrejelzés), és ott is ugyanaz a kérdés: ha baj van, ki és hogyan bizonyítja, mi történt?

Miért pont a „bizonyíthatóság” a szűk keresztmetszet?

A lényeg egyszerű: az autonóm LLM-ügynök nem csak szöveget generál, hanem cselekszik. Eszközökhöz fér hozzá (adatbázis, EHR, naptár, rendelési rendszer), láncolt lépéseket hajt végre, és a „személyisége” vagy a kapott rejtett instrukciók is befolyásolhatják.

Az egészségügyben ez azért kritikus, mert a kockázat nem csak pénzügyi vagy reputációs. Betegbiztonsági kérdés. Egy telemedicinás ügynök például:

- rossz prioritást adhat (pl. sürgős tünetet „ráérősnek” minősít),

- nem megfelelő protokollt javasolhat,

- vagy egy eszközhasználati lépésnél (pl. recept-előkészítés, beutaló generálás) hibás adatot írhat be.

A mezőgazdaságban pedig ugyanez lefordítható:

- rossz időjárási ablakban indítja el az öntözést,

- félreértelmez egy szenzorhibát és túlpermetez,

- rossz táblára ad ki munkautasítást.

A közös pont: ha nincs ellenőrizhető nyomvonal, a hiba utólag „szóbeszéd” marad.

A Verifiability-First megközelítés: ellenőrizhetőség alapból

A cikk három egymásra épülő elemet javasol. Nem a „még okosabb ügynök” a cél, hanem a kontrollálható ügynök.

1) Futásidejű attesztáció: mit tett az ügynök, bizonyíthatóan?

Az architektúra egyik alapköve a run-time attestation, azaz futás közbeni igazolás arról, hogy az ügynök milyen lépéseket hajtott végre. A szerzők kriptográfiai és szimbolikus módszerek kombinálásáról beszélnek.

Egészségügyi példára fordítva: amikor az ügynök lekér egy labort, majd protokoll alapján triázsol, minden eszközhasználat és döntési pont rögzíthető úgy, hogy utólag ne lehessen „szépíteni” a történetet.

Mezőgazdasági analógia: ha egy ügynök drónfelvétel alapján kártevő-gyanút jelez, majd permetezési javaslatot küld, a rendszer képes lehet bizonyíthatóan naplózni, hogy melyik képre, melyik modellkimenetre és melyik szabályra támaszkodott.

2) Könnyű audit ügynökök: folyamatos „szándék vs. viselkedés” ellenőrzés

A második elem a lightweight Audit Agent: egy kisebb, korlátozottabb következtetésre képes modul, amely folyamatosan azt figyeli, hogy a tényleges viselkedés megfelel-e a telepítő (kórház, rendelő, szolgáltató) szándékának.

Ez azért jó irány, mert a „biztonság” sokszor nem egy hatalmas modellből jön, hanem abból, hogy van egy független ellenőr. A korlátozott logika itt előny: kevesebb a kreatív kibúvó, egyszerűbb a validáció.

Praktikus egészségügyi ellenőrzések, amiket egy audit ügynök végezhet:

- Hatókör-ellenőrzés: hozzáfért-e olyan betegadathoz, ami nem kellett a feladathoz?

- Protokoll-követés: megfelel-e a javaslat a helyi triázs szabályoknak?

- Eszközhasználati korlát: indított-e magas kockázatú műveletet (pl. gyógyszerrendelés előkészítés) megfelelő jóváhagyás nélkül?

Agrártechnikában ugyanez:

- Gépkapcsolat-ellenőrzés: adott-e ki parancsot a gépnek tiltott időablakban?

- Dózis-korlát: ajánlott-e a címke/előírás feletti kijuttatást?

- Szenzor-hitelesség: egyezik-e több forrás (talajnedvesség + időjárás + NDVI) jelzése?

3) Challenge–response protokoll: magas kockázatnál ne „csendben” történjen

A harmadik elem egy kihívás–válasz (challenge-response) alapú attesztáció magas kockázatú műveletek előtt. Magyarul: ha az ügynök olyan lépéshez ér, ami nagyot üthet, meg kell állnia és bizonyítania kell, hogy jogosan teszi.

Ez nagyon jól illik egészségügyi környezetben a „kétkulcsos” gondolkodáshoz:

- gyógyszerváltás vagy dózismódosítás előkészítése,

- sürgős ellátási kategória megadása,

- érzékeny adatok exportja.

A mezőgazdaságban pedig:

- automatikus permetezés indítása,

- nagy vízmennyiséget mozgató öntözési ciklus,

- költséges input rendelésének kezdeményezése.

A minta ugyanaz: előbb igazolás, utána végrehajtás.

OPERA benchmark: nem az a kérdés, hogy lesz-e baj, hanem hogy mikor vesszük észre

A szerzők OPERA néven (Observability, Provable Execution, Red-team, Attestation) benchmarkot és értékelési protokollt javasolnak. Nekem ebben a legszimpatikusabb, hogy a metrikák végre „üzemeltetési” szagúak:

- Detectability: mennyire észlelhető a félrecsúszás?

- Time to detection: mennyi idő alatt bukik le, ha az ügynök alattomosan próbál eltérni?

- Resilience: mennyire bírja a rendszer a prompt- és persona-injektálást (amikor valaki rábeszéli az ügynököt, hogy „másként” viselkedjen)?

Ez a logika az egészségügyi AI bevezetésnél aranyat ér. A valódi kérdés sokszor nem az, hogy hibázik-e (hibázni fog), hanem:

„Milyen gyorsan vesszük észre, és vissza tudjuk-e fejteni pontosan, mi történt?”

A telemedicinában például a „time to detection” akár betegbiztonsági KPI is lehet: ha egy ügynök rossz irányba terel betegeket, a rendszernek órákon belül jeleznie kell, nem hetek múlva egy audit során.

A mezőgazdaságban a detektálási idő pénz: ha a rendszer rossz öntözési döntést hoz, a kár pár nap alatt materializálódik (stressz, betegségek, hozamcsökkenés). Itt is számít, hogy az anomália még a következő ciklus előtt kiderüljön.

Hogyan néz ki ez a gyakorlatban egészségügyi AI-nál?

A gyors válasz: úgy, hogy a LLM-ügynök köré ellenőrzési keretrendszert építünk, nem pedig „ráengedjük” a folyamatokra.

Minimális, de működő bevezetési minta (pilothoz)

Ha egy kórház vagy telemedicina szolgáltató most indít pilotot, én ezt a sorrendet tartanám racionálisnak:

- Eszközhasználat szűkítése: először csak olvasás, később írás/indítás.

- Kötelező műveleti napló: minden tool call, paraméter és válasz rögzítése.

- Audit ügynök: szabályalapú és korlátozott logikájú ellenőr (pl. protokollok, hatókörök).

- Kihívás–válasz magas kockázatnál: humán jóváhagyás vagy kriptográfiai attesztációs lépés.

- Red-team gyakorlatok: célzott persona/prompt injekciós próbák.

A legnagyobb hiba, amit látok: az ügynök kap egy csomó eszközt „kényelmi okból”, aztán utólag próbálják megfejteni, mi történt. Fordítva kell.

„People also ask” – rövid, egyenes válaszok

Miben más az auditálható AI, mint egy sima naplózás?

Az auditálható AI nem csak logol, hanem bizonyíthatóan összeköti a döntést az eszközhasználattal és a szabályokkal, és jelzi a szándéktól való eltérést.

Miért kell külön audit ügynök, miért nem elég maga a nagy modell?

Mert a nagy modell egyszerre bíró és vádlott lenne. A külön audit ügynök független, korlátozott, így kiszámíthatóbb.

Hol jön be a persona-injekció a valóságban?

Például belső dokumentumokban elrejtett instrukciókkal, rosszul elkülönített rendszerprompttal, vagy felhasználói üzenetekkel, amelyek rábeszélik az ügynököt tiltott lépésekre.

Mit viszünk át ebből az agrártechnológiába (és miért számít a sorozat szempontjából)?

A „Mesterséges intelligencia a mezőgazdaságban és agrártechnológiában” sorozatban gyakran beszélünk modellekről: betegségfelismerés, hozam-előrejelzés, erőforrás-optimalizálás. A következő szint viszont az, amikor ezekből autonóm ügynökrendszer lesz: javasol, majd cselekszik.

A Verifiability-First gondolat lényege, hogy az autonómia csak akkor vállalható, ha az ügynök:

- megfigyelhető (mi történik),

- bizonyíthatóan végrehajtható/ellenőrizhető (miért és hogyan történt),

- támadható tesztkörnyezetben (red-team),

- és van attesztáció a kockázatos lépések előtt.

Ha ezt most beépítjük agrár rendszerekbe, később sokkal könnyebb lesz a skálázás: kevesebb „fekete doboz” vita, gyorsabb hibakeresés, és több bizalom a döntéstámogatás iránt.

Mit érdemes most megtenni, ha AI-ügynököt tervezel egészségügyben?

A legfontosabb lépés: a verifikálhatóságot követelményként írd be a specifikációba, ne utólagos „compliance” feladatként.

Gyakorlati következő lépések, amik 30 napon belül is elkezdhetők:

- Készíts kockázati műveletlistát (mi számít „high-risk”-nek a szervezetben).

- Határozd meg a minimális attesztációs pontokat (hol kell megállni és igazolni).

- Vezess be audit szabályokat (hatókör, protokoll, eszközhasználat) és mérd a riasztások minőségét.

- Tervezd meg a „time to detection” célt (pl. 30 perc / 4 óra / 24 óra), és monitorozd.

A bizalom nem PR-kampányból épül, hanem abból, hogy egy rendszer akkor is „beszél”, amikor hibázik.

A kérdés, ami 2026-ban egyre több egészségügyi és agrár szereplő asztalán ott lesz: készen állunk-e arra, hogy az autonóm AI-ügynökök döntéseit ne csak elfogadjuk, hanem bizonyíthatóan ellenőrizzük is?