小鹏将智驾与座舱合并为通用AI中心,指向“舱驾融合”的统一大脑。本文拆解组织与技术信号,并对比Tesla路线,给出可落地的产品建议。

小鹏整合智驾与座舱:通用AI中心如何重塑车内体验

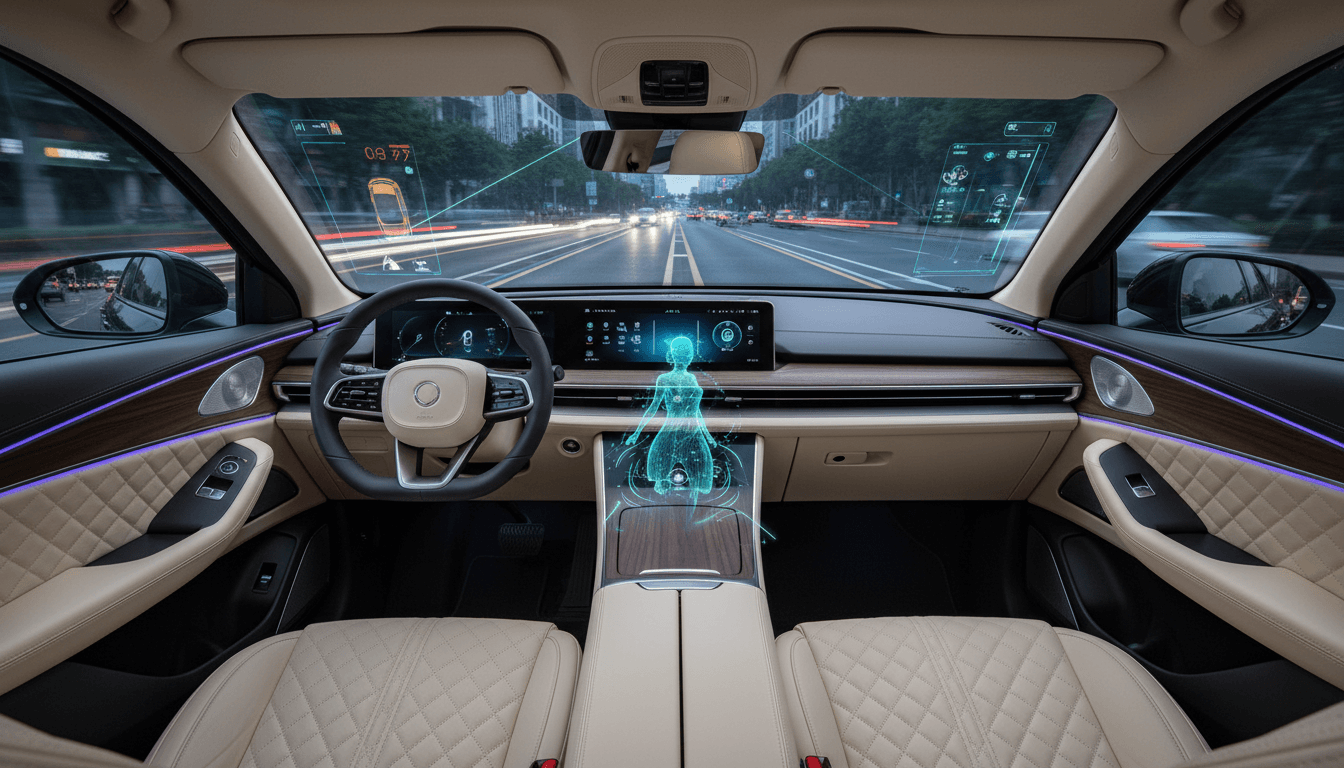

2026-02-04,小鹏把“自动驾驶中心”和“智能座舱中心”合并为通用AI中心(General AI Center),并由原自动驾驶负责人刘贤明统筹、直接向何小鹏汇报。很多人第一反应是“组织架构调整而已”。我更愿意把它看成一句更直白的宣言:未来车里不再有两套AI,而是一套统一的大脑。

这件事之所以值得写进我们《自动驾驶 AI:Tesla 与中国车企的发展路径对比》系列,是因为它触及了一个长期被忽视的问题:**智驾AI与座舱AI分家,用户体验往往也会分裂。**你会在同一辆车上看到两种完全不同的“聪明”:智驾很强,但座舱像另一家公司做的;座舱语音很会聊,但对驾驶意图毫无感知。

小鹏的合并动作,恰好把行业的焦点从“单点能力PK”拉回到“体系能力”。这对中国车企尤其关键:我们要做的不只是对标 Tesla 的端到端路线,还要做出更贴近本土场景、更符合中文交互习惯的车内超级智能体。

为什么“智驾+座舱”分开做,会直接伤到用户体验?

答案很简单:**同一辆车里出现两套模型、两套数据闭环、两套发布节奏,最终表现为两套性格。**用户不会在意你内部叫“ADAS”和“Cockpit”,他们只会觉得“这车时灵时不灵”。

过去不少车企把智驾当“安全关键系统”,把座舱当“互联网产品”。结果是:

- OTA节奏碎片化:智驾更新谨慎、周期长;座舱更新频繁、功能碎。

- 数据打不通:座舱知道用户在找充电桩,却不一定能把意图传给路线与驾驶策略;智驾看到前方施工,却不一定能主动在座舱里用自然语言解释。

- 交互割裂:同一句“我有点赶时间”,座舱可能只会打开导航;而真正该做的是综合路况、能耗、驾驶风格、辅助驾驶策略,给出可解释的方案。

这也是为什么行业开始强调舱驾融合:不是把两个部门硬拼到一起,而是让它们在“同一套AI中间层”上协同,形成一致的用户体验。

通用AI中心到底在做什么:一套“AI中间层”支撑多业务

从披露的信息看,小鹏通用AI中心的关键词包括:基础模型、基础设施平台、标准化交付系统、产品与项目质量。这几项看似“后台”,但决定了你能不能把AI真正做成产品。

1)统一基础模型:从“功能AI”走向“代理式AI”

行业正在从“一个功能一个模型”(例如语音、泊车、NOA)转向“一个代理多任务”。在车内,这种代理更像“总管家”:

- 听懂自然语言(VLM/VLA 相关能力)

- 理解驾驶与出行意图

- 能把意图转成可执行动作(导航、设置车速策略、座椅空调联动、充电规划等)

小鹏提到的第二代 VLA(Vision–Language–Action) 模型计划于 2026-03 开始推送,并强调跨域能力覆盖车辆、Robotaxi、人形机器人、飞行汽车。这里的要点不在“概念大”,而在于:VLA天生需要统一的动作空间与工具链,否则“能看能说”但“不会做”。

2)统一基础设施:把数据闭环做成规模化生产线

大模型时代,真正昂贵的是:数据治理、训练/评测、灰度发布、在线反馈。

把智驾与座舱放在同一组织下,有两个直接收益:

- 数据互补:座舱产生的意图数据(目的地、偏好、对话)能帮助智驾做更符合用户习惯的决策;智驾产生的环境与风险数据能让座舱做更可信的解释与提示。

- 评测一致:同一套质量标准(比如幻觉率、指令误触发率、场景覆盖率、故障回退策略)可以贯穿“说—看—做”的全链路。

我见过不少团队“模型很强但产品翻车”,原因往往不是模型参数不够,而是没有可重复、可规模化的交付体系。

3)标准化交付:让OTA不再像“拆盲盒”

用户对车载AI最敏感的不是“新增了什么功能”,而是:

- 我常用的功能会不会变难用?

- 开车过程中会不会突然弹出奇怪提示?

- 出错时能不能明确回退?

当智驾与座舱由同一通用AI组织做“标准化交付”,更有机会做到:

- 同步灰度:同一批用户同时获得“策略变化+交互解释”

- 同步回滚:发现问题可以一键回退到一致的稳定版本

- 同步体验:智驾决策变化会有座舱解释跟上,而不是沉默地“自己改了”

硬件信号很明确:三颗图灵芯片不是炫技,是分层架构

2026-01-08 小鹏发布的新车型中,Ultra 版本搭载三颗图灵芯片:两颗用于自动驾驶,一颗用于智能座舱,并明确座舱侧芯片用于跑 VLM 模型。

这里释放的信号是:小鹏在做“算力分区+模型分层”。

- 智驾侧更强调确定性、安全域、实时性(Latency 与冗余)

- 座舱侧更强调多模态交互、内容生成、个性化

- 通用AI中心的任务,是让这两类算力分区在同一套“工具与记忆系统”上协同,而不是各自为政

这也回应了一个常见误区:舱驾融合不是把所有东西塞进一颗大芯片里。相反,合理的分区更利于安全合规与稳定体验。

对比 Tesla:相似的方向,不同的“本土化落点”

答案先给出来:融合路线会越来越像,但中国车企更有机会在“本土体验与生态协同”上做出差异。

新闻里提到行业观察者引用 Tesla 的例子:FSD 与 Grok 的融合趋势,以及 Tesla 向机器人 Optimus 倾斜(包括资金与产线调整)。从组织逻辑看,这是一种“用统一AI底座支撑多形态硬件”的路径。

小鹏这次通用AI中心,也是在做类似的底座化。但中国市场的落点会更具体:

1)中文语境的交互不是翻译问题,是习惯问题

中文车载语音的难点常在“省略、语气、场景暗示”。例如“我有点冷”“这段路别太快”“找个能停车买咖啡的地方”。

如果座舱与智驾共用意图理解与行动编排,体验会从“语音助手”升级成“出行助理”。这也是本土品牌能拉开差距的地方:对中文表达与本地出行链路的理解,积累越久越值钱。

2)本地生态协同更深:导航、充电、停车、支付一体化

很多用户期待的其实是“一句话完成任务”,而不是“打开某个App”。当通用AI中心提供统一中间层,车企更容易把这些能力做成标准工具:

- 目的地与行程:路线、拥堵、限行、停车可用性

- 能源与补能:充电站排队预测、到站电量、费用估算

- 车内体验:座椅、空调、音乐与驾驶模式的联动

这类“链路型体验”往往比单点智驾更能影响复购与口碑。

对产品团队的启示:做“超级智能体”,先把三件事做对

如果你在车企/供应链负责智能座舱、自动驾驶AI或用户体验,通用AI中心这类组织变化给了三条可直接落地的建议:

1)先统一“意图层”,再谈模型有多大

把用户的目标抽象成稳定的意图接口(例如:赶时间/舒适优先/儿童在车上/低电量等),让智驾、导航、能耗、座舱都消费同一份意图。意图层稳定,底层模型迭代才不会把体验打碎。

2)建立跨域的“可解释”标准

舱驾融合之后,可解释不是锦上添花,而是安全与信任的一部分。建议至少统一三类话术与展示规范:

- 为什么减速/变道/退出辅助驾驶

- 为什么推荐这条路线/这个充电站

- 用户指令无法执行时的替代方案

一句话原则:车的每个关键动作,都要能用人话解释。

3)把OTA当成“质量工程”,不是“功能上新”

标准化交付系统的意义在于可控。建议用可量化指标约束发布:

- 指令误触发率(座舱)

- 幻觉触发率(生成式内容)

- 场景通过率(智驾关键场景)

- 回退成功率与平均回退时间

这些指标一旦跨域统一,用户就会明显感到“越来越稳”,而不是“越来越花”。

这一步对小鹏意味着什么:从车企到“物理AI公司”的门槛

小鹏在公开表述里多次强调“汽车与AI深度跨域融合”,并把舱驾融合后的形态称为“超级智能体”。结合通用AI中心的组织与三图灵芯片的硬件配置,我的判断是:小鹏在赌一件事——用统一AI系统把车、机器人、飞行汽车的研发方法论打通。

这条路当然难。因为越底座化,越考验工程组织能力:数据、评测、交付、质量、合规,每个环节都不能短板。但好处也清晰:一旦底座跑通,产品线扩张会更快,体验一致性也更强。

对用户来说,舱驾融合不是“更会聊天”,而是“更懂你要去哪里、要怎么去、以及为什么这么做”。

如果你在关注“自动驾驶 AI”到底如何真正影响用户体验,小鹏这次的通用AI中心就是一个非常值得持续观察的样本:它把竞争从“某个功能领先”带到了“体系化交付领先”。接下来真正的看点是 2026-03 的 VLA 推送之后,用户是否能感受到驾驶与座舱像同一个人一样在思考。

你更期待车载AI先在哪个环节变得更像“超级智能体”——驾驶决策、语音交互,还是出行链路的一句话搞定?