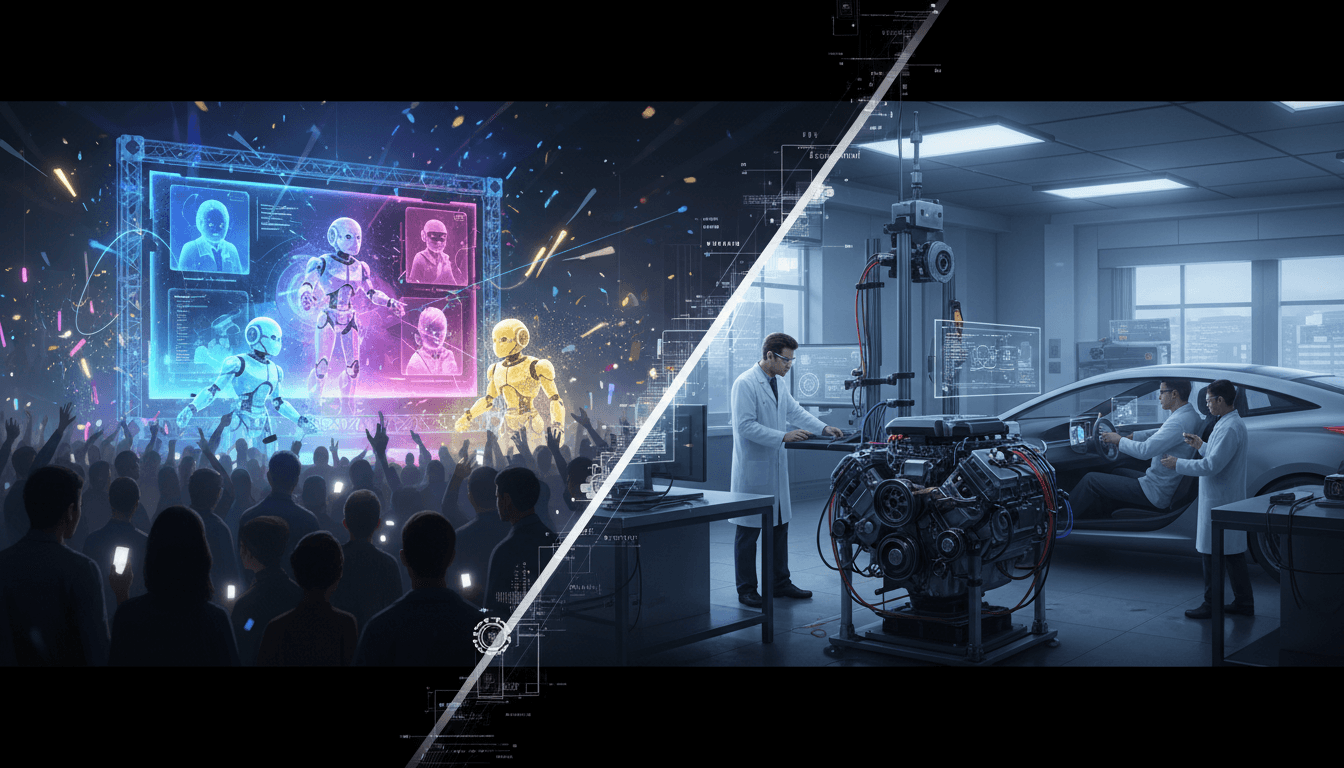

Moltbook式的AI热闹更像观赏运动,而汽车AI必须回到工程化:协调、共享目标与共享记忆。对比特斯拉与中国车企,差异在底座与复利。

AI热闹不等于AI能力:特斯拉与中国车企的关键分野

2026-02这波“Moltbook”热潮很说明问题:一个号称“AI 机器人社交网络”的平台突然爆火,大家围观AI智能体互相“对线”、互相协作、甚至替人谈判买车。结果很快就被揭开——大量内容是人类在背后“遥控”,平台里还充斥着加密诈骗与噪音。这更像一场观众围观的表演赛,而不是可靠的生产系统。

这件事对汽车行业尤其刺眼。因为车企也在经历同样的诱惑:把AI做成“看起来很聪明”的舞台效果,还是把AI当成一门工程学科,能在复杂环境里持续交付稳定能力。站在“人工智能在社交平台与内容审核”这个系列的语境里,我更愿意把Moltbook当作一次公开的压力测试:它暴露了没有协调、没有共享记忆、没有共同目标的“群体智能”有多容易变成喧闹的内容场。

而当我们把这种“AI剧场”对照到智能汽车,就能看清一个长期被忽略的分野:特斯拉与中国汽车品牌在人工智能战略上的核心差异,不在于谁更会讲故事,而在于谁更愿意为“可复现、可迭代、可规模化”的AI能力付出组织与系统成本。

Moltbook像“宝可梦对战”,汽车AI也有同款幻觉

直接结论:**Moltbook的爆火不是AI智能体成熟的信号,而是“AI可被围观”的信号。**它更像当年Twitch Plays Pokémon(2014)那类大众参与的网络实验——热闹、好玩、能引发媒体想象,但对“未来生产力”的证明有限。

Moltbook里最有代表性的机制,是“智能体之间互相互动、互相展示”。这会天然激发一种竞赛心理:谁的智能体更像人、更会聊天、更能做出“惊喜操作”。Jason Schloetzer把它形容成一种“观赏性运动”,只不过比赛选手从宝可梦换成了语言模型。

把镜头拉回汽车行业,很多“车载AI演示”也存在类似结构:

- 观赏性强:语音对话更自然、车机会开玩笑、能生成图文、能“情绪价值拉满”。

- 可用性弱:一到弱网、噪声、方言、多人混说、跨App、跨域指令,就掉链子。

- 责任边界模糊:说错话、乱推荐、误操作,最后往往变成“用户体验问题”,而不是“系统工程问题”。

一句话概括:当AI被当作表演项目,它就会优化“看上去聪明”;当AI被当作工程项目,它才会优化“持续正确”。

真正的“可用智能体”,缺的不是模型,而是三样基础设施

先给答案:**智能体要从热闹走向可用,关键在协调机制、共享目标与共享记忆。**这正是Moltbook暴露的短板,也恰好对应车企做“车端智能体”绕不开的难题。

1)协调:从“各说各话”到“可控的多智能体协作”

Moltbook的混乱,来自缺少统一的任务编排与权限系统。汽车里同样如此:车机、导航、座舱、底盘、智驾、手机互联、第三方应用,如果没有一套“谁能调用谁、什么时候能调用、调用失败如何降级”的编排体系,所谓智能体很快就会变成“会聊天的接口胶水”。

落地做法通常包括:

- 任务路由(

intent routing):把用户意图稳定分发到正确子系统 - 权限与安全(policy):涉及驾驶相关能力必须强约束、可审计

- 降级策略:模型不确定时,明确转为规则/搜索/人工确认

2)共享目标:从“讨好用户”到“完成任务并承担约束”

社交平台上的智能体喜欢“迎合”,因为点赞与转发就是目标函数。但汽车里的目标函数更硬:安全、合规、可解释、可回滚。

这也是我们在内容审核领域常讲的一个原则:把“互动率”当北极星指标,系统就会把噪音放大;把“准确率+风险成本”当北极星指标,系统才会学会克制。

3)共享记忆:从“这一句很聪明”到“长期一致”

Moltbook让人兴奋的“灵光一现”,往往不可复现;更别说跨天、跨设备、跨场景的一致性。车载智能体如果没有可控的记忆层(用户偏好、车辆状态、历史任务、权限记录),就会出现:

- 今天记得、明天忘了

- 车上记得、App里不认

- 说过的承诺无法追溯,出问题难定位

在“舆情分析与内容合规审核”的语境里,这对应的就是可追溯证据链:你得知道系统为什么这么回答、引用了什么、经过了哪些过滤与策略。

把Moltbook当镜子:特斯拉与中国车企AI战略的三处差异

先说结论:特斯拉更像在做“统一的工程底座”,而不少中国车企更擅长“快速产品化与场景包装”。两者都能成功,但成功的路径完全不同。

我不站队“谁更强”,我更在意:你是想要短期话题,还是长期能力复利。

差异一:AI是“整车操作系统的一部分”,还是“座舱功能模块”

特斯拉的AI叙事核心长期围绕自动驾驶与端到端系统(数据闭环、训练、部署、验证)。这意味着AI不只是车机里一个应用,而是贯穿传感、决策、执行、回传的系统工程。

不少中国车企的AI亮点更集中在座舱:大模型上车、智能语音、情感陪伴、内容生成。这能更快带来用户可感知的提升,也更容易营销。但风险是:

“AI体验”如果主要由对话生成支撑,就很容易滑向Moltbook式的表演——能说会道,但在关键任务上不稳定。

差异二:数据闭环是“主战场”,还是“加分项”

智能体不是靠一次演示赢的,而是靠大量真实场景的失败样本迭代出来的。汽车AI尤其如此:噪声、口音、道路长尾、传感器异常、用户误操作。

特斯拉式路径强调把数据回流与训练迭代做成“流水线”。很多中国车企也在补这课,但组织形态与供应链结构更复杂:

- 多供应商并行(芯片、算法、地图、座舱OS)导致数据标准与回流链条更碎

- 车型与配置繁多导致训练与验证成本指数上升

这不是能力问题,是系统结构问题。

差异三:对外展示“像人”,对内验收“像工程”

Moltbook的教训是:**越像人的东西,越容易被观众高估。**汽车AI发布会如果把重点放在“拟人化”“会聊天”“情绪价值”,就会天然诱导市场把它当作通用智能。

更成熟的做法是把验收指标讲清楚,哪怕不性感:

- 关键指令成功率(按噪声/口音/多人场景分桶)

- 高风险意图拦截率(比如驾驶中视频、分心诱导)

- 幻觉率与拒答策略(何时必须“我不知道/需要你确认”)

- 故障可回放与可审计(对合规与售后都关键)

这套指标,其实跟社交平台的内容合规审核很像:不是看它多会说,而是看它在灰区与高风险场景能否稳定守住边界。

给车企与团队的“反AI剧场”清单:把热闹变成能力

先给答案:**想避免把汽车AI做成“观众运动”,就要把可用性、可控性、可审计性写进产品定义。**下面是一份我建议团队直接拿去开评审会的清单。

1)把“智能体能力”拆成三层验收

- 展示层(Demo):自然语言、交互流畅

- 任务层(Task):能稳定完成高频任务(导航、空调、音乐、充电、维保)

- 安全层(Safety/Compliance):高风险意图必须强约束与可追溯

只做展示层,很容易成为Moltbook。

2)建立“内容审核式”的车载AI治理

把社交平台治理经验迁移到车载AI很有效:

- 策略引擎:对驾驶场景、儿童模式、隐私信息输出做硬规则

- 分级响应:低风险直接答;中风险要求确认;高风险拒答并解释原因

- 审计日志:记录触发了哪些策略、调用了哪些工具、依据是什么

这会显著降低“AI说错一句话”引发的舆情风险。

3)把“共享记忆”做成产品资产,而不是隐性缓存

记忆不是越多越好,而是可控、可删、可迁移、可解释:

- 用户能一键清除记忆与个性化

- 记忆按类别授权(偏好/联系人/行程/车辆状态)

- 记忆跨端一致(车机、App、云端)且有版本控制

这既是体验问题,也是合规与信任问题。

2026年的判断:AI热潮会反复,但“工程化AI”会赢得复利

Moltbook提醒我们一件事:**大众对AI的兴奋,常常来自“它像人”;而真正改变行业的AI,往往来自“它像系统”。**社交平台的AI智能体也好,车载智能体也好,一旦规模化,就必须回到老派但有效的路线:指标、约束、编排、日志、迭代。

把特斯拉与中国车企放在同一张图里看,我更愿意把差异总结为一句可引用的话:

特斯拉更像在押注“AI作为工程底座的复利”,而不少中国车企更像在押注“AI作为产品卖点的增长”。

如果你负责的是品牌、产品或合规,我建议接下来一个季度就做两件事:第一,把车载AI的高风险场景清单(驾驶中、未成年人、隐私、金融交易等)像内容审核那样体系化;第二,把“可审计的任务成功率”作为对外宣传与对内迭代的共同语言。

下一次当某个“AI社交热潮”再度刷屏时,不妨换个问题:这到底是一次好看的表演,还是一次能在复杂现实里持续交付的系统能力?