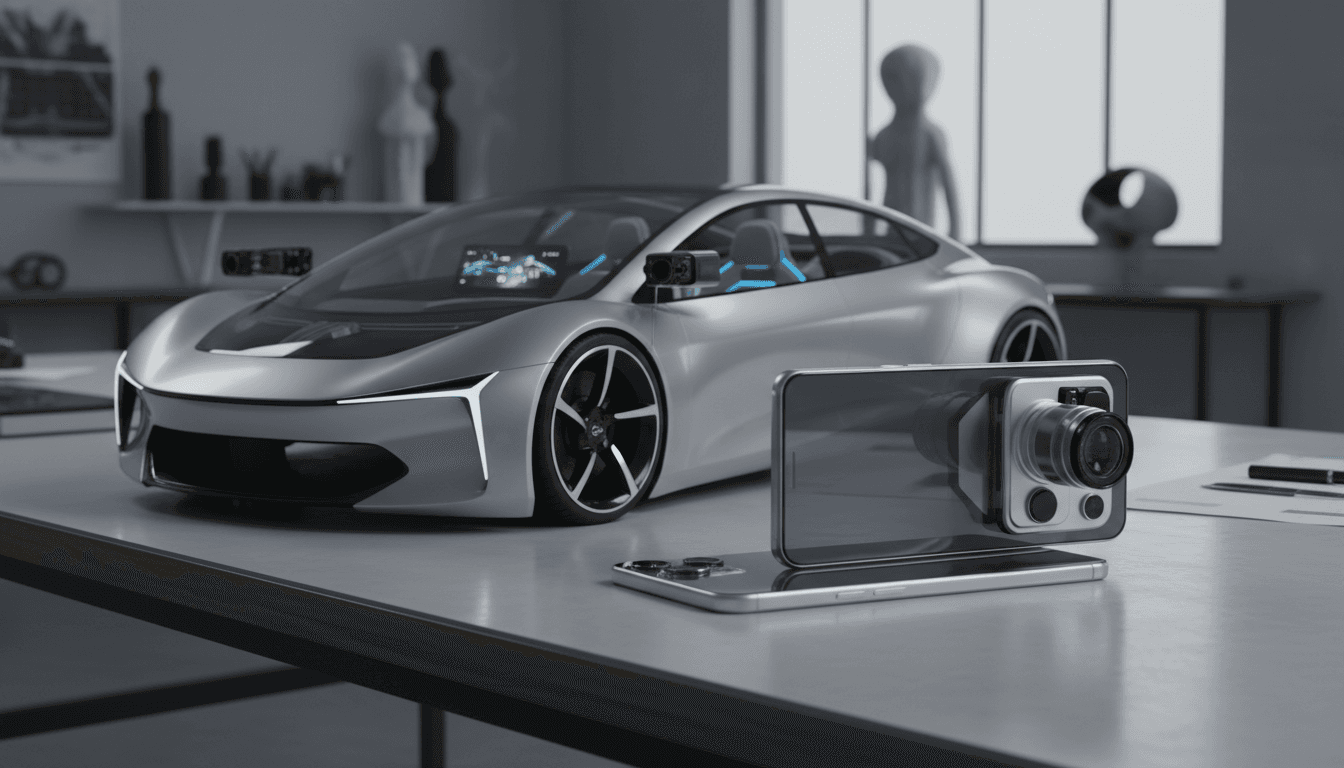

小米磁吸镜头量产释放信号:模块化硬件+端侧AI+高速数据链路正在重塑体验。把这套思路映射到汽车座舱与车载相机,能更快做出可感知的AI升级。

小米磁吸镜头量产:AI+模块化如何重塑车载软件体验

2026-02-05 的一条行业消息很耐人寻味:小米磁吸式可拆卸镜头模块据称已进入量产,最快可能在今年登场。表面看,这是手机影像圈又一次“堆料升级”。但我更愿意把它当成一个信号——硬件模块化 + 端侧AI + 高速数据链路,正在把“体验”从单一设备扩展到整个智能生态。

这件事对汽车行业尤其重要。因为智能座舱、车载相机、车云协同、软件定义汽车(SDV)都在走同一条路:不是把功能塞进菜单,而是让硬件与软件像一个整体那样工作。你会发现,小米这套磁吸镜头的思路,和国内车企在做的“AI座舱”“端云一体”“可插拔生态”几乎同构。

下面我从这条消息出发,拆开讲三个问题:这套镜头系统到底“新”在哪;它背后的AI与数据通路意味着什么;以及它对汽车软件与用户体验(也是本系列“人工智能在汽车制造”的延伸话题)能提供哪些可落地的启发。

磁吸镜头系统到底改变了什么:把“相机”变成可升级模块

核心变化:它把手机影像从“封闭的一体化组件”,变成“可拆卸、可扩展的模块”,而且尽量不牺牲便携与易用性。

据报道,最接近该描述的产品是小米曾展示的 Modular Optical System(模块化光学系统):

- 磁吸式可拆卸镜头模块,不用线缆

- 采用定制化 M4/3(Micro Four Thirds)传感器

- 全非球面镜组

- 1亿像素输出

- 等效35mm焦段 + f/1.4大光圈

这组参数有两个“体验层”的含义:

35mm + f/1.4:不是参数党,是“拍出来像样”的默认值

35mm 在摄影里是非常“顺手”的焦段:视角自然,街拍、人像、旅行都不别扭。f/1.4 则是低光与虚化的硬通货。它们组合起来的价值是:

- 夜景、室内、餐厅等弱光场景更稳

- 背景虚化更接近真实光学效果,不完全依赖算法“抠图”

对用户来说,这减少了“我明明买了旗舰,却拍不出好照片”的挫败感。好体验往往不是更多按钮,而是更好的默认行为。

不用电池、不用配对、没线缆:真正的“随用随走”

报道提到该系统不需要外置电池、无需配对流程、没有线缆。这些“减法”很关键:

- 省掉连接失败、耗电焦虑、收纳麻烦

- 让模块化不再是极客玩具,而是大众可接受的日常工具

模块化真正难的从来不是能不能装上去,而是用户愿不愿意带出门。

10Gbps无损RAW传输 + 端侧大模型:影像链路正在被AI重新定义

核心变化:影像系统的上限,不再由“镜头+传感器”单独决定,而由“光学 + 传感器 + 数据链路 + 端侧AI”共同决定。

这套系统的一个关键信息是:支持接近光速的激光数据传输,速度最高可达 10Gbps,并实现 无损RAW数据传输。同时与 Xiaomi AISP(端侧大模型/计算摄影能力)结合,支持 UltraRAW,动态范围可达 16档(stops)。

把这些术语翻成“可理解的体验语言”,就是:

RAW无损高速传输,让AI能吃到“更干净的食材”

计算摄影很多时候像做菜:原始食材越好,后面调味越容易。手机影像过去的瓶颈在于:

- 数据吞吐不够,RAW链路受限

- 算法只能在较“糊”的中间结果上修修补补

当 10Gbps 的链路把高质量RAW快速送进端侧AI,算法能做的就不仅是“磨皮锐化”,而是更像专业后期:

- 更细的噪点建模与去噪

- 更稳的HDR合成与高光保护

- 更自然的肤色与色彩映射

16档动态范围意味着什么:高光不炸、暗部有细节

“16档动态范围”听起来抽象,但在日常里就是:

- 逆光人像脸不黑

- 夜景霓虹不糊成一团

- 车窗外很亮、车内很暗时,依然能兼顾细节

这点与汽车座舱场景高度同频:行车记录、环视、泊车、舱内DMS/OMS都在面对强逆光、夜间、隧道等极端光照。

一句话:数据链路够快、端侧AI够强,体验就会从“能拍”变成“好拍”。

从手机到车:模块化+AI的“同构”方法论

直接答案:小米磁吸镜头展示的并不是单一品类创新,而是一套可迁移到汽车的软件/硬件协同范式。

汽车行业正在经历“功能电子化 → 软件定义 → AI驱动体验”的阶段。小米这件事能给车载软件与用户体验三点启发。

1)模块化不是装配线概念,而是“体验可定制”的产品哲学

汽车也在走模块化:激光雷达可选装、座舱音响可升级、车载投影与冷暖箱等生态配件越来越多。但很多产品做成了“硬件选装包”,没做成“体验模块”。

更好的方向是把模块当作软件能力的外延:

- 硬件即能力插件:接上就获得新的能力边界(更好感知、更好交互)

- 能力即服务:按场景自动启用,不需要用户学习成本

落到车内体验,可以是:

- 可磁吸/可热插拔的车载摄像头或传感器(比如露营/拖挂/后装场景)

- 面向家庭用户的“儿童看护模块”“宠物模式模块”,硬件只是入口,关键是软件能力闭环

2)端侧AI的价值在于“低延迟 + 隐私 + 可离线”,而不是炫技

小米强调的是端侧大模型参与计算摄影。放在汽车里,同样成立:

- 泊车/环视的实时性要求极高,云端推理不现实

- 舱内摄像头、语音与行为数据涉及隐私,端侧优先是趋势

- 断网、地下车库、偏远地区也必须可用

对车企来说,端侧AI要回答的不是“我用了多大模型”,而是“我在关键场景快了多少毫秒、少了多少误报、离线还能不能用”。

3)高速数据通路是体验工程,不只是硬件规格

10Gbps无损RAW传输本质上是在解决“数据不够用”的问题。汽车同样如此:

- 8MP/12MP 摄像头、环视拼接、哨兵/记录、舱内多摄像头会把带宽压到极限

- 传感器数据在域控与SoC之间的搬运成本,直接决定了延迟、功耗、热管理

因此,车载“好体验”往往从底层架构开始:

- 统一的数据格式与时间同步(避免拼接漂移)

- 高带宽低延迟互联(减少中间拷贝与压缩损失)

- 端侧ISP/AI协同(让计算摄影与感知算法共享更干净的数据)

这与“人工智能在汽车制造”系列的主线也能衔接:**当车企在制造端做数字化与AI质检时,真正的闭环是把道路真实数据反哺到研发、制造与供应链。**而数据链路与端侧AI能力越强,闭环越快。

汽车团队怎么借鉴:三条可落地的产品与工程清单

直接答案:把手机影像的“模块化+AI链路”映射到车载相机与座舱体验,你会得到一套更可执行的路线图。

1)先选一个“高频痛点场景”做闭环

建议从这些最能感知差异的场景入手:

- 夜间倒车/雨天泊车:提升暗部细节与眩光抑制

- 车内视频通话/会议:逆光面部曝光更稳、肤色更自然

- 行车记录关键帧:车牌与路牌在高对比场景下更清晰

指标要量化,比如:

- 端到端延迟降低多少(ms)

- 弱光信噪比提升多少(dB)

- 眩光导致的识别失败率下降多少(%)

2)把“插拔体验”当作第一优先级

参考小米“不用线、不用配对、不用电池”的思路,车载模块要做到:

- 接入即识别:自动标定或半自动标定

- 断开即恢复:系统无崩溃、无黑屏、无残留配置

- 失败可解释:告诉用户哪里没装好/哪里被遮挡

3)建立端侧AI的质量与合规框架

端侧AI上车,最怕的是“好看但不稳定”。建议团队从一开始就建立:

- 数据集分层:白天/夜间/雨雪/隧道/逆光

- 回归测试:每次OTA后自动对关键场景跑一遍

- 隐私策略:舱内数据默认本地处理、最小化存储、可一键清除

常见问题:这类模块化会不会只是噱头?

我的判断:短期内它仍会是“少数人买单”的高端配件,但它代表的方向会扩散到更多品类,包括汽车。

原因很现实:模块化要成功,需要三件事同时成立——价格可接受、携带无负担、系统集成足够顺滑。小米这次把“无配对、无电池、无缆”做到位,至少说明厂商已经在为大众化做准备。

汽车端更是如此:只要某个模块能在高频场景里明显提升体验(比如夜间泊车看得更清楚、雨天识别更稳),用户就愿意为“确定的收益”付费。

写在最后:体验的胜负手在“硬件-软件-数据”一体化

小米磁吸镜头量产这件事,最值得车企学习的不是1亿像素,也不是f/1.4,而是它背后的产品逻辑:用模块化把硬件能力变成可选择的入口,用高速数据链路把高质量数据送到端侧AI,再用算法把复杂性藏起来。

对于正在推进智能座舱、车载相机与SDV架构的团队,我建议把这条逻辑反过来当作自检清单:

- 你的数据链路是否足够“无损、低延迟、可复用”?

- 你的端侧AI是否真正改善了高频场景,而不是只做演示?

- 你的模块化是否降低了用户成本,而不是增加了步骤?

下一次当你在评审一个车载AI功能时,不妨把它当成“可插拔镜头”:**用户装上之后,是不是立刻觉得更好用、更可靠、更省心?**这才是体验升级真正该追的目标。