把语音识别、内容标签与审核串成自动化工作流。对比PyTorch/TensorFlow等5大框架,给小企业可复制的落地蓝图。

5大机器学习框架:把语音助手接入自动化工作流

一线团队最常见的“效率黑洞”,不是缺工具,而是工具彼此不说话:客服录音在网盘里、工单在系统里、内容选题在表格里、审批在群聊里。你雇了更多人,问题只会更贵。

我更愿意把机器学习框架当成“连接器”:它们不是让你从零造一个大模型,而是让你把语音识别、文本理解、推荐与分类这些能力,变成可落地的自动化工作流。对小企业尤其关键——你不需要一个研究团队,你需要的是:今天就能让语音助手帮你把重复劳动消掉。

这篇文章属于「人工智能在媒体与内容产业」系列的一部分,我们会用媒体/内容团队的真实任务做参照:语音转文字、内容标签与审核、用户画像、内容推荐,以及把这些能力串进一套可维护的流程。并且我会给出一个“从录音到发布/工单”的实操蓝图,帮你判断:该选 PyTorch、TensorFlow、Keras、Scikit-learn 还是 Matlab。

先把话说透:框架不是目的,工作流才是

**选框架的正确姿势,是先写出你要自动化的步骤。**框架解决的是“怎么训练/怎么调用模型/怎么部署与监控”,但你真正要的是一条能跑起来的链路:输入、处理、输出、回写系统、日志与回滚。

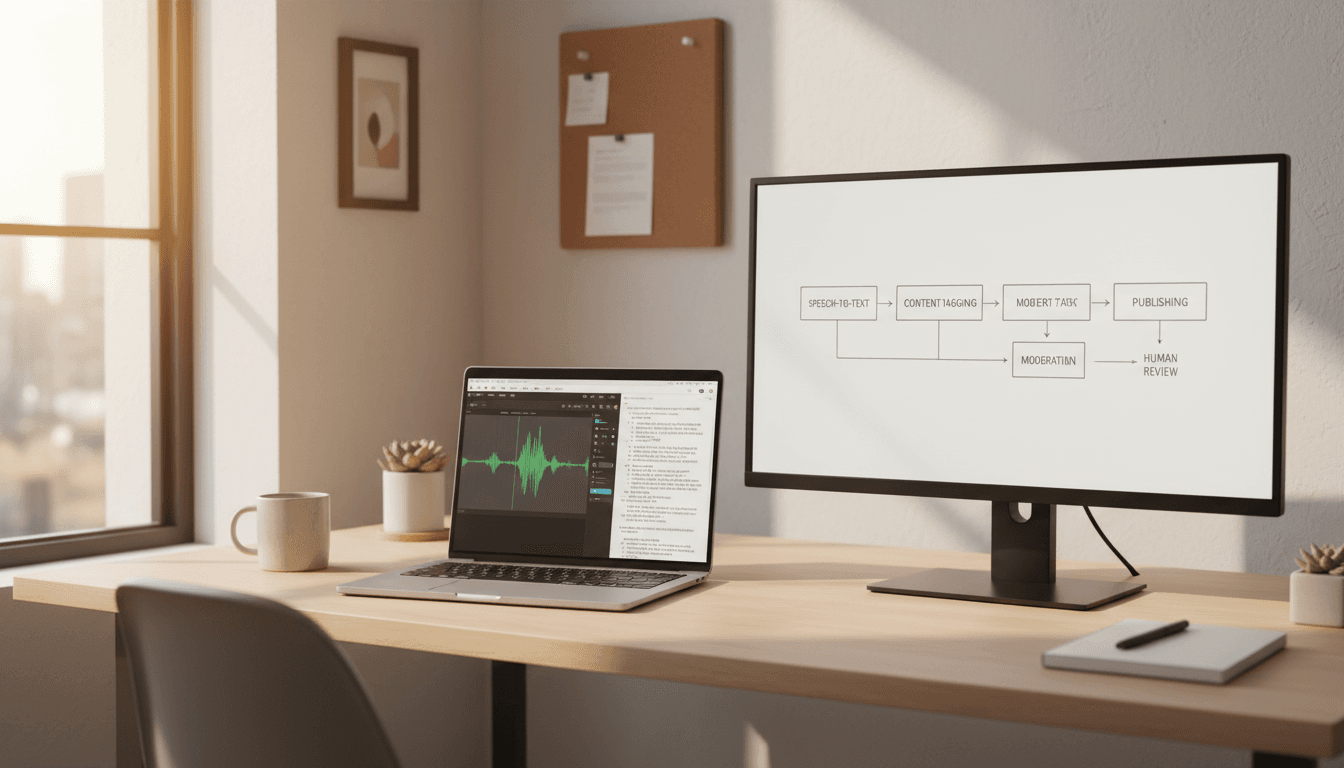

对媒体与内容团队来说,一条高回报工作流往往长这样:

- 采集输入:电话录音、采访音频、直播回放、语音留言

- 语音识别(ASR):转写、区分说话人、加时间戳

- 文本智能处理(NLP):摘要、主题分类、实体识别、敏感信息/合规审核

- 内容生产与分发:生成标题候选、拆条、入库、推送/发布

- 反馈闭环:人工抽检、纠错、A/B 测试、持续优化

一句话概括:机器学习框架让“模型能力”变成“可运营的流程节点”。

小企业最常见的3个误区

- **误区1:先选框架再想场景。**最后通常会变成“我们有个模型,但没有人用”。

- **误区2:追求端到端全自动。**最赚钱的是“半自动”:把80%重复步骤自动化,人只做20%判断。

- **误区3:忽略监控与成本。**语音识别和生成式模型的费用、延迟、错误率不透明,会让流程后期崩盘。

机器学习框架怎么支撑“语音助手 + 自动化任务”?

**语音助手落地,核心不是会说话,而是能办事。**而“办事”意味着:听懂 → 结构化 → 调用系统 → 留痕。

在工程上,你通常会把系统拆成两层:

- 模型层:ASR、分类器、推荐模型、内容审核模型

- 编排层:触发器(新录音/新评论/新工单)→ 队列 → 推理服务 → 写回 CRM/CMS/工单系统

机器学习框架主要影响模型层和推理服务:

- 是否容易训练一个适合你业务的分类/推荐模型

- 是否能稳定部署(CPU/GPU、容器、边缘设备)

- 是否有成熟生态(数据处理、评估、监控、可解释性)

下面按“对小企业工作流自动化的实用程度”来讲五个主流框架,并给出我建议的使用姿势。

PyTorch:做语音与内容模型迭代,最快

**结论先给:如果你要做语音相关(ASR 后处理、说话人识别、情绪/意图分类)或内容理解模型的快速迭代,PyTorch 是优先选项。**它的开发体验更像“写代码解决问题”,而不是“和图计算框架较劲”。

PyTorch 在语音和 NLP 社区特别强势,这对内容产业很关键。一个常见落地方案是:

- 用语音识别把音频转成带时间戳的文本

- 用 PyTorch 训练一个内容标签模型(比如:财经/体育/娱乐、正负面、是否含广告软文倾向)

- 再用规则 + 模型做内容审核(例如识别手机号/地址等敏感信息)

什么时候 PyTorch 最值?

- 你需要自定义:比如把“品牌词库”“栏目规范”“禁用表达”融进模型或后处理

- 你希望迭代快:一周内做出可用版本,再持续优化

- 你团队偏工程:愿意写一点训练与部署代码换取更可控的效果

经验之谈:多数内容团队不是缺“一个大模型”,而是缺“一个能稳定产出一致标签与质量评分的小模型”。PyTorch 很适合干这个。

TensorFlow:要上规模、要工程化,选它更省心

**结论:如果你更在意部署、性能、跨平台(移动端/边缘/服务端)与长期维护,TensorFlow 更稳。**它在生产化工具链上非常成熟:从训练到推理到可视化与分布式训练,都能找到标准做法。

在媒体与内容场景里,TensorFlow 常见于:

- 推荐系统:把用户画像、内容特征、上下文特征融合进排序

- 大规模分类:数百上千标签的内容分类、广告识别、低质内容识别

- 多端部署:内容审核模型需要在客户端预检(比如上传前提示敏感内容)

小企业怎么用 TensorFlow 才不“用力过猛”?

把它当作“标准化生产线”,别一上来就做大而全:

- 先做一个可解释的基线模型(例如宽线性/浅层网络)

- 用清晰指标管理:准确率、召回率、误杀率、推理延迟、单次调用成本

- 先把数据回流管道做通(错标纠正、样本再训练)

Keras:快速原型与团队协作,最友好

**结论:你要快、要让更多人参与(内容运营、数据分析、工程师协作),Keras 的上手成本最低。**Keras 通常作为高层 API 跑在 TensorFlow 上,很适合“先把流程跑起来再说”。

媒体与内容团队经常卡在“模型很强,但上线太慢”。Keras 的价值在于:

- 很快搭出一个能用的文本分类/评分模型

- 代码更短,更容易 review 与交接

- 适合做实验:比如不同特征组合、不同网络结构对内容推荐的影响

一个实用做法:Keras 负责“质量打分”

比如给每条转写稿或文章生成一个 0-100 的质量分:

- 结构完整度(是否有标题/导语/要点)

- 合规风险(敏感词、隐私信息)

- 可读性(句子长度、口头语占比)

然后把分数写回 CMS:低分进入人工复核队列,高分自动进入排版/发布流程。

Scikit-learn:小数据、强基线、立刻见效

**结论:当你数据不大、资源有限、但急需一个“可靠的自动化判断”,Scikit-learn 往往是 ROI 最高的选择。**它不追求“深”,追求“稳”和“快”。

对小企业来说,很多任务不需要深度学习:

- 识别客户来电意图(退款/咨询/投诉/预约)

- 预测内容是否会被投诉(基于历史特征)

- 给用户分群(新客/活跃/沉默/高价值)

这些任务用逻辑回归、SVM、随机森林、梯度提升树就能做出好结果。Scikit-learn 的强项是:

- 数据清洗 + 特征工程 + 训练评估一条龙

- 更容易解释给业务听:为什么把它判为“高风险内容”

- 推理成本低,CPU 跑得动

我的立场很明确:**能用 Scikit-learn 解决的,就别急着上深度学习。**你省下来的时间应该用来把流程打磨好。

Matlab:教学与科研友好,但对小企业不够“轻”

**结论:Matlab 在学术与工程计算、可视化、教学环境里确实舒服;但如果你要做面向业务的自动化工作流,它通常不是第一选择。**原因很现实:生态与部署链路对很多小团队来说偏重。

但也别一棒子打死。Matlab 在以下情况仍然有价值:

- 你团队已有 Matlab 资产(信号处理、音频分析、传统算法库)

- 你要做更偏“工程测量/信号”的内容处理(比如音频质量检测、设备采集端分析)

如果你的内容生产涉及大量音频信号处理(播客、直播、广播),Matlab 的可视化与分析会帮你更快定位问题。

从语音识别到内容分发:一条可复制的自动化蓝图

**答案先给:把语音助手接入工作流的最短路径,是“ASR 结构化 + 分类路由 + 人工抽检”。**别急着让它写稿、写标题、写推送,一步一步来。

下面是一条我建议的“从录音到业务动作”的通用蓝图,特别适合小企业的内容运营与客服/商业化团队协作:

第1步:把语音变成可操作的数据

- 输入:电话录音/采访音频

- 输出:带时间戳的转写文本 + 说话人区分 + 置信度

你真正要保存的不是一段大文本,而是一组结构化字段:

utterances[](分句/分段)speaker_idstart_ms/end_msconfidence

这样后续的摘要、剪辑、引用、合规审核才好做。

第2步:用“轻模型”做路由与队列

用 Scikit-learn 或一个简单的 Keras 分类器,先把内容分流:

- 进入 CMS 选题池

- 进入工单系统(客户需求/投诉)

- 进入商业线索(潜在客户意向)

这里的目标不是100%准确,而是把人从“逐条听录音”里解放出来。

第3步:内容审核与隐私保护必须自动化

媒体与内容产业最容易踩雷的是:把个人信息、敏感内容原样发布。你至少要自动做三类检测:

- 隐私信息:手机号、地址、身份证号、邮箱、车牌

- 合规风险:辱骂、歧视、极端内容、未成年人相关风险

- 商业风险:虚假宣传、夸大承诺

这部分可以是“规则 + 模型”组合:规则负责高确定性命中,模型负责模糊场景。

第4步:把结果写回系统,形成闭环

自动化失败的常见原因是“只做了识别,没有回写”。你需要把字段回写到:

- CMS:标签、风险等级、摘要、候选标题

- CRM/工单:意图类别、紧急程度、关键句引用、下一步建议

- BI:错误率、人工修正率、平均处理时长

当你开始追踪这些指标,模型优化才有方向。

选型速查:按你的阶段来

最省钱的选法,是按团队阶段与目标选框架。

- 你要快速落地一个“能用的自动化工作流”:Scikit-learn + Keras

- 你要在语音/NLP 上做更深的定制与迭代:PyTorch

- 你要规模化部署、跨端、长期维护:TensorFlow

- 你在信号处理/科研/教学环境里积累深:Matlab

如果你只有一个开发者、数据不多、还想先做出结果,我会建议:

- 先用 Scikit-learn 把分类/路由跑通

- 再用 Keras 做质量评分与更复杂的任务

- 当你确认 ROI 后,再把关键模块迁移到 PyTorch 或 TensorFlow 做深度优化

把机器学习框架用在内容产业,真正赚到的是“可重复流程”

内容生产不是一次性项目,它更像工厂:每天都有新素材、新热点、新渠道、新风险。机器学习框架的价值,不是炫技,而是把“语音到行动”的链路变得可复制、可监控、可迭代。

如果你正在规划 AI 语音助手与自动化工作流,建议你从一个小而硬的场景开始:例如“语音留言自动生成工单并分派”,或“采访音频自动转写、打标签、进选题池”。当这条链路稳定后,再把推荐、用户画像、内容审核做深。

下一步你可以问自己一个很现实的问题:**你团队每天在“听、抄、贴、分派、复核”上花的时间,能不能在两周内砍掉一半?**如果答案是能,那就值得把框架选型提上日程了。