火山引擎成为2026央视春晚独家AI云伙伴,标志AI进入大型直播的核心层。拆解多模态AI在制作、互动与分发的落地,并给汽车软件体验可复制的方法论。

央视春晚牵手火山引擎:AI如何把“互动体验”做成规模化产品

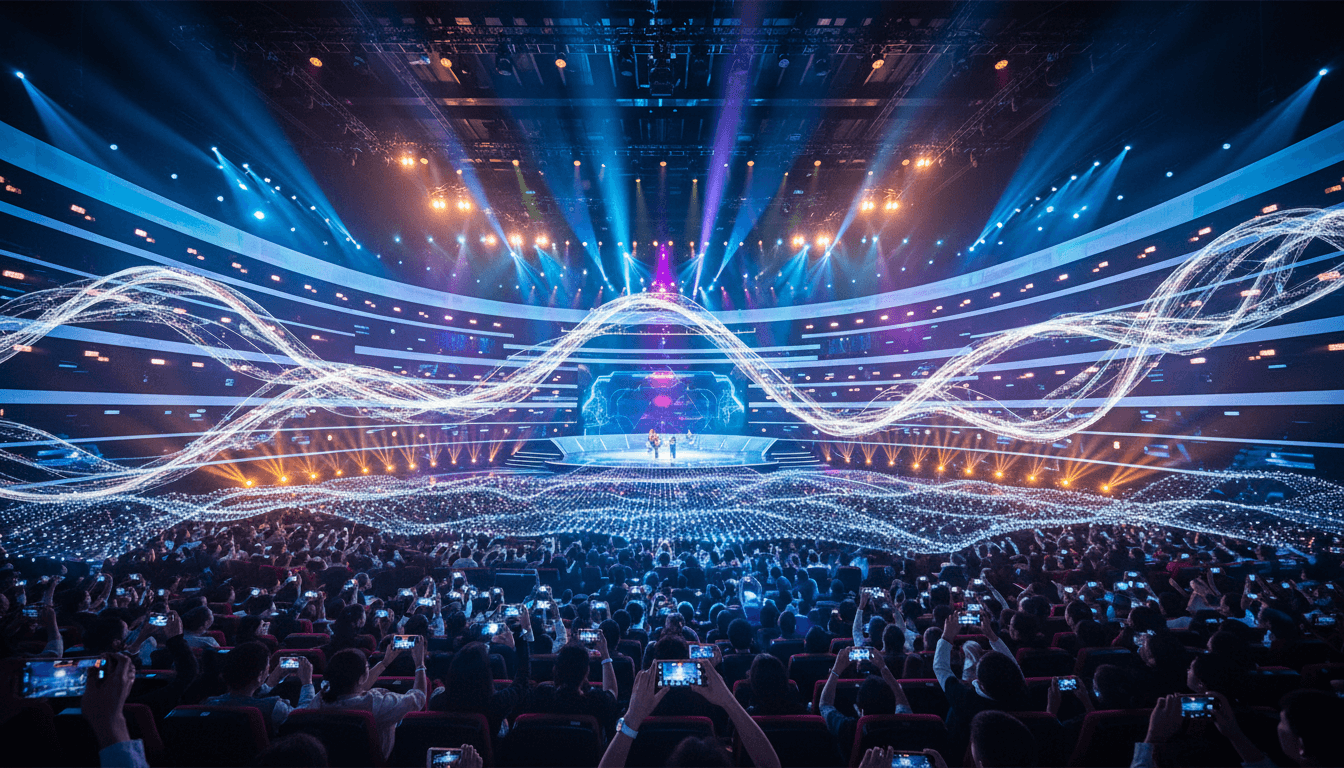

2025-12-29 的一则消息很有意思:字节跳动旗下火山引擎被选为 2026 年央视春晚独家 AI 云合作伙伴。这不是一条“云服务又拿下大项目”的普通新闻,而是一个更明确的信号——AI 正在从“内容生产的辅助工具”,走向“全民级体验的核心底座”。

我一直觉得,真正考验 AI 的不是实验室跑分,而是像春晚这种“高峰值、强实时、强互动、强舆情”的场景:任何卡顿、任何误判都会被放大。火山引擎提到将用多模态大模型与云基础设施支持节目制作、线上互动与直播分发;它过去也连续 5 年支撑抖音春晚直播,并在 2021 年承载过 703 亿次红包互动峰值(源自公开报道数据)。这些数字背后,是一套可以被复制到更多行业的“体验工程方法”。

这篇文章属于「人工智能在媒体与内容产业」系列,我们从春晚这类超级场景出发,拆解 AI 在媒体互动与内容生产中的用法,并把它自然连接到我们更关心的议题:AI 在汽车软件与用户体验中的不同应用方式——因为车机、直播、内容平台,本质上都在做同一件事:让用户在关键时刻“顺滑地参与”。

春晚为什么是AI产品化的“压力测试场”?

答案先说:春晚把 AI 的三项能力同时拉到极限——实时性、规模性、可信度。 你可以在日常 App 里容忍 1-2 秒延迟,但在直播互动里,延迟会直接变成“没参与感”;你可以在小范围活动中试错,但在春晚这种国民级场景里,错误会变成公关事件。

从产品角度看,春晚互动并不只是“发红包”。它至少包含三条链路:

- 内容链路:节目素材生产、智能剪辑、字幕/多语种、审校与合规。

- 互动链路:投票、弹幕、抽奖、红包、AI 助手玩法、联动任务。

- 分发链路:直播推流、CDN、多端适配、网络波动下的体验兜底。

任何一个环节,AI 都不是“锦上添花”,而是会直接影响 观看时长、互动转化、口碑扩散。这也解释了为什么火山引擎强调“深度支持节目制作、在线互动、直播视频播出”——它们是同一套体验目标的不同切面。

多模态AI在春晚的三类落地:生产、互动、分发

答案先说:多模态 AI 的价值不在“会说话”,而在“能把图像、声音、文字、行为数据串成工作流”。 下面按三类落地拆开讲。

1)节目生产:从“工具”变成“流程上的合作者”

在媒体与内容产业里,AI 最先被接受的是提效:转写、粗剪、字幕、素材检索。但到了春晚级别,提效只是入门,核心是 降低出错率与返工率。

可预期的多模态能力组合包括:

- 语音转写 + 说话人分离:把彩排音频快速结构化,便于审稿与控时。

- 视频语义检索:导演临时要“找一个全景镜头、某位演员某句台词前后的反应镜头”,检索速度决定沟通效率。

- 智能字幕与实时校对:对专有名词、人名地名、品牌词做强约束,减少直播字幕事故。

- 内容安全与合规审校:对文本、画面、音频做多维审核,避免“后知后觉”。

一句话概括:大模型更适合做“把杂乱素材变成可管理资产”的工作,这比写一段文案更值钱。

2)线上互动:把“同一时刻的参与感”做出来

互动体验的关键不是玩法多,而是让用户感觉“我点了就有效”。这需要 低延迟、强一致性、强可解释。

报道里提到字节的 AI 助手“豆包”也会参与,推出多样互动功能。结合行业常见设计,我更关注三点:

- 对话式互动的“节奏控制”:直播是强节奏场景,AI 不能无限聊,必须学会在 3-5 轮内完成任务(领福利、生成祝福、选阵营等)。

- 个性化但不冒犯:用用户画像做祝福语、推荐互动任务时,要避免“过度懂你”造成反感。

- 峰值流量下的体验兜底:宁可降级成模板回复,也不要让用户卡在加载中。

这里有个很现实的产品结论:互动的体验上限由 AI 决定,但体验下限由工程与运营兜底决定。

3)直播分发:云与AI共同决定“稳不稳”

直播稳定性通常被归类为云基础设施能力,但 AI 可以参与更具体的优化:

- 智能码率与画质增强:网络波动下的自适应策略,减少“糊、卡、音画不同步”。

- 异常检测与自动切换:对推流质量、节点抖动、互动接口错误率做实时监控与自动化处置。

- 多端一致性体验:电视端、手机端、车机端(越来越多)都要保持玩法与展示一致。

当 AI 与云一起工作,目标很明确:把不可控的波动压到用户感知之外。

从微信到抖音:春晚为何总能“带增长”?

答案先说:春晚的增长不是“曝光”,而是“在一个统一时间窗口里完成大规模新习惯的教育”。

过去多年,微信、支付宝、淘宝、抖音、快手都曾在春晚合作中获得显著增长,这是公开事实。原因并不神秘:

- 国民级时间锚点:除夕夜的集中观看,让转化窗口极其一致。

- 强社交传播链:红包、助力、组队等机制天然裂变。

- 低门槛任务:一个按钮就能完成参与,几乎没有学习成本。

火山引擎的“独家 AI 云合作伙伴”身份,意味着这一次增长逻辑会更偏向“AI 驱动的互动体验”:例如基于多模态生成的个性化祝福、基于对话的任务引导、基于行为预测的玩法分发。

但我也想泼点冷水:春晚带来的不是永久壁垒,而是一次极强的“冷启动加速器”。 之后能否留存,取决于你能不能把春节期间培养的新行为变成日常可用的体验。

把春晚经验迁移到汽车软件:三条最实用的“体验方法论”

答案先说:车机体验要学春晚的不是“热闹”,而是“峰值时刻不掉链子”。 汽车软件与用户体验越来越像一个“移动的内容与服务平台”,典型场景包括:导航与语音、音乐与视频、充电与支付、出行服务、家庭账号共享。

下面三条迁移路径,我认为最值得汽车团队抄作业。

1)把“实时交互”当成一条完整链路设计

春晚互动从不只是一句“点这里领红包”,背后有账号、风控、支付、消息触达、客服兜底。车机也是同理:

- 语音唤醒失败率、意图识别错误率、网络断连重试策略

- 任务完成时间(比如“找充电桩并发起导航”必须在可接受秒级内完成)

建议指标:

P95任务完成时延(而不是平均值)- 语音交互“首轮命中率”

- 降级路径触发率与成功率

2)多模态不是噱头:它解决的是“看不见的理解差”

在车里,用户的输入不只有语言:还有路况、车速、车内噪声、屏幕触控、摄像头(如驾驶员状态)、位置与时间。多模态的正确用法是:

- 在噪声大时降低语音交互复杂度

- 在夜间驾驶时用更短指令与更少视觉干扰

- 在长途场景中自动切换到“省心模式”(少打扰、强确认)

一句话:多模态的价值在于减少误解,而不是增加花活。

3)先把“体验下限”做稳,再谈“体验上限”

春晚的工程思路非常像高阶车机:

- 有主链路,也要有备链路

- 有创新玩法,也要有模板兜底

- 有大模型能力,也要有小模型/规则系统保底

在车里,这意味着:即使大模型暂时不可用,导航、电话、空调这些高频任务也必须可靠完成。用户对车机的容忍度远低于对手机 App。

可被引用的一句话:真正的智能体验,是用户在关键时刻感受不到系统正在“努力”。

常见问题:大型互动为何更需要“内容安全+风控”一体化?

答案先说:互动规模越大,内容安全与风控越不能事后补救,只能前置进系统。

春晚场景里,风险主要来自三类:

- 生成内容风险:用户让 AI 写祝福、做图片、编段子,必须避免违规与敏感。

- 互动作弊风险:刷量、薅羊毛、异常账号集群,会直接破坏活动公平。

- 舆情扩散风险:直播场景传播快,处置窗口短。

媒体与内容产业做 AI,常见的工程做法是“分层治理”:

- 模型层:安全对齐、敏感词与意图识别、多模态过滤

- 策略层:账号信誉分、设备指纹、频控、黑白名单

- 运营层:人工复核通道、实时监控大盘、紧急预案

这套架构同样适用于汽车软件,尤其是车内对话式助手与车主社区:只要有 UGC/生成内容,就必须把治理设计成产品的一部分。

2026年前的一个判断:AI会把“互动”变成默认配置

火山引擎进入春晚的核心生产与互动层,意味着一个趋势正在成形:未来的内容不只是“被观看”,而是默认“可参与、可对话、可二次创作”。媒体行业会先把这套能力跑顺,然后外溢到车机、智能电视、穿戴设备与线下零售。

如果你在做汽车软件与用户体验,我的建议很直接:别把春晚当成娱乐新闻看。把它当成一次“全国同时在线的交互产品发布会”。你会看到——当技术、内容与运营真正拧在一起时,AI 能把体验做得又大又稳。

接下来一年,你更想在车里看到哪一种“春晚式互动”被复用:对话式服务、个性化内容,还是更可靠的系统兜底?