抖音成2026春晚竖屏独家直播伙伴,背后是AI驱动的多信号编排与本地化交付。本文拆解其方法论,并映射到车载软件与座舱UX。

抖音竖屏独家直播春晚:AI如何重塑内容分发与车载体验

2026-02-02,抖音与中国传媒集团(CMG)联合宣布:抖音成为2026年央视春晚“竖屏直播”独家合作伙伴。这不是“换个屏幕比例”这么简单。竖屏意味着新的观看姿势、新的注意力结构,也意味着平台要用更精细的技术把“内容、场景、交互”重新装配一遍。

我一直觉得,大多数人对用户体验的理解停留在“界面好不好看”。现实更硬核:体验的差距往往来自分发策略、内容形态、实时编排能力,以及背后那套AI驱动的数据闭环。抖音把春晚这样的大型国民级内容做成竖屏独家入口,本质上是在验证一件事:当用户的观看场景更碎片化、更移动化,平台能否用AI把内容交付做得更“贴身”。

这对我们“人工智能在媒体与内容产业”系列的意义很直接:推荐、用户画像、内容审核已经是基础设施;真正拉开差距的,是AI如何把不同形态的内容,按不同人、不同设备、不同场景,实时拼装成更合适的体验。更有意思的是,这套逻辑正在“外溢”到另一个更敏感的终端——汽车座舱。

竖屏独家直播背后:不是比例变化,是交付体系变化

结论先说:**竖屏直播把“内容分发”从单一信号输出,推向了多路信号的场景化编排。**抖音在公告中提到的“多机位并行直播技术”,以及同一直播流里呈现多路画面,说明平台把春晚当作一个可组合的“信号池”,而不是一条固定节目流。

这套变化至少包含三层:

1)多路并行流:从“看同一个”到“看自己想看的”

传统直播的默认值是“一条主信号”。但竖屏端用户更容易分心,也更在意“我现在想看谁”。多机位并行后,系统可以把不同机位、不同焦点(主舞台/特写/观众席/后台)当作可选项,形成“同一时刻多视角”。

如果再进一步结合AI能力,平台通常会做三件事:

- 自动镜头选择:用计算机视觉识别舞台主体、表情、动作密度,决定哪个机位更“值得上屏”。

- 实时热度编排:根据弹幕/评论/停留时长,动态提升某些机位的曝光。

- 个性化默认机位:对“爱看唱歌”“爱看相声”“只看某明星”的人,默认把合适的视角推到最前。

一句话概括:直播开始像信息流一样被“推荐系统化”。

2)多种观看选项:横屏、竖屏、无障碍与幕后

公告提到抖音将提供:

- 竖屏观看体验

- 同步横屏直播

- 无障碍友好信号

- 幕后内容

这在产品层面是一种“分层交付”。同一IP内容被拆成不同版本,分别适配不同人群与场景。

在内容产业里,这类“多版本交付”越来越常见:对平台而言,AI要解决的问题不是“能不能播”,而是能不能在同一时刻,把不同版本准确送到不同用户手里,并且让用户几乎不用设置。

3)竖屏天然更适合“互动闭环”

竖屏不是为了更大画面,而是为了把“观看”和“互动”放在同一视线轨道上:评论、点赞、礼物、话题入口、同款滤镜、二创模板……这些都决定了内容的扩散效率。

春晚这种全民内容,一旦转为竖屏主入口,意味着平台对社交传播链路有了更强掌控:

- 互动数据回流更快,推荐系统更快收敛

- 热点切片更容易生成并传播

- 话题与挑战赛能把“观看”变成“参与”

这就是内容平台最在意的:从曝光到转化(互动/关注/留资/购买)的路径更短。

抖音的“本地化交付”逻辑:内容行业的AI方法论

结论先说:**本地化不是翻译,而是把同一内容按人群习惯重新组织。**抖音之所以能拿下竖屏独家,很大原因在于它擅长把内容做成“更适合手机用户的形态”。

在“人工智能在媒体与内容产业”的框架里,这种能力往往来自三套AI系统的协同:

1)用户画像:不只是“年龄性别”,而是“观看意图”

对春晚来说,“谁会看”不是问题,“怎么让他持续看”才是问题。用户画像会更关注:

- 偏好类型:歌舞/语言类/魔术/传统文化

- 观看节奏:愿意长时间沉浸,还是只看热点片段

- 互动习惯:只看不评,还是边看边刷评论

画像越精细,越能决定竖屏端的默认信息密度、机位优先级与互动入口位置。

2)推荐与实时分发:直播也要“千人千面”的边界控制

“千人千面”在直播里要格外克制:春晚是公共叙事,不能把节目顺序打散;但在机位选择、幕后内容插入、精彩回放、二创引导这些层面,可以做个性化。

我更认可的做法是:主叙事一致 + 体验层差异化。这也是大型活动做个性化的安全边界。

3)内容审核与安全:大型直播的底座

春晚相关内容的UGC(评论、二创、直播切片)会在短时间内爆发式增长。AI内容审核需要覆盖:

- 文本:评论与弹幕的敏感信息、谣言、引战

- 图像/视频:二创素材中的不当元素

- 账号与行为:异常刷屏、诱导链接、诈骗话术

越是“国民级IP+实时互动”,越考验审核的准确率、误杀率与响应时延。

从电视到座舱:为什么这件事对汽车软件与UX很关键

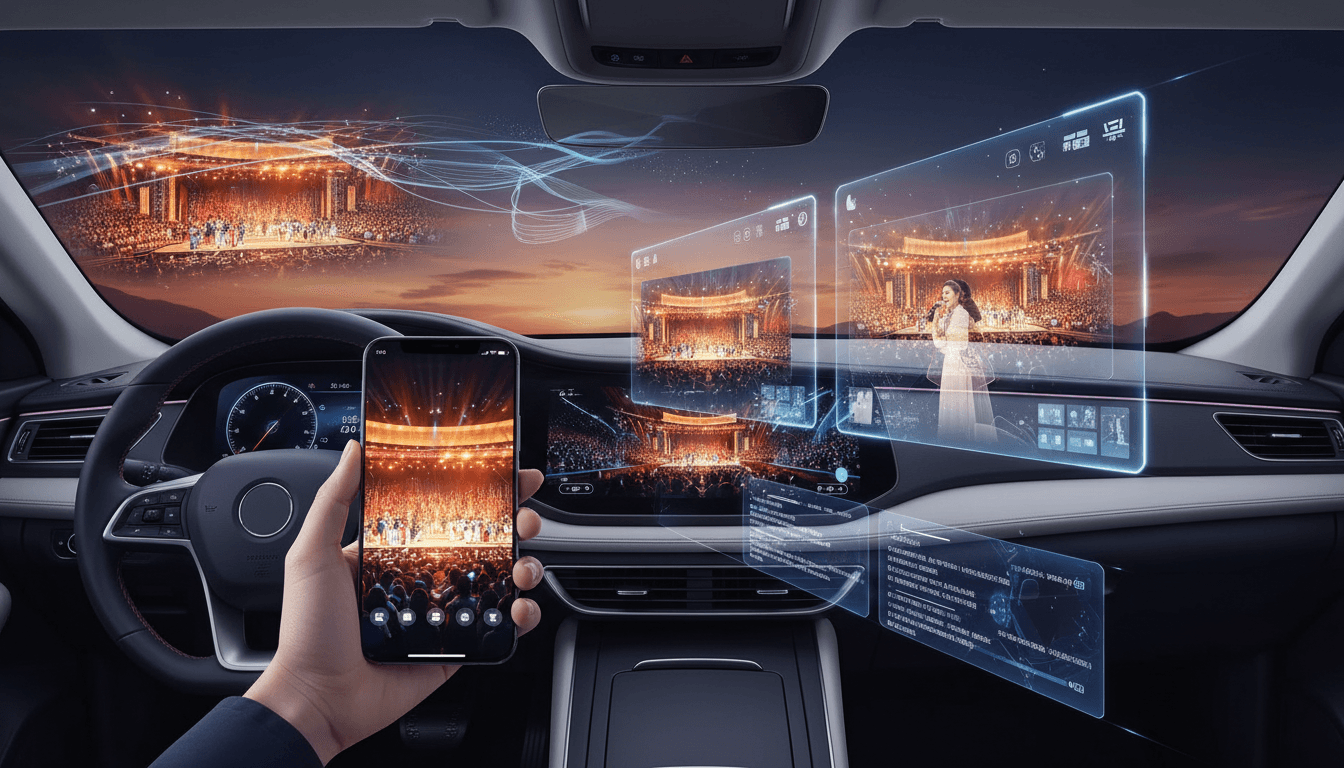

结论先说:竖屏春晚的核心启发是“同一内容,在不同终端上必须被重新编排”,而汽车座舱正是下一个需要“编排能力”的终端。

很多车企做座舱体验时容易走偏:堆应用、堆屏幕、堆语音功能。但用户真正需要的是——在驾驶/乘坐/停车/充电的不同状态下,系统能否自动把“信息与内容”放到合适的位置、用合适的方式呈现。

把抖音的这套方法映射到汽车软件与用户体验(UX),可以得到三条很实用的产品原则:

1)“多路信号”=“多模态交互”

抖音用多机位并行让用户选择视角;座舱里,多模态则对应:

- 语音(短指令/连续对话)

- 触控(停靠时更适合)

- 方向盘按键(驾驶中更安全)

- HUD/仪表提示(关键信息优先)

AI的价值在于:根据车速、路况、驾驶负荷自动切换交互策略,而不是让用户在设置里“自己学会”。

2)“竖屏优先”=“场景优先”

竖屏并非更高级,而是更匹配手机场景;同理,座舱体验也应该“场景优先”。举个很具体的例子:

- 通勤驾驶:导航与安全提示优先,娱乐信息降噪

- 等人/短暂停车:短内容、快进度条、可随时中断

- 充电/休息:长视频、沉浸音频、分屏效率

当AI能识别这些场景并自动编排UI,用户才会觉得“懂我”。

3)“生态合作”=“内容与服务的座舱化交付”

抖音与CMG合作,体现的是平台能力与内容IP的整合。汽车领域同样需要生态合作,但要避免“简单搬运手机应用”。

更好的路线是:

- 把内容做成驾驶友好的信息结构(短摘要、稍后看、语音播报)

- 把交互做成低打扰(少弹窗、少复杂操作)

- 把推荐做成可控的个性化(可解释、可一键关闭某类内容)

一句很“产品经理”的话:不是把内容装进车里,而是把内容改造成车能用的形态。

可复用的落地清单:内容平台与车企都能用

结论先说:如果你在做内容分发、车载座舱、或品牌活动的数字化触达,最该先补的是“编排能力”,而不是再加一个入口。

这里给一份我会拿去做评审的清单:

- 定义可变与不可变:哪些必须一致(主节目流/核心叙事),哪些允许个性化(机位/幕后/回放/互动入口)。

- 把体验拆成三层:内容层(看什么)、交互层(怎么操作)、安全层(什么不能出现)。

- 实时指标要“可用”:不仅看在线人数,还要看切换机位率、停留时长、互动转化、误杀率与申诉率。

- 给用户可控权:个性化再聪明,也要提供“简单明确”的关闭/减少同类内容选项。

- 把无障碍当主线:无障碍信号不是“公益附加”,而是体验成熟度的标志,也能倒逼产品更清晰。

一条可以直接引用的判断标准:真正好的AI体验,是让用户少做选择,但永远保留选择权。

春晚竖屏之后:AI驱动体验竞争会更像“操作系统之争”

抖音拿下2026春晚竖屏独家合作,表面是内容合作,底层是对“移动优先+个性化编排”的一次大规模验证。对内容产业来说,这会推动更多大型IP把交付做成多版本、多信号、多互动的组合;对汽车行业来说,这像是提前演示了未来座舱的方向:同一套服务,要能按场景自动重组,并且始终安全、可控、低打扰。

如果你正在规划2026年的内容策略或车载体验路线,我建议把关注点从“有没有AI功能”转向“AI能不能把体验编排得更合适”。前者容易做成演示,后者才能做成习惯。

接下来值得持续观察的一点是:当“竖屏+多机位+幕后”成为大型直播标配,平台会不会进一步把实时生成的切片、摘要与二创模板做成标准化生产线?而当这套生产线进入车载场景,内容与服务的边界又会被推到哪里?