Seedance 2.0强调“与人类反馈深度对齐”,Tesla强调“软件优先、系统闭环”。一文讲透两种AI战略差异,并给内容企业可落地清单。

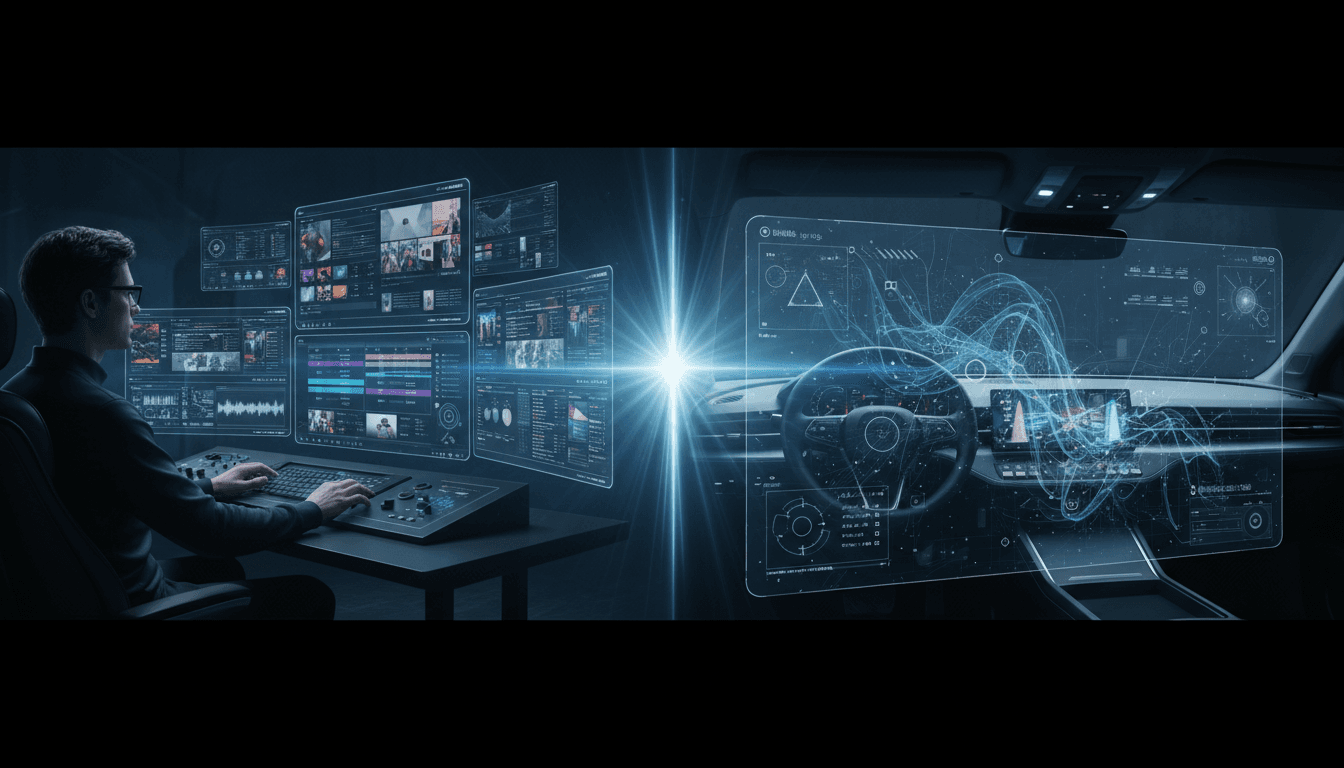

从Seedance 2.0到特斯拉:两条AI路线的核心差异

字节跳动在2026-02-12发布Seedance 2.0时,最值得被记录的一句话不是“更强”,而是“还远不完美”。这句话听起来保守,实际上很“硬核”:它意味着团队把大模型当成长期工程,而不是一次性产品发布。

同一天,你很难不想到另一家把“长期工程”刻进DNA的公司——Tesla。它的AI叙事并不围绕“模型多惊艳”,而是围绕“系统能否持续升级、能否在真实世界闭环”。一个在内容生产里追求“与人类反馈深度对齐”,一个在汽车里追求“软件优先、AI嵌入整车”。两条路看似不同赛道,底层逻辑却能互相照见。

作为《人工智能在媒体与内容产业》系列的一篇,我想用Seedance 2.0这次“坦诚的发布”,对照Tesla的“软件化造车”,把一个常被忽略的问题讲透:AI战略的差异,往往不在模型参数,而在数据闭环、交付形态与组织机制。

Seedance 2.0释放的信号:把“对齐”当成产品能力

结论先说:Seedance 2.0的重点不只是视频生成质量,而是字节跳动明确把“大模型与人类反馈的深度对齐”放在持续迭代的核心位置。

在内容产业里,模型“能生成”只是门槛;真正决定能否规模化落地的是:

- 稳定性:同一提示词在不同时间、不同素材条件下的输出波动有多大?

- 可控性:创作者能否通过少量约束(风格、镜头语言、节奏)得到可预期结果?

- 可解释的质量标准:什么叫“好片段”?什么叫“可用镜头”?能不能被标注、被度量、被反馈?

字节跳动的表态“仍有诸多瑕疵”,其实是在承认生成式视频不可避免的三类现实问题:

- 物理与时序一致性(人物手指、口型、光影连续性)仍然是硬骨头;

- 审美一致性(风格漂移、镜头语言失控)影响生产效率;

- 创作意图对齐(用户说A,模型做出B的“自作主张”)是体验杀手。

为什么“人类反馈”在视频生成里更值钱?

一句话概括:视频的“可用性”是强主观的,靠纯自动指标很难收敛。

文本还能用困惑度、事实一致性等指标凑合衡量;视频要兼顾叙事、节奏、构图、镜头衔接、情绪表达,评价更像“编辑台上的判断”。所以“人类反馈”不仅是对错打分,而是把创作者的隐性经验变成模型可学习的信号。

在内容工业化场景里,反馈常见会走向三层:

- 显式反馈:赞/踩、选择A/B版本、可用/不可用标记

- 编辑行为反馈:用户在哪一帧剪掉、在哪里加转场、如何调色与调速

- 业务结果反馈:完播率、互动率、转化率、投放ROI(更接近“内容是否有效”)

Seedance 2.0强调“深度对齐”,我更倾向理解为:字节跳动希望把反馈从“表层打分”推进到“编辑行为与业务效果”的更深层信号里。

Tesla的软件优先:把AI做成系统,而不是功能

先给结论:Tesla的AI路线,本质是“把模型装进系统闭环”。模型强不强当然重要,但更重要的是:车、传感器、算力、软件更新、数据回传与验证,能否构成稳定的飞轮。

在汽车领域,AI不是一个独立App,而是一组“随时要背锅”的系统能力:

- 识别错误会带来安全风险

- 控制策略不稳会带来事故与监管压力

- 更新节奏与质量管理必须像工业品一样严谨

这决定了Tesla的策略天然更偏向:

- 系统级集成:AI深度嵌入整车软硬件栈(传感器→感知→规划→控制→HMI)

- 持续交付:通过OTA把“改进”交付到车辆端,形成真实世界验证

- 数据闭环:车辆运行数据回流,驱动训练与回归测试

“对齐”在Tesla这里长什么样?

内容模型的对齐,多半是“符合人的偏好”;而自动驾驶/座舱智能的对齐,更多是“符合人的预期与安全边界”。

一个很实用的对照表:

- Seedance式对齐:更像“跟剪辑师对齐审美与意图”

- Tesla式对齐:更像“跟道路规则、风险边界、人类驾驶预期对齐”

两者都依赖反馈,但反馈形态完全不同:

- 内容:反馈可以快速、低成本、大规模;容错更高

- 汽车:反馈慢、成本高、需要严格验证;容错极低

这也解释了为什么Tesla的AI战略常被称为“软件优先”:它必须先把工程体系跑通,模型能力才有意义。

两种AI战略的核心差异:闭环位置与商业化路径

把话说直:**中国不少AI公司更擅长把“模型体验”做到极致;Tesla更擅长把“模型能力”固化为系统交付。**这不是谁更高级,而是商业目标与产品形态决定的。

差异一:数据闭环在哪里发生?

- Seedance/内容大模型:闭环发生在“创作平台与用户行为”上——生成→编辑→发布→分发→反馈→再生成

- Tesla/车载AI:闭环发生在“真实世界运行”上——感知→决策→执行→回传→训练→验证→再部署

前者优势是迭代快、反馈多;后者优势是壁垒深、系统锁定强。

差异二:迭代节奏与质量门槛

- 内容工具追求“效率提升”和“更稳定的可用输出”,允许小瑕疵存在(尤其在短视频与营销素材场景)

- 车载系统追求“可验证的稳定性”,小瑕疵可能就是不可接受的系统风险

所以你会看到:Seedance 2.0敢公开说“不完美”,用户也愿意一起“边用边改”;而车载AI通常更谨慎,发布节奏更受制于验证与监管。

差异三:商业化方式——卖工具 vs 卖系统

内容大模型更像:

- 卖“生产力”:按量计费、订阅、企业版、素材市场分成

- 价值体现更直接:节省人力、提升产出、缩短交付周期

车载AI更像:

- 卖“系统能力”:车价、软件包、服务订阅、生态绑定

- 价值体现更长期:安全、体验、可持续升级带来的复购与品牌溢价

一句可被引用的判断:内容AI赢在“快”,车载AI赢在“深”。

给内容企业的可落地清单:把“对齐”做成增长引擎

如果你在媒体、内容平台、营销制作公司或MCN做AI落地,我建议把Seedance 2.0的“深度对齐”理解成一套方法,而不是一句口号。

1)先定义“可用输出”的工程标准

别一上来就追求“惊艳”。先把可用标准写清楚,团队才知道该优化什么。

- 画面:清晰度、抖动、畸变、人物一致性

- 叙事:镜头是否能拼成完整故事、节奏是否可控

- 品牌:是否符合品牌色、风格基调、禁用元素

把这些变成质检表,再把质检结果变成模型训练/微调信号。

2)把编辑行为当作高质量反馈

很多团队只收“满意/不满意”,这太粗。更有效的是记录编辑动作:

- 用户在哪些时间点剪掉/替换

- 最常用的镜头长度分布

- 常用的转场与字幕节奏

这些行为是“隐性审美”的外显化,对视频生成模型的对齐尤其关键。

3)建立A/B与回归测试,像软件团队一样管内容AI

我见过最常见的翻车:模型更新后,某类风格突然生成崩了,但没人第一时间发现。

建议最小化落地:

- 维护一套固定的提示词与素材集(10-30个核心场景)

- 每次更新跑一遍对比(清晰度、稳定性、风格一致性)

- 指定“红线指标”(如人物脸部失真率超过某阈值则回滚)

这其实是在向Tesla式的软件工程学习:更新不是发版,而是可控的持续交付。

4)让业务指标进入对齐:把“好看”变成“有效”

对营销内容来说,最终目标不是生成好看视频,而是带来效果。

把模型优化和业务指标绑在一起:

- 对电商:点击率、加购率、转化率

- 对内容平台:完播率、互动率、关注转化

- 对品牌广告:记忆度调研、到站率、线索成本

当反馈信号从“审美”扩展到“效果”,你的AI才真正接近可规模化的生产系统。

下一步怎么走:两条路线会合流,但赢家是“闭环更稳”的人

Seedance 2.0的价值,不只在于字节跳动又发布了一个视频创作模型,而在于它公开承认:**生成式AI真正的护城河,是持续对齐与持续交付的能力。**这点和Tesla并不矛盾,甚至方向一致。

我的判断是,未来12-24个月内容产业的竞争焦点会从“谁的模型更会生成”转向“谁的生产链路更稳”:从提示词、素材管理、生成、编辑、审校、分发到效果回收,能否形成可重复的闭环。

如果你正在评估内容大模型、搭建AI内容工作流,或者想把“AI创作”变成可衡量的增长能力,我建议你先回答一个问题:你的反馈数据,是否能真正回到模型与流程里,让下一次交付更快、更稳、更可控?