双足机器人“防摔倒”背后的安全工程,正在映射自动驾驶AI的两条路线:Tesla端到端与中国车企多传感器冗余。

从防摔倒的双足机器人,看自动驾驶AI两条安全路线

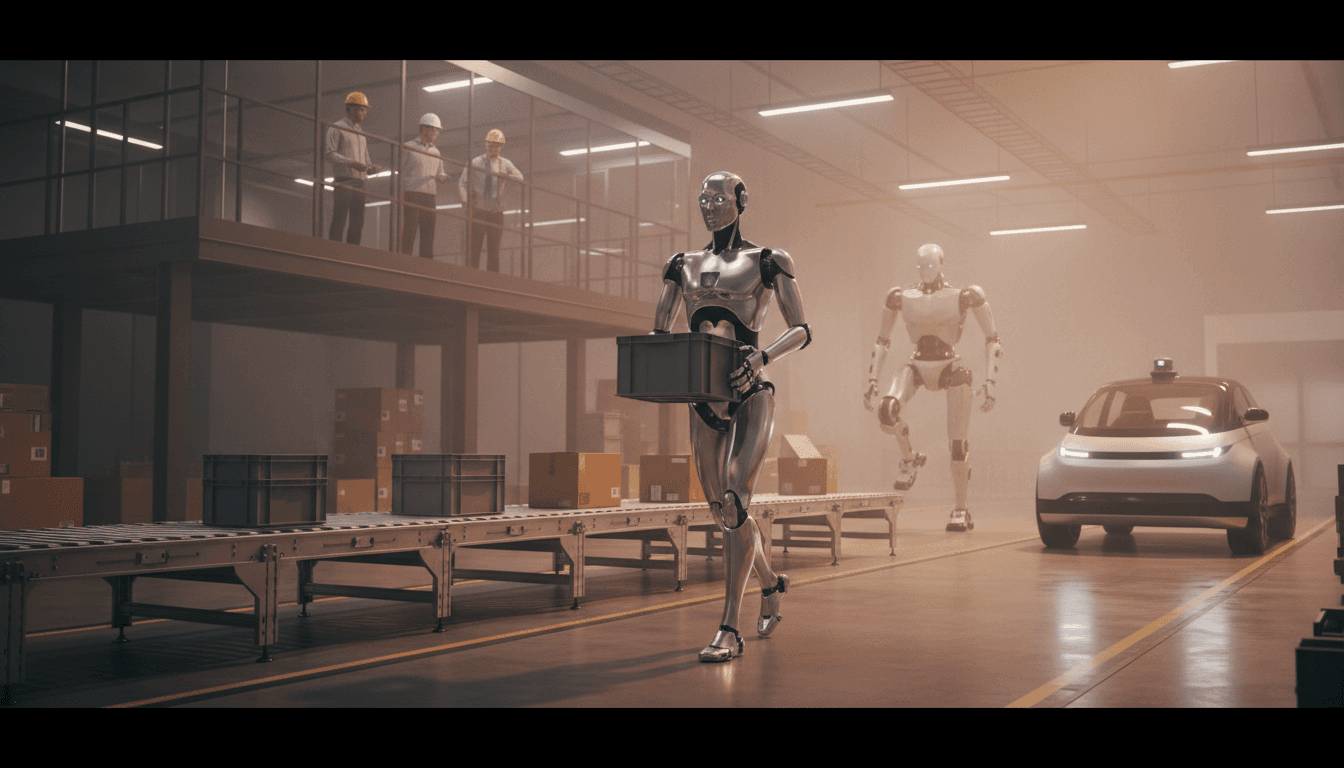

2026 年 1 月的 CES 刚把“人形机器人热”又推高了一波,而 IEEE Spectrum 的 Video Friday 则给了更硬核的证据:双足机器人开始学会“快摔倒时把自己救回来”,工业场景里的人形搬运也已经跑完两周 POC,甚至四足机器人能去火场协同、去火山口测气体。

我更在意的不是“它们看起来多像人”,而是一个更现实的问题:这些机器人要在真实世界跑起来,靠的不是聪明,而是可验证的安全与可恢复性。这恰好能把话题拉回我们这条系列《人工智能在机器人产业》里反复讨论的主线:当 AI 进入“物理世界”,安全不是功能,是底座。

把镜头从双足机器人切到车:Tesla 的端到端(end-to-end)驾驶模型,和中国车企更偏“多传感器冗余 + 多供应链协作”的路线,本质上都在解决同一道题——在高不确定环境中,系统怎么持续保持可控、可解释、可量产的安全。

机器人“防摔倒”告诉我们:安全=持续控制,而非一次判断

**结论先说:动态系统的安全,不是识别对不对,而是每 10-20 毫秒都能把状态拉回安全域。**双足机器人之所以难,是因为它不是静态稳定(像轮式底盘那样停住就行),它必须持续做闭环控制:姿态、足底接触、重心轨迹、关节扭矩,任何一环抖一下就可能倒。

Video Friday 里最抓人的片段,是那种“眼看要摔”却能靠身体摆动、落脚修正把自己稳住的动作。这类能力背后通常不是一个单点 AI“做对了决定”,而是:

- 高频控制回路:控制周期往往是毫秒级,容错窗口极短

- 状态估计:融合 IMU、编码器、力传感器等,实时估计身体状态

- 故障可恢复设计:滑了一下、踩空一下,系统要能立刻进入“保命模式”

放到自动驾驶就是一句话:车辆安全更多时候不是“看见了什么”,而是“出了意外还能不能兜住”。

POSITRON 这类“可认证安全平台”,对应的是汽车里的功能安全底盘

RSS 提到 Synapticon 的 POSITRON 平台,强调“可认证(certifiable)安全功能”和工业最高标准。人形机器人要进工厂,靠的不只是动作炫,而是能过安全审查、能和人协作。

这对自动驾驶的映射非常直接:

- 机器人领域强调

functional safety(功能安全)与collaborative safety - 汽车领域对应 ISO 26262、SOTIF,以及面向高阶自动驾驶的安全论证

**端到端模型很擅长把感知-规划-控制压缩成一个整体,但它天然更难“逐模块证明安全边界”。**而多模块冗余体系(感知冗余、制动冗余、计算冗余)虽然看起来“笨”,却更容易做工程化安全分解与认证。

从“会走路的 AI”到“会开车的 AI”:端到端与多传感器的分歧点在哪里

结论先说:端到端路线追求规模化学习与统一表征;多传感器路线追求物理冗余与工程可控。两者都能跑,但风险结构完全不同。

Tesla 的端到端:把复杂性压进数据与模型

端到端的优势在于:

- 统一优化目标:减少模块间“接口损失”(感知误差如何传到规划再传到控制)

- 数据驱动泛化:在海量数据上学到长尾场景的“统计规律”

- 迭代速度快:软件更新驱动能力演进,路线更“软件优先”

但代价是:

- 失败模式更难拆解:出了问题,究竟是视觉误判、意图预测偏差,还是控制策略不稳?

- 对数据分布极敏感:训练数据覆盖不到的“角落”,可能触发不可预期行为

- 安全论证更像“整体证明”:工程上更难做传统意义的分层验证

中国车企的多传感器与协作生态:用冗余换确定性

中国市场更常见的组合是摄像头 + 毫米波雷达 +(部分车型)激光雷达,再叠加高精地图/无图方案的不同工程实现。其出发点往往更务实:

- 硬件冗余:雨雾、逆光、遮挡时,不把鸡蛋都放在视觉一个篮子里

- 供应链分工:传感器、域控、算法平台、多家 Tier1/Tier2 协作,形成“模块可替换”

- 更易局部迭代:某个传感器或某段算法有问题,可以定点升级或替换

问题同样存在:

- 系统集成复杂度高,标定、时延、同步、故障诊断都很吃工程能力

- 成本与量产压力大,配置策略容易出现“堆料但体验不稳”的反效果

我对“堆传感器就安全”的说法一直比较警惕。冗余的前提是:你得真的做故障模式分析,并让冗余在关键时刻能接管,而不是只在 PPT 里存在。

机器人产业的三个场景,正在给自动驾驶“打样”

结论先说:工业、极端环境、家庭交互这三类机器人案例,分别对应自动驾驶的“可控场景、边界场景、人与系统信任”三道关。

工业物流 POC:像中国车企的“多方协作集成”

Humanoid 与 Siemens 在工厂做两周“tote-to-conveyor”真实部署,这件事的信号很明确:离开实验室后,真正的难点变成流程耦合与稳定运行。

这与中国车企常见的路径非常像:整车厂、算法公司、传感器厂、地图/定位/控制供应商协作,把系统放进复杂流程里跑。优势是落地快,劣势是系统边界一多,任何一个小环节都可能成为“稳定性短板”。

火山测气体与消防四足:像自动驾驶的长尾与极端工况

ETH Zurich 的四足机器人去埃特纳火山做气体监测,DEEP Robotics 展示四足在消防场景协同——这种任务的共同点是:

- 视野差、地形差、风险高

- 人类不愿意去或去不了

- 系统必须“可退可守”,失败要可控

自动驾驶的长尾场景(施工改道、暴雨积水、突发事故现场)也一样。**你不可能训练到所有情况,但你必须设计“安全退出策略”。**机器人常用的做法是:一旦不确定性超阈值,立即降级到更保守策略;必要时停下、回撤、请求接管。

具身智能与 World Model:像端到端路线的“统一世界表征”

1X 的 NEO 讲的是 physics-grounded video model,把互联网规模视频与真实机器人经验结合,让机器人能对新物体新任务做预测与执行。LimX Dynamics 的 COSA 则试图把高层认知与全身运动控制统一在“Agentic OS”里。

这类趋势和 Tesla 的思路在哲学上是一致的:用统一模型学到“世界如何运作”,再把动作生成端到端地做出来。

但机器人也在提醒我们一个现实:只要进入物理世界,任何“端到端”的雄心都绕不过两件事:

- 物理约束:摩擦、惯性、延迟、传感噪声

- 安全约束:人身安全、设备安全、环境安全

想把自动驾驶做稳,建议用“机器人式安全清单”反推系统设计

**结论先说:别先争论路线,先把“失败时怎么不出事”写清楚。**我自己在评估自动驾驶/机器人方案时,会用类似机器人行业的思路做反推。

1)把安全拆成三层:预防、检测、恢复

- 预防:更好的感知与预测、更保守的策略边界

- 检测:异常检测(传感器失效、模型置信度异常、控制不稳定)

- 恢复:降级策略(减速、靠边、停车)、冗余接管(制动/转向/计算)

端到端路线常强在“预防”,但必须补齐“检测与恢复”的工程化链条;多传感器路线常强在“检测”,但要避免恢复逻辑过于复杂导致新的风险。

2)为“不可解释的智能”准备可解释的护栏

如果核心决策来自大模型或端到端网络,那么护栏最好是可审计、可测试的:

- 速度与加速度上限、最小跟车时距

- 硬约束的碰撞避免与紧急制动触发条件

- 关键状态机:何时允许变道、何时必须退出

这就像人形机器人进入协作工位前,先用可认证平台把“最危险的那部分”锁死。

3)用真实部署指标,而不是 Demo 指标

机器人在工厂跑两周的价值,远大于实验室里 30 秒的炫技视频。自动驾驶同理:

- 接管率(按里程/按时长)只是起点

- 更关键的是接管原因分布、风险事件前兆、系统降级次数

- 以及“极端天气/夜间/拥堵/施工”四类场景的稳定性

2026 的一个判断:两条路线会互相借鉴,但分水岭是“安全工程能力”

我更愿意把端到端与多传感器之争看成“阶段性策略”,而不是信仰选择。机器人行业已经给出一个明确方向:智能可以很黑箱,但安全必须可验证、可演练、可落地。

从防摔倒的双足,到可认证的机器人安全平台,再到工厂 POC、火山任务,这些案例都在讲同一句话:真实世界不会按你的训练分布来。系统要可靠,靠的是“出了意外也不会失控”的能力。

如果你正在评估自动驾驶 AI 方案(不管是偏 Tesla 式端到端,还是偏中国车企式多传感器协作),我建议先问团队三个问题:**你的失效模式有哪些?触发后怎么检测?检测后怎么恢复?**答得越具体,离量产安全就越近。

你更看好哪条路径先跨过“规模化安全”的门槛——端到端把能力学出来,还是冗余体系把边界管住?这可能决定 2026-2028 年自动驾驶产品体验的分化速度。