英特尔服务器在中国据称涨价10%,算力成本重定价。借此对比特斯拉软件优先AI与中国车企多栈并行路径,给出降本增效建议。

英特尔服务器涨价10%:看懂特斯拉与中国车企AI路线差异

2026-02-06 有消息称:英特尔服务器产品在中国市场价格“总体上涨了10%”。这条看似“硬件圈”的快讯,真正刺痛的却是很多正在做 AI 的团队——预算、交付周期、算力规划都会被牵一发动全身。

但更值得讨论的是:当硬件成本波动成为常态,企业的 AI 竞争力到底靠什么?我越来越确信一个判断:软件优先、数据闭环、垂直整合的 AI 战略,会比“堆硬件、买算力”的路线更抗波动。拿自动驾驶与智能座舱来说,特斯拉的路径与多数中国汽车品牌的路径,差异正在被这种“服务器涨价”事件放大。

这篇文章放在《人工智能在半导体与芯片设计》系列里讲,核心目的不是点评一次涨价本身,而是借这根“算力温度计”,看清三个问题:

- 服务器/CPU 价格波动,为什么会直接影响 AI 项目成败?

- 特斯拉的 AI 为什么相对不怕硬件涨价?它到底“省”在哪里?

- 中国车企如果走软硬协同路线,芯片设计、验证、部署应怎么改?

可引用的一句话:当算力变贵,AI 的胜负就不再取决于谁买得多,而取决于谁把数据变成了更有效的训练与部署。

服务器涨价10%意味着什么:算力成本正在重新定价

直接答案:服务器/CPU 涨价会抬升 AI 的“单位能力成本”,让同样的模型效果变得更贵、更慢、更难规模化。 10%听起来不夸张,但落到企业预算里,往往是从“可行”变成“要砍”。

为什么是英特尔服务器涨价,会牵动AI项目?

在中国市场,英特尔服务器生态仍然广泛存在于:

- 企业私有云与混合云(大量

x86传统负载 + AI 推理/训练混部) - 车企的仿真、测试、数据湖与标注平台

- 芯片设计公司在 EDA 流水线上的验证、回归、仿真集群(其中不少仍以 CPU 为主)

即便训练主要依赖 GPU,CPU 依然是数据预处理、特征工程、仿真、编译、调度、存储与网络栈的“底盘”。服务器涨价往往不是单点上升,而会引发:整机、内存、主板、维保、机柜功耗与租赁成本的联动。

10%怎么传导到“模型效果”?

把算力看成生产要素,涨价的后果通常是三选一:

- 训练规模变小:同样预算,训练 token/epoch 减少,模型上限被压缩。

- 训练周期变长:排队、资源不足,迭代速度下降,产品节奏被拖慢。

- 单位推理成本上升:线上推理更贵,导致功能受限(比如更少的场景、更低的分辨率、更弱的多模态能力)。

对车企尤其致命的一点是:智能驾驶不是“训练一次就完事”。它需要持续的数据回流、持续训练、持续仿真回归。算力越贵,闭环越慢;闭环越慢,体验越难稳定提升。

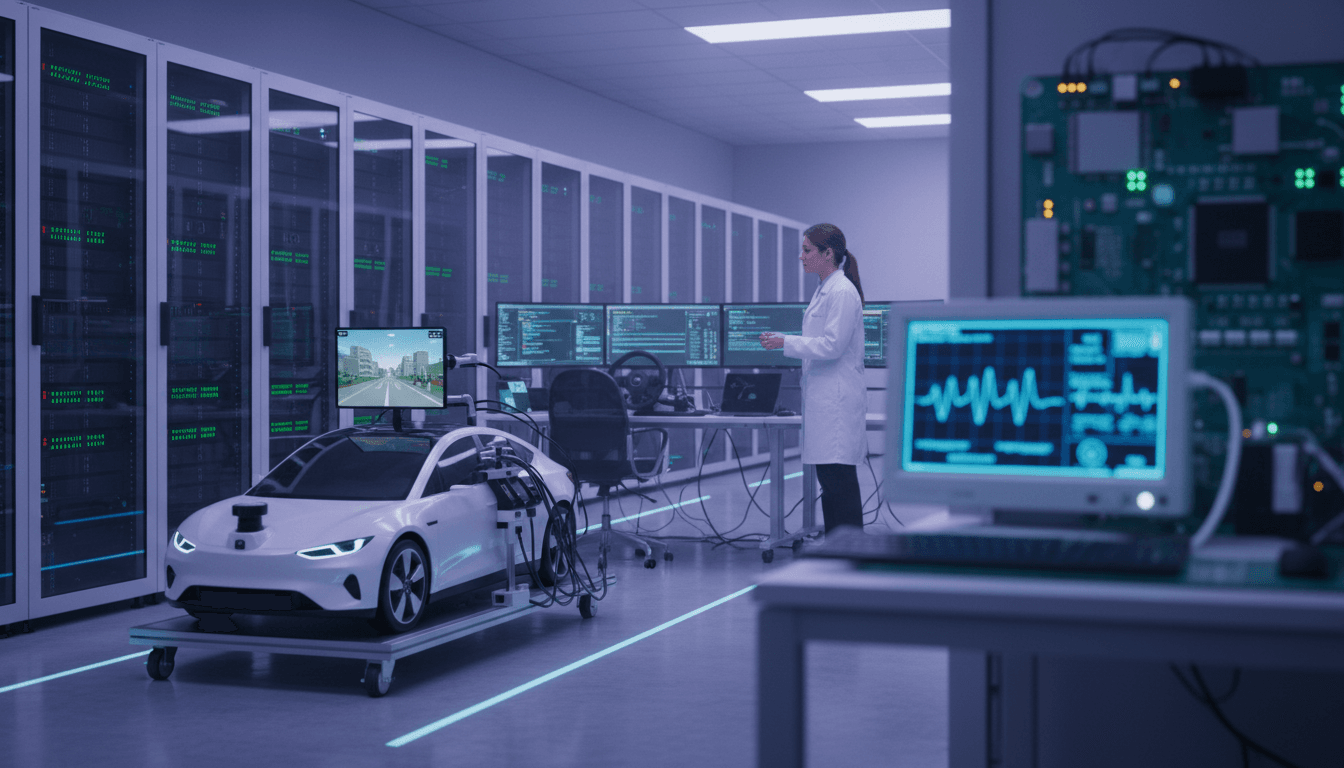

硬件越波动,越能看清:特斯拉是“软件定胜负”,不是“硬件堆出来”

直接答案:特斯拉的 AI 抗硬件波动能力,来自软件栈统一、数据闭环高效率、以及围绕自动驾驶的垂直整合。 它当然也买硬件、建集群,但关键是它把“硬件不确定性”锁在系统边界之外。

特斯拉的三件“反直觉”的事

-

把模型目标与数据采集绑定到产品上

- 特斯拉的车队天然是数据采集网络,数据回流与任务定义强绑定。

- 结果是:它更容易做“有效数据”的筛选与再训练,而不是无差别堆数据、堆算力。

-

软件栈统一,减少“为适配而浪费”的算力

- 自动驾驶、仿真、部署的工具链更一致,减少了多供应商、多平台导致的重复训练、重复验证。

-

用工程效率对冲硬件成本

- 当服务器涨价 10%,一些团队会被迫缩小训练规模。

- 但如果你的数据/训练 pipeline 能把“同等算力的有效产出”提升 20%,涨价就变成可消化的噪声。

我见过不少团队的问题并不在“买不到算力”,而在“算力买来没产出”:数据脏、标注体系不统一、仿真与真实世界不闭环、模型版本管理混乱。硬件一涨价,这些低效会被立刻放大。

这与“硬件公司”的逻辑差在哪里?

英特尔代表的是典型硬件供给链:性能、供货、价格波动会直接影响下游。它的优势在通用性与生态,但代价是下游企业更容易陷入“配置选型—采购—适配—迁移”的循环。

特斯拉更像“用软件定义系统边界”:

- 上层:明确的产品目标(驾驶体验)

- 中层:统一的训练/评测/回归体系

- 底层:硬件变化尽量不改变上层逻辑

这就是软件优先战略的本质:硬件会变,但系统效率要可控。

中国汽车品牌的AI路线:更容易被算力价格“卡脖子”的三个原因

直接答案:多数中国车企的 AI 更像“供应链拼装 + 多栈并行”,导致训练与部署存在结构性重复成本,一旦硬件涨价就更脆弱。 这不是能力问题,而是组织与架构选择的后果。

原因1:多供应商、多平台并行,训练与验证重复

现实里,很多车企同时存在:

- 不同车型、不同域控平台

- 不同算法团队使用不同训练框架与数据标准

- 智驾与座舱、泊车与高速 NOA 的评测指标不统一

当服务器/CPU 或整机成本上涨,最先被砍的往往不是“核心训练”,而是那些看起来“可延后”的仿真回归、数据治理、工具链重构。但这些恰恰决定长期效率。

原因2:数据闭环不够“产品化”

特斯拉把数据回流当产品的一部分,而不少团队把数据当项目资产:

- 数据回流链路长,跨部门协作成本高

- 数据筛选依赖人工经验,自动化程度不足

- 标注与再训练的 SLA 不稳定

硬件涨价后,企业会更倾向于“减少训练次数”,而不是“提升训练质量”。这样短期省钱,长期会掉队。

原因3:算力规划更像“采购计划”,而不是“研发系统”

服务器涨价 10% 的消息能引发焦虑,本质是很多企业的算力体系缺少弹性:

- 资源调度不精细,CPU/GPU/存储利用率偏低

- 同一份数据被多次搬运、重复预处理

- 缺少成本度量(比如每提升 1% 指标需要多少 GPU 小时/CPU 小时)

当你算不清“每一点模型提升的边际成本”,就只能被动接受涨价带来的预算压力。

面向“AI在半导体与芯片设计”的落地建议:把硬件波动变成可管理变量

直接答案:应对硬件价格上涨,最有效的不是临时砍预算,而是提升训练与验证效率,并把芯片/系统设计纳入同一套指标体系。 这正是《人工智能在半导体与芯片设计》系列想强调的:AI 不只需要更强芯片,也需要更聪明的工程系统。

建议1:建立“算力效率”指标,像管良率一样管训练产出

给车企/芯片团队一个可执行的指标框架:

- 每 1TB 新增有效数据带来的指标提升(而非总数据量)

- 每次训练的单位成本:GPU 小时 + CPU 小时 + 存储与网络

- 训练—仿真—路测回归周期(天/周)

- 线上推理成本:每公里、每小时、每帧的算力消耗

这些指标会倒逼数据治理、模型压缩、推理加速与编译优化,最终让“服务器涨价”不再是致命变量。

建议2:用AI加速芯片设计验证,但先把验证工作流标准化

在芯片设计与验证环节,AI 可以做的事很多:

- 用机器学习预测回归测试优先级,减少无效回归

- 用 LLM/Agent 辅助生成 testbench、约束与覆盖率分析脚本

- 基于历史 bug 数据做缺陷定位与根因聚类

但前提是:验证数据可追溯、测试用例可复用、覆盖率指标统一。否则你会训练出“只对某个项目有用”的工具,迁移成本极高,反而更依赖不断扩容的服务器。

建议3:推理侧优先做“软件优化”,再谈换硬件

硬件涨价时期,推理优化的优先级会明显上升。顺序我建议是:

- 模型结构与蒸馏:先减少冗余计算

- 量化与编译优化:

INT8/FP8、算子融合、内存访问优化 - 调度与缓存:减少数据搬运

- 再评估硬件平台:最后才是上新卡、换新机

原因很简单:软件优化带来的收益可跨硬件平台复用,而硬件更换往往带来新的适配成本。

常见追问:服务器涨价,会不会让车企AI集体“降速”?

直接答案:会分化,而不是集体降速。 具备数据闭环与工程效率的团队会继续迭代;依赖外采方案、缺乏统一工具链的团队会更难维持高频训练。

我更关注的不是“今年预算多 10% 还是少 10%”,而是企业有没有能力做到:同样预算下,模型迭代速度更快、上线更稳、回归更可控。这才是长期壁垒。

服务器涨价只是一个提醒:AI 竞争越来越像制造业——你得管过程、管良率、管周转,而不是只看采购规模。

接下来一年,如果你在做智能驾驶、座舱大模型、或芯片验证自动化,我建议把一件事提到战略层面:把算力当成本中心管理,把数据与软件当利润中心运营。

你所在的团队,是更接近特斯拉这种“软件定边界”,还是更接近“硬件堆资源”?这个答案,会决定你面对下一次价格波动时的姿势。