摩尔线程实现GLM-5 Day-0适配,揭示国产GPU生态正走向工程可用。本文拆解FP8、框架适配与车载体验交付的闭环。

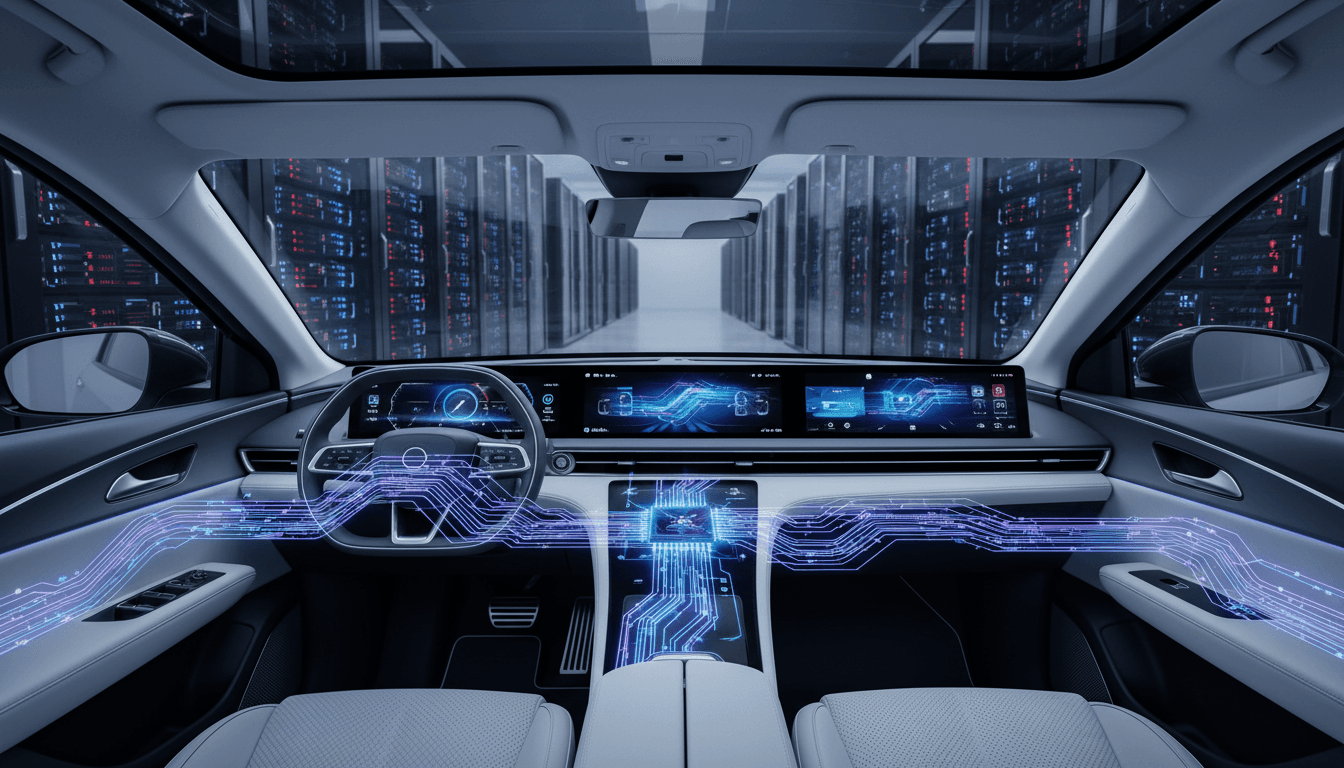

国产GPU Day-0适配大模型:从算力到车载体验的闭环

2026-02-12 的一条行业新闻很“硬核”:智谱发布新一代大模型 GLM-5 的同一天,摩尔线程宣布其旗舰训练/推理 GPU MTT S5000 已完成全流程适配与验证,实现 Day-0 兼容。这类消息乍看离普通用户很远,但我更愿意把它当成一个信号——中国 AI 生态正在从“模型能跑”走向“模型随发布就能稳定跑”。

这件事之所以值得汽车软件与用户体验(UX)圈的人关注,是因为智能汽车的竞争越来越像软件产品:迭代快、体验细、问题容忍度低。你在座舱里用到的语音助手、驾驶建议、导航理解、多模态交互,背后都要靠算力、框架、算子、精度与工程链路的共同交付。Day-0 适配本质上就是一种“以用户为中心的工程纪律”:把兼容性、性能与稳定性提前做到发布当天,而不是发布后再补洞。

Day-0 兼容到底解决什么问题?答案是“把不确定性从上线当天拿走”

**Day-0 兼容的价值,核心在于降低大模型落地的不确定性成本。**对企业来说,大模型上线最贵的往往不是训练本身,而是上线前后围绕性能回退、显存爆掉、精度漂移、算子缺失、框架适配的反复拉扯。Day-0 的目标就是:模型一发布,推理链路即可跑通并达到可用性能。

结合此次信息,摩尔线程是在 SGLang 推理框架上完成了 GLM-5 的端到端推理流程打通,并且借助其 MUSA 架构较高的算子覆盖与生态兼容性,把“从模型到部署”的那串多米诺骨牌尽量一次性扶正。

把这件事翻译成汽车软件语言:

- 你希望 OTA 新功能上线当晚,座舱语音别突然变“耳背”;

- 你希望新增的泊车场景别让 GPU 占用飙升导致 UI 掉帧;

- 你希望同一套交互在不同车型、不同芯片平台上表现一致。

**Day-0 不是速度崇拜,而是把工程风险前移。**这和特斯拉式的软件节奏很像:不是等用户抱怨才修,而是尽量把问题消灭在发布之前。

GLM-5 的“Agentic Engineering”为什么会影响汽车软件路线?答案是“从对话走向任务交付”

新闻里提到 GLM-5 相比上一代整体性能提升约 20%,并强调其关键突破是 Agentic Engineering 能力:不仅能写代码,还能处理复杂系统工程与长链路代理任务,支持从需求到应用的端到端开发。

**这类能力的外溢效应,会直接推动车载 AI 从“问答助手”变成“任务代理”。**在座舱里,用户真正想要的往往不是一段漂亮回复,而是“把事办了”:

- 我说“周五下班去接孩子再去超市”,系统需要自己拆解路径、时间、提醒、停车偏好,甚至和车机应用联动;

- 我说“把空调调到不容易犯困的状态”,系统需要结合车内传感器与个人偏好做策略;

- 我说“给我一个不会晕车的路线”,系统需要理解我对加减速、转弯频率的偏好并做路径优化。

这些都属于长链路、多步骤、跨应用的代理任务。它们对底层算力和推理稳定性提出更苛刻要求:不是跑一次就行,而是要持续跑、随时跑、在资源受限环境里跑。

也正因为如此,GLM-5 这类模型的发布节奏越快、能力越强,对“能否快速适配到国产 GPU 并保持稳定性能”的要求越高。否则上层体验只能停留在 demo。

MTT S5000 的参数意味着什么?答案是“国产算力在向工程可用逼近”

从公开信息看,MTT S5000 面向大模型训练、推理与高性能计算:

- 单卡最高约 1000 TFLOPS AI 算力

- 80GB 显存

- 1.6TB/s 显存带宽

- 784GB/s 卡间带宽

- 支持从 FP8 到 FP64 的全精度计算

如果只看参数,很容易陷入“堆料对比”。但这次新闻更值得读的是另一句话:摩尔线程“解锁了 MTT S5000 的原生 FP8 加速,在保持模型精度的同时显著降低显存占用”。

**FP8 对大模型部署的意义非常直接:更少显存、更高吞吐、更低成本。**对于企业私有化部署、边缘推理集群、以及成本敏感的行业场景(包括车厂供应链),显存与吞吐往往比峰值算力更关键。

我见过不少团队“模型选得很好”,最后却卡在两件事:

- 显存不够导致不得不降 batch、降并发、或者拆模型;

- 精度压得太猛导致体验掉链子(比如意图识别误判、工具调用失败)。

因此,**“原生 FP8 + 端到端推理链路跑通”**这种组合,才更像工程团队真正想要的答案。

从“国产 GPU 适配模型”到“车载体验交付”,中间缺的不是想象力,而是流程

**智能汽车的用户体验,很大一部分是被工程流程塑形的。**你可以把“从 GPU 到座舱体验”理解为一条供应链:算力平台 → 推理框架 → 模型适配/量化 → 中间件与工具调用 → 交互与 UI → 线上监控与 OTA。

Day-0 适配的启示是:**把兼容性当产品能力,而不是发布后的运维工作。**对应到汽车软件,我建议用“三层验收”来对齐不同团队的目标:

1)算力层:用“可复制的性能基线”替代口头承诺

- 固定模型版本与推理框架版本(如 SGLang / 其他推理引擎)

- 明确指标:每秒 token、P99 延迟、显存峰值、并发数

- 记录精度回归:量化/算子替换前后关键任务成功率

2)中间件层:把工具调用当作“可靠性工程”

Agent 能力落地时,失败往往不是模型不会说,而是工具链不稳:超时、权限、状态不同步、幂等性缺失。建议把以下内容写进验收:

- 工具调用超时策略与重试策略

- 失败降级:从“自动完成”降为“半自动确认”

- 全链路可观测:请求ID、调用链路、关键参数脱敏记录

3)体验层:用任务完成率替代“满意度口号”

车载场景特别适合用“任务完成率”做 UX 的硬指标。例如:

- “一口气完成路线规划+充电建议+到达提醒”的成功率

- 语音多轮纠错率(用户重复同一句的比例)

- UI 卡顿与掉帧在模型调用时的相关性

一句话原则:模型能力上来之后,体验差通常是因为工程链路没跟上。

“特斯拉式迭代”可以从 Day-0 学什么?答案是“把发布当天当作用户第一天”

很多团队把“发布”当作终点,而特斯拉更像把发布当作起点:上线后通过数据闭环快速修正。但前提是上线当天不能炸。

Day-0 兼容提供了一个更可执行的对照:

- 同步节奏:模型发布与硬件/框架适配同步推进,而不是串行排队。

- 标准化接口:靠算子覆盖、框架兼容、精度策略,把差异收敛在平台层。

- 性能-体验对齐:把 FP8、显存、吞吐等底层指标,映射到用户可感知的延迟与稳定性。

对于正在做智能座舱、辅助驾驶提示、车内多模态交互的团队,这意味着一个更现实的路线:

- 上层体验不必等待“完美硬件”;

- 底层生态也不能只追峰值参数;

- 真正决定交付速度的,是“模型—框架—GPU—工具链”的协同程度。

读完你该做什么?三个可落地的下一步

如果你在车企、一级供应商或车载软件团队里推进大模型应用,我建议把这条新闻当成一个检查清单的触发器:

- 为核心模型建立 Day-0 目标:每次模型升级,规定“上线当天必须跑通的用例集合”(至少覆盖高频座舱任务)。

- 把 FP8/量化策略产品化:不是“工程师手动调参”,而是形成可审计、可回滚、可对比的配置与报告。

- 提前做生态依赖盘点:推理框架、算子、驱动、监控、日志脱敏、工具调用权限,这些依赖越早锁定,越少临门一脚。

作为“人工智能在半导体与芯片设计”系列的一篇,我更愿意直说:**AI 芯片与国产 GPU 的竞争,不只在晶体管上,也在软件栈与交付流程上。**当国内 GPU 能在模型发布日完成端到端验证时,上层行业(包括汽车)才能更快把模型能力变成用户体验。

接下来更值得追的是:当 GLM-5 这类具备长链路代理能力的模型在国产算力上越来越“即插即用”,座舱与车控的产品定义会不会发生变化——车机不再是应用集合,而是一个真正能“把事办了”的系统代理?