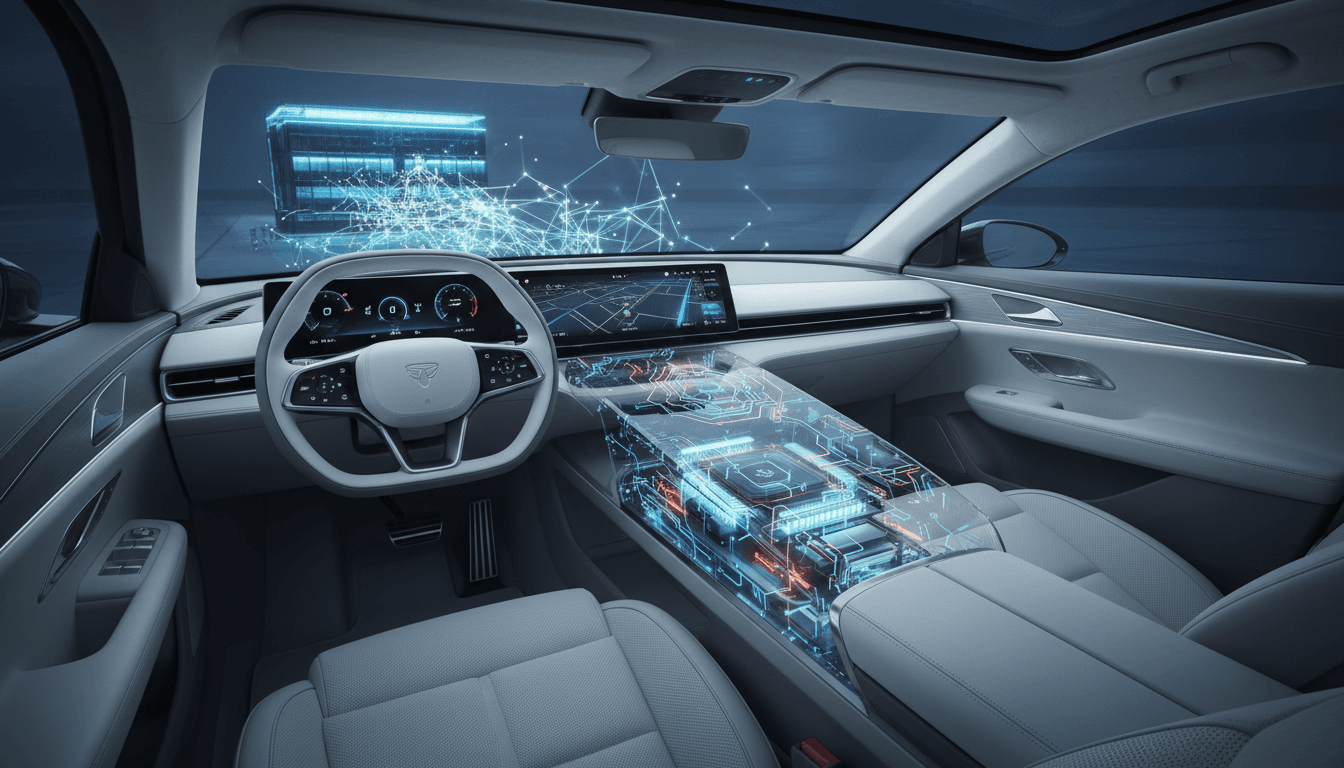

Arm营收创新高,折射AI基础设施需求加速外溢到车端。本文用芯片生态与工具链视角,解析特斯拉与中国车企AI战略的底层分水岭。

Arm营收创新高背后:汽车AI算力之争的底层分水岭

2026-02-04,Arm公布2026财年第三财季业绩:营收同比增长26%至12.4亿美元,创季度新高;调整后净利润4.57亿美元,同比增长10%。如果你只把它当作“芯片公司业绩不错”,那就看小了。

我更愿意把这组数字理解为一个信号:**AI基础设施的需求正在从云端一路挤压到终端,车正在成为最昂贵、也最苛刻的AI终端之一。**而“车端AI”到底能走多远,往往不是先被算法决定,而是先被底层架构、工具链和供应链节奏锁死。

这篇文章放在《人工智能在半导体与芯片设计》系列里,我们借Arm的增长,拆开看一个更现实的问题:特斯拉与中国汽车品牌在AI战略上的核心差异,为什么越来越像“底层算力与架构组织方式”的差异?

Arm的增长说明了什么:AI正在把芯片需求“推向边缘”

直接结论:**Arm的财报不是单一公司的胜利,而是“AI工作负载扩散”的结果。**当大模型推理从数据中心延伸到手机、PC、可穿戴、车机与域控,能效比与生态兼容性就变得比峰值性能更重要。

Arm的商业模式偏“架构授权+生态扩张”。当更多终端需要在功耗、面积、成本三角里做平衡时,Arm擅长的事情——用成熟IP和广泛工具链,把客户从0到1的风险降下去——就会被放大。

把视角放到汽车,你会发现车端AI天然偏好三件事:

- 能效:车规环境要稳定、低功耗,散热与续航/油耗都是硬指标。

- 确定性与可靠性:安全相关功能(感知、规划、控制)更怕抖动与不可解释的延迟。

- 长周期供应:车型生命周期长,芯片供货与软件兼容不能频繁“推倒重来”。

这三点决定了:汽车AI的“算力之争”,最后会落到架构路线与工程组织能力上,而不只是堆TOPS。

汽车AI真正缺的不是“算力”,而是“可持续的算力体系”

一句话先放这:**算力可买,体系难建。**很多车企喊“上大算力芯片”,但真正让智能驾驶/座舱体验拉开差距的,是一整条从数据到模型到部署的闭环。

车端AI的三层基础设施:芯片—工具链—数据闭环

- 芯片与架构选择:CPU/GPU/NPU/ISP如何协同,内存带宽如何匹配,决定了推理延迟的下限。

- 工具链与编译优化:同一模型在不同算子库、量化策略、调度策略下,端到端延迟可能差出一倍以上。

- 数据闭环与持续训练:没有高质量数据采集、标注、仿真与回灌,就只能“演示很美,落地很难”。

Arm财报增长背后暗含的趋势是:工具链和生态的价值被重新定价。对汽车AI来说尤其如此——你需要的是稳定迭代十年的平台,而不是一代芯片的短跑。

为什么2026年这个节点更关键

2025-2026年,行业的变化是“泛大模型”向“行业模型/端侧推理”迁移:

- 端侧推理变多:隐私、时延、成本逼着功能往车端下沉。

- 多域融合加速:座舱+智驾+车身控制更容易共享算力与数据。

- 供应链分化加深:不同地区对先进制程、EDA、IP授权的约束与机会并存。

这意味着:谁能把AI基础设施做成“可复制的生产线”,谁就能把功能迭代做成“规模化交付”。

特斯拉 vs 中国车企:AI战略的核心差异,其实在“组织方式”

先给一个立场:**特斯拉的AI更像“自建工厂”,中国车企更像“搭供应链”。**两者都能跑,但路线成本结构完全不同。

特斯拉的路径:垂直整合,把AI当成“产品本体”

特斯拉的优势不在于某个模型,而在于它倾向于把关键变量握在自己手里:

- 数据闭环更短:车队数据—训练—部署的节奏可控。

- 软硬协同更深:硬件选型、系统软件、模型优化能围绕同一目标做取舍。

- 迭代更像软件公司:版本节奏与灰度发布体系更成熟。

这类路线的代价也高:前期投入巨大、组织要求极强,一旦方向判断错,纠偏成本也更高。

中国车企的现实:多供应商并行,考验“集成能力”

中国汽车品牌的特点更像“工程集成大师”:

- 供应链丰富:芯片、域控、传感器、算法公司选择多。

- 产品节奏快:车型多、改款快,市场反馈快。

- 更擅长在成本与体验之间做“快速均衡”。

难点在于:当你同时用多家芯片、多套中间件、多家算法时,工具链碎片化会直接拖慢迭代。

所以中国车企的分水岭正在从“有没有高阶功能”,变成:

- 能不能建立统一的模型部署管线(MLOps/ModelOps)

- 能不能把算力利用率做上去(调度、量化、剪枝、算子融合)

- 能不能把跨域数据打通(座舱行为数据、智驾事件数据、售后故障数据)

一句更直白的话:买得到算力不稀奇,把算力用到极致才稀缺。

从Arm财报读到的行业机会:汽车AI会反向塑造芯片生态

结论先说:**汽车正在成为AI芯片与IP生态的“强约束客户”。**它的安全、可靠、长期供货要求,会反向推动架构、验证与设计方法演进。

这也正好契合本系列主题:AI不只是跑在芯片上,AI也在改变芯片怎么被设计出来。

AI如何加速芯片设计验证与良率提升(落到可执行)

在半导体研发中,AI的价值常常体现在“缩短试错周期”:

- 验证自动化:用机器学习做测试向量生成与覆盖率提升,减少人工写case的时间。

- 制程与良率优化:用模型预测缺陷分布与参数漂移,提前调整工艺窗口。

- 功耗/时序预测:在早期就对PPA(性能/功耗/面积)做更准的估计,少走返工路。

当汽车客户需要更复杂的SoC(多核CPU+NPU+ISP+安全岛),验证成本会爆炸式上升。谁能用AI把验证和迭代压缩,谁就更可能在车规周期里按时交付。

“架构+生态”为什么会在车端胜出

Arm增长折射的关键是生态:

车端AI不是一次性项目,它是一条持续十年的供应链与软件链。

对车企来说,这会带来一个战略选择:

- 你是要追求某一代芯片的极限性能?

- 还是要一个能稳定迭代、团队可继承、供应链可预期的平台?

我的判断是:**后者会越来越吃香。**因为汽车真正的成本是“长期维护成本”,而不是首发时的宣传成本。

实操清单:车企/供应链团队评估AI芯片路线的5个问题

如果你负责智能驾驶、域控平台或供应链策略,我建议用下面5个问题做尽调(比单看TOPS更有效):

- 端到端延迟是多少?(感知到控制闭环的P95/P99延迟,是否稳定)

- 模型迁移成本多高?(从训练框架到车端部署,需要改多少算子/后处理)

- 工具链是否统一?(编译器、量化工具、profiling工具是否成熟,是否能做自动化CI)

- 算力利用率如何证明?(给出真实场景profiling,而不是实验室demo)

- 供应与合规周期是否匹配?(车规认证、长期供货、漏洞响应机制是否清晰)

这套问题本质上在问:你买的是“芯片”,还是“可持续的AI生产系统”。

写在最后:Arm的数字,提醒我们把目光放到底层

Arm第三财季营收12.4亿美元、同比增长26%,以及对第四财季14.2亿至15.2亿美元的指引(公司披露,2026-02-04),说明AI基础设施的需求仍在加速外溢。对汽车行业而言,这不是“利好消息”那么简单,而是一次重新排位:谁能掌控底层架构与工程闭环,谁就更可能在智能化竞争里越跑越省力。

如果你正在规划2026年的智驾平台或座舱AI路线,我建议把讨论从“选哪颗更强的芯片”往前移一步:我们要构建怎样的AI基础设施,才能支撑三年、五年、十年的持续迭代?

你所在的团队更接近特斯拉式的“自建工厂”,还是更擅长中国式的“供应链集成”?下一轮差距,往往就藏在这个选择里。