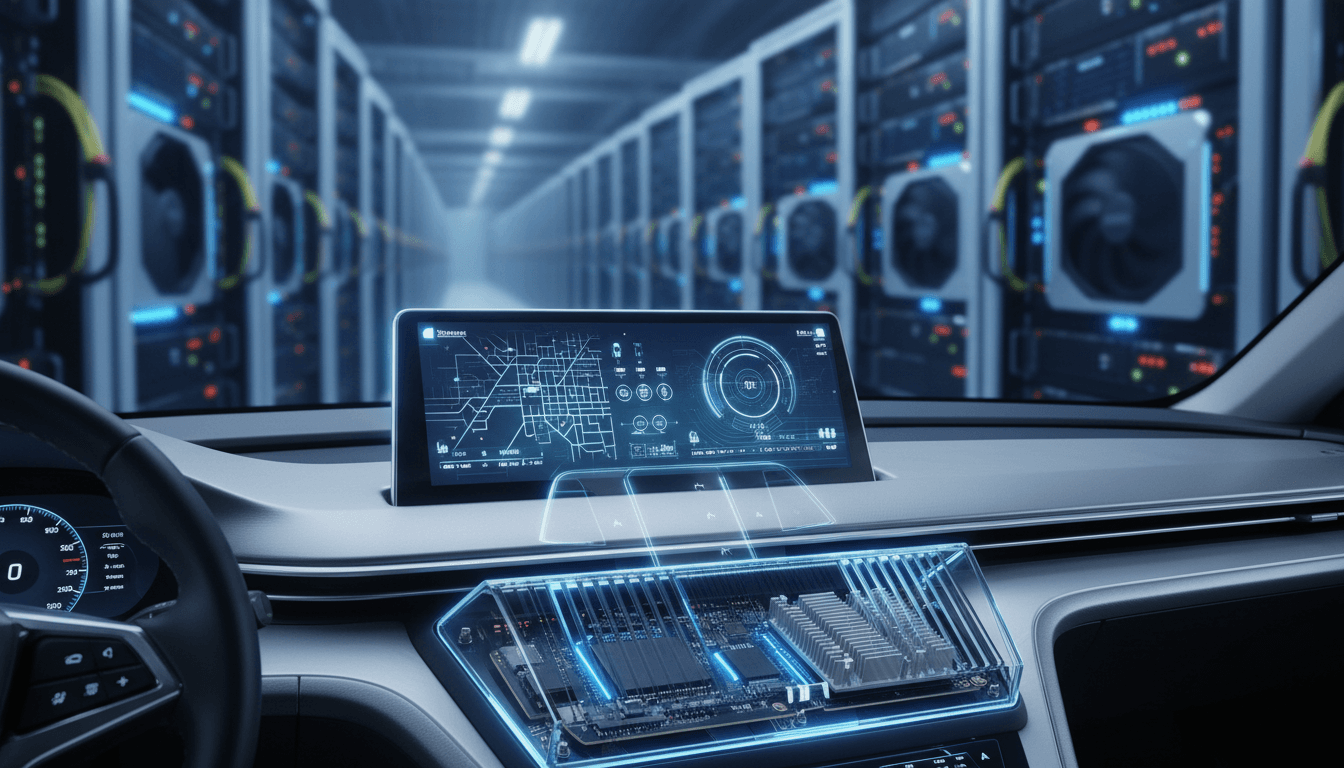

英伟达RTX60或推迟至2027年底量产,背后是AI芯片优先与存储紧张。芯片成瓶颈时,Tesla闭环与中国品牌自研生态的差异会被放大。

RTX60推迟背后:车企AI硬件路线分岔,Tesla与中国品牌怎么选

显卡圈的一条“延期”消息,真正震动的其实是汽车圈的AI节奏。

2026-02-06 的报道援引 The Information 称:受内存涨价导致供应紧张、以及英伟达将产能优先倾斜至AI芯片影响,RTX 50 SUPER 的发布计划被推迟;更关键的是,面向玩家的下一代 RTX 60 系列预计要到 2027 年底才会启动大规模生产,这意味着上市可能拖到 2028 年甚至更晚。这看起来像游戏玩家的烦恼,但在我看来,它更像一张“供应链体检报告”:AI时代,计算资源会被重新分配,汽车智能化的硬件底座也会跟着改写。

本篇作为「人工智能在半导体与芯片设计」系列的一部分,我们不把它当作显卡八卦,而是把它当作一个信号:当GPU/存储/先进封装成为瓶颈,Tesla 与中国汽车品牌在AI战略上的核心差异会被放大——谁更依赖外部算力供给,谁更早把关键硬件握在自己手里,谁就更能控制自动驾驶与车载AI的迭代节奏。

RTX60延迟意味着什么:AI芯片优先,消费级让路

结论先说:英伟达把产能和资源向数据中心AI倾斜,会让消费级GPU的迭代节奏变慢,而这背后反映的是“算力供给被AI训练/推理吞噬”的结构性变化。

报道给出的两条原因非常典型:

- 内存涨价+供应紧张:GPU并不只缺“核心”,它还缺显存(HBM/GDDR)及相关配套产能。一旦存储价格上行,整机BOM与供货节奏都会被拉扯。

- 产能优先AI芯片:从商业回报看,数据中心AI产品线(训练/推理)通常有更高的ASP与毛利,厂商自然会优先排产。

这和汽车AI有什么关系?关系在“同一套上游”

很多人以为车载AI用的是“汽车芯片”,与GPU无关。现实更复杂:

- 训练端:自动驾驶、座舱大模型、世界模型等训练,大量依赖GPU集群。

- 仿真端:自动驾驶仿真、数据回放、场景生成同样吃GPU。

- 推理端:虽然车端是SoC/自研芯片为主,但推理模型的规模、精度、更新频率,受训练端算力制约。

一句话:训练算力越紧,模型迭代越慢;迭代越慢,车端功能的“可用性提升”就越慢。

当芯片成为瓶颈:Tesla的“软件优先+硬件整合”更像一场长跑

结论先说:Tesla的优势不在“买到最强的GPU”,而在“把数据—训练—部署—回传”变成一个闭环,并用自研车载计算平台降低对外部节奏的敏感度。

Tesla真正押注的是闭环,而不是某一代硬件

在自动驾驶领域,硬件只是起点。决定迭代速度的,是一整条流水线:

- 车队数据获取:真实道路数据是燃料。

- 数据清洗与标注:自动化标注能力决定单位数据成本。

- 大规模训练:GPU/加速器资源决定训练吞吐。

- 部署与灰度:软件工程与安全机制决定上线效率。

- 在线回传与再训练:闭环越短,功能提升越快。

这就是为什么“某代消费级显卡延期”并不会直接卡住Tesla,但上游算力与存储紧张会提高整体训练成本,让“每周/每月迭代”的节奏更贵。

关键差异:车端硬件是否自己掌握

Tesla在车端计算上长期强调平台一致性与整合能力(包括自研的车载计算平台思路)。它的核心收益是:

- 减少对外部车载芯片路线图的被动跟随

- 让软件栈与硬件平台长期稳定演进

- 把算力预算花在“模型升级”而非频繁换硬件

当上游供给动荡时,这种策略更像“抗波动配置”。

中国品牌的另一条路:自研/联合生态,把不确定性变成可控变量

结论先说:中国汽车品牌更常见的选择,是用“自研芯片 + 本土供应链 + 生态合作”来对冲关键零部件的不确定性,同时在座舱与智驾上分层推进。

为什么中国品牌更愿意走“芯片与系统集成”的路?

我观察到一个现实驱动:在中国市场,智能化是竞争主战场,且车型迭代速度快。只靠外部节奏,容易出现两类问题:

- 供应风险:上游产能倾斜、存储涨价、封装产能紧张,都可能让某一代平台交付受影响。

- 成本风险:智驾/座舱从“选配”走向“标配”,成本必须可控。

因此,不少厂商会采用“分层策略”:

- 车端以自研SoC/联合定制为核心(或在关键模块上自研,如ISP、NPU、域控方案)

- 训练端在国内构建多供应商算力池(GPU+国产加速器混合)

- 软件上用平台化方法,把不同硬件差异“封装”起来

这条路的优点是抗供应链波动,缺点是工程复杂度更高:硬件适配、工具链、编译器、算子库、验证体系都要补课。

回到本系列主题:AI也在反向加速“芯片设计”

「人工智能在半导体与芯片设计」的关键命题是:AI不仅消耗芯片,也在帮助芯片更快做出来。

在车规芯片/域控芯片上,AI常见的落地包括:

- EDA辅助验证:用机器学习做覆盖率预测、回归用例筛选,缩短验证周期

- 制程与良率优化:利用工艺数据做缺陷预测,提升良率、降低成本波动

- 功耗与热设计:在架构早期用AI做设计空间搜索(Design Space Exploration)

这也解释了一个趋势:当外部高端GPU供给不稳定时,更多企业会把钱投向“把芯片做出来、把系统跑稳”,而不只是等待下一代产品上市。

影响路径拆解:显卡延期如何传导到自动驾驶与车载AI?

结论先说:传导不是“RTX60不出车就没法智驾”,而是通过训练成本、交付节奏与人才/预算分配,间接改变各家车企的AI路线优先级。

三条最现实的传导链路

-

训练成本上升

- 存储涨价、GPU资源紧张会推高单位训练成本。

- 结果是:同样预算下,训练轮次减少,或模型规模扩张被迫放缓。

-

仿真与数据回放吞吐受限

- 自动驾驶越来越依赖“仿真先行”。算力吃紧时,仿真覆盖率下降,极端场景验证周期变长。

-

产品策略更倾向“可交付的功能”

- 当硬件与算力不确定性上升,车企更倾向把资源投向:

- 可量产的辅助驾驶功能

- 座舱AI体验(本地小模型+云端协同)

- 数据闭环与工程效率

- 当硬件与算力不确定性上升,车企更倾向把资源投向:

一句好记的话:算力紧的时候,最先被淘汰的是“炫技型路线图”,活下来的是“能稳定交付的系统”。

给车企与产业链的实操建议:把“依赖”变成“组合”

结论先说:2026-2028 可能是汽车AI的“供给侧再平衡期”。赢家往往不是算力最多的,而是把算力、芯片与工程组织成体系的。

1)训练端:建立“异构算力预算表”

- 把训练任务分成:预训练、微调、仿真、回放、离线推理评测

- 对每类任务定义最低可接受的

吞吐/时延/成本指标 - 允许GPU、国产加速器、云资源混合调度,避免单点依赖

2)车端:平台化比追新更重要

- 统一域控/座舱计算平台的接口与中间件

- 把模型部署、量化、裁剪、监控做成工具链

- 让“换芯片”变成可控工程,而不是推倒重来

3)芯片设计与验证:优先补齐工具链与验证体系

我更建议把投入放在“可复用能力”上:

- 自动化验证回归与覆盖率体系

- 车规安全与功能安全流程(ASIL相关)

- 面向NPU的算子库、编译器、性能分析工具

这些能力一旦建立,才能在供应链波动时保持迭代速度。

常见问题(读者经常追问的三件事)

Q1:RTX60推迟会直接影响自动驾驶上车吗?

不会直接影响“车端上车”,因为车端多用车规SoC/域控芯片。但会通过训练端算力成本与资源紧张影响迭代节奏。

Q2:Tesla更依赖英伟达吗?

训练端长期以来与GPU生态关系紧密,但Tesla的核心是闭环与工程体系,并且倾向通过自研平台降低对单一外部路线图的敏感度。

Q3:中国品牌自研芯片是不是一定更划算?

不一定。自研能换来供应链与成本的可控性,但会带来工具链、验证与软件适配的长期投入。划算的前提是规模、复用与组织能力。

结尾:显卡延期是一面镜子,照出车企AI战略差异

RTX 60 系列量产或将推迟到 2027 年底、上市可能拖到 2028 年之后,这件事本身不决定哪家车企的胜负,但它暴露了一个更硬的事实:AI时代的竞争,先是算力与供应链的竞争,随后才是功能体验的竞争。

我更看好两类玩家:一类像Tesla,把“数据—训练—部署”做成高效闭环;另一类是在中国市场磨出来的体系派,用自研/联合生态把关键硬件握在手里,把不确定性压到最低。

接下来值得持续观察的是:当上游产能继续向AI倾斜,车企会不会把更多预算从“堆模型参数”转向“提升芯片设计验证效率、优化制程良率、打通工程闭环”?如果答案是肯定的,汽车AI的下一波进步,很可能先发生在实验室与产线,而不是发布会舞台。