GPT-5.3-Codex发布强调“高等级”网络安全与可信访问框架。本文以公共安全视角拆解特斯拉与中国车企AI战略差异,并给出可落地的AI治理清单。

GPT-5.3-Codex发布:对比特斯拉与中国车企AI战略分水岭

2026-02-05 23:55,OpenAI CEO Sam Altman宣布“GPT-5.3-Codex正式发布”,并强调它是首款在安全防护框架的网络安全维度获评“高等级”的模型,同时试点“可信访问框架”,并投入1000万美元API额度支持网络安全防御体系建设。这个信息看似属于AI开发者圈,但我更愿意把它当作一个汽车行业信号:生成式AI正从“会聊天”转向“能写代码、能守安全、能进系统”。

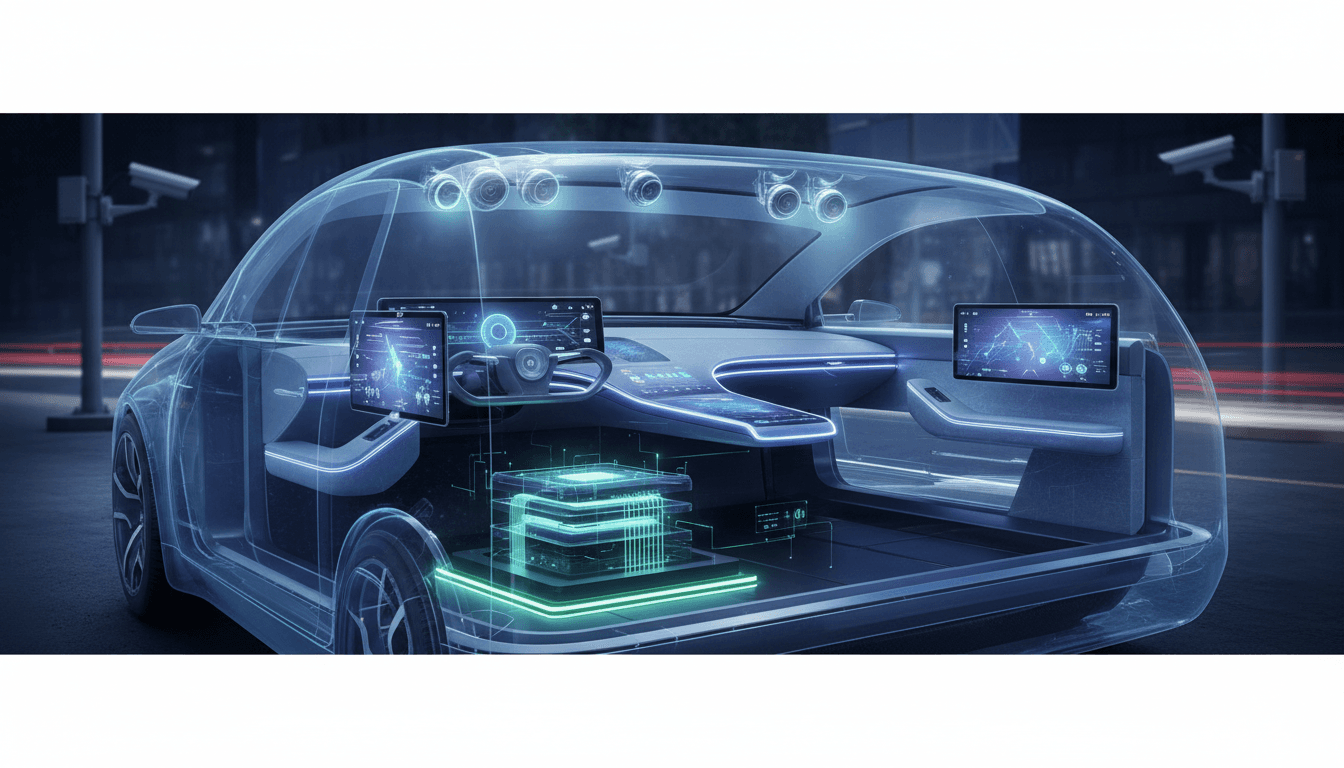

这件事之所以和“人工智能在安防与公共安全”系列相关,是因为汽车正在变成城市公共安全体系的一部分:它有摄像头、麦克风、定位、通信、支付与身份能力;它上路就是移动传感器节点。生成式AI一旦进入整车系统,安全能力不再是“附加题”,而是“入口门槛”。

而真正有意思的分水岭在于:特斯拉与中国车企在AI战略上,走的是两条完全不同的路线。前者更像“把模型当操作系统能力”,更早把生成式AI与车端交互、软件迭代和数据闭环绑定;后者在2024-2026这波智能化竞赛里更常见的打法是“多供应商拼装 + 定制化模型/工具链”,强调本地化、成本与交付速度。GPT-5.3-Codex的发布,让这两条路线的优缺点更清晰。

GPT-5.3-Codex释放了什么信号:模型正在变成“安全工程师”

GPT-5.3-Codex最值得关注的点不是“更聪明”,而是在网络安全维度获得高等级评估,并配套“可信访问框架”。这意味着模型在被用于安全场景时,开始具备更明确的边界、权限与可审计机制。

从“写代码”到“写得安全”:对汽车软件栈的直接影响

汽车正在经历软件规模爆炸:域控制器融合、SOA服务化、车云协同、OTA频繁迭代。软件越复杂,漏洞面越大。生成式AI如果只会提升开发效率,却不能在安全上“自带刹车”,车企就不敢把它放进核心链路。

Codex类模型一旦把能力沉到工程流程里,会出现三种立竿见影的变化:

- 安全编码与代码审计自动化:在提交前做静态分析、依赖库风险扫描、生成补丁建议。

- 威胁建模与攻击面梳理:把“安全需求”变成可执行的工程任务清单。

- 车云安全运营辅助:对日志、告警、异常流量做语义归因,缩短MTTR(平均修复时间)。

这些变化并不抽象。对于整车系统智能化来说,真正的瓶颈常常不是“有没有功能”,而是“能不能规模化上线且合规可控”。

可信访问框架:生成式AI上车的“身份与权限”问题被摆到台面

Sam Altman提到的可信访问框架,本质上对应企业级落地里最麻烦的那件事:谁能调用模型、能访问哪些数据、输出是否可追溯。

把它映射到车端,就是:

- 车机里哪些App/服务能调用生成式AI?

- 车内语音/摄像头/定位数据能否被模型读取?

- 当模型生成了错误建议导致安全风险,责任链条如何界定?

这恰好与“安防与公共安全”主题对齐:可审计、可追溯、可分级授权,是AI进入公共空间的前置条件。

特斯拉的AI战略:把模型当“平台能力”,而不是“功能插件”

特斯拉的策略可以概括为一句话:统一的软件平台 + 数据闭环 + 高频迭代。它不急着在每个细分功能上做“最像人的助手”,而是把AI当作整车系统的底层能力——包括驾驶、座舱、诊断、服务与运营。

统一架构的好处:生成式AI更容易沉到“工程与系统”

当车企的软件与数据在统一平台上,生成式AI就不只是“语音对话”,而能进入更深的链路:

- OTA变更评审:模型辅助分析改动影响面与回归测试点

- 车端故障诊断:结合历史工单与传感器数据生成排障路径

- 安全事件响应:对车云异常做关联分析,输出处置建议与复盘报告

我见过不少企业“上了大模型”,最后停留在“做个聊天入口”。原因往往不是模型不行,而是系统不统一、数据不连通、权限不清晰。特斯拉的结构性优势在这里被放大。

代价也很明确:更重的自研投入与更高的治理要求

把模型当平台能力,意味着:

- 需要更强的工程组织能力(MLOps、数据治理、红队测试)

- 需要更严格的安全与合规体系(尤其在跨区域运营时)

- 需要长期投入算力与工具链,而不是项目制采购

这条路走得通,但不是“买个API”就能复制。

中国车企更常见的打法:定制化、供应链协同与快速交付

中国车企的优势是速度与场景:本地生态强、供应链密、用户反馈快。很多车企会选择“多模型并用”:座舱用一个通用大模型,营销客服用另一个,研发辅助再用一套代码模型;同时针对中文语料、车控指令与本地法规做定制。

这种路线的强项:落地快、成本可控、适配本土体验

- 语音与座舱体验:中文对话、方言、车控指令、多App生态更容易做深

- 场景定制:围绕导航、充电、泊车、儿童模式、售后等高频场景快速迭代

- 成本弹性:可根据车型与配置做分级,避免“全系标配高成本模型”

隐患在“系统级一致性”:安全与治理容易被割裂

当模型与供应商过多,最容易出问题的是三件事:

- 权限边界不一致:A模型能访问的车内数据,B模型不一定能;审计难。

- 安全标准不统一:不同供应商的红队测试、对齐策略、日志格式各不相同。

- 升级联动困难:座舱升级后影响车控服务,车控升级又影响诊断链路,回归成本上升。

GPT-5.3-Codex强调的“高等级安全评估 + 可信访问框架”,等于把行业从“能用就行”推向“能控才行”。这对多供应商拼装模式会形成更强的治理压力。

生成式AI进入整车系统:公共安全视角下的三条底线

车是公共空间的一部分,所以“上车”不只是产品体验问题,还涉及公共安全与城市治理。把生成式AI引入整车系统,我认为至少要守住三条底线。

1)数据边界清晰:最小化采集与分级授权

生成式AI最怕“数据一锅端”。正确的做法是:

- 车内数据按敏感等级分层(身份、位置、音视频、车辆状态等)

- 默认最小权限,关键权限需显式授权与可撤销

- 对训练/评估数据做脱敏与可追溯管理

这也是安防与公共安全体系常用的治理方法:先分级,再授权,再审计。

2)可审计可追责:日志、证据链与模型输出留痕

当模型参与了安全相关决策(例如提醒驾驶员、解释告警、辅助远程诊断),就必须做到:

- 关键调用全量留痕:输入摘要、输出摘要、时间戳、权限令牌

- 支持事后复盘:能还原“当时模型为什么这么说”

- 关键策略可回滚:避免一次更新影响全量车辆

3)安全能力前置:把“网络安全”当产品指标,而不是法务指标

Codex类模型强调网络安全评估,本质上是在告诉市场:安全不是合规部门的工作,是产品指标。对车企来说,可以把它落成可执行的KPI:

- 漏洞修复平均周期(MTTR)

- 关键依赖库风险暴露时间

- OTA发布前安全扫描覆盖率

- 车云异常告警误报率/漏报率

当指标可量化,安全才会进入日常迭代,而不是出事后救火。

车企与安防行业如何借势:一份可落地的“AI治理清单”

如果你在车企负责智能化、信息安全或数据治理,或者你在做城市安防与公共安全项目,GPT-5.3-Codex带来的最大启发是:把生成式AI当“高权限软件组件”来治理。

我建议用下面这份清单开工(不需要等到“全部准备好”再做):

- 先选一个高价值链路试点:例如安全代码审计、漏洞知识库问答、告警归因。

- 建立可信访问机制:服务账号、权限分级、密钥轮换、调用配额。

- 把审计做成默认功能:日志规范、采样策略、异常输出告警。

- 引入红队与对抗测试:提示注入、防越权、数据泄露、幻觉触发。

- 定义“不可做清单”:哪些车控指令禁止由模型自由生成,必须走规则与校验。

这套方法对“整车智能化”与“公共安全AI”都适用,因为两者面临的是同一类风险:高权限系统 + 复杂环境 + 真实世界后果。

生成式AI上车,下一轮竞争比的是“系统能力”,不是“谁更会聊天”

GPT-5.3-Codex的发布把焦点从“生成能力”推向“安全与可信访问”。这会直接改变汽车行业的竞争维度:未来更重要的是谁能把模型放进工程体系、放进安全体系、放进可持续迭代体系。

特斯拉的路线更像“平台化与统一治理”,优势在系统一致性与闭环效率;中国车企的路线更像“场景化与生态协同”,优势在快速落地与本土体验。接下来两者的胜负手不在发布会话术,而在后台:权限、审计、工具链、指标与组织能力。

如果你想把生成式AI真正用到整车系统或公共安全体系里,我的建议很直白:先把可信访问和可审计打牢,再谈体验升级。当模型变得越来越强,真正稀缺的不是“能力”,而是“把能力放进现实世界仍然可控”的方法。

你更看好哪条路线:统一平台优先,还是多模型定制优先?2026年的答案,很可能决定未来五年的行业格局。